设置Sony笔记本U盘启动详细步骤指南助您快速掌握技巧

通过详细指导,确保数据安全,快速进入系统,提升使用体验,满足各类用户需求。

【菜科解读】

简介:

在日常使用Sony笔记本时,有时需要通过U盘启动来完成系统重装、病毒查杀或数据恢复等操作。

U盘启动不仅可以快速解决软件方面的问题,还能在某些硬件故障情况下,帮助您恢复重要数据。

在这篇文章中,我们将为您详细介绍如何设置Sony笔记本U盘启动的方法,帮您轻松掌握这项实用技能。

工具原料:

系统版本:Windows 11

品牌型号:Sony VAIO Z (2022)

软件版本:BIOS及UEFI最新版

一、检查和准备工作

1、检查U盘可用性:在开始设置之前,确保U盘已完全格式化,并且其中已经写入了可引导的操作系统镜像文件。

如果没有,请先在另一台电脑上使用Rufus等软件制作一个可启动U盘。

2、备份数据:由于设置U盘启动可能涉及系统文件和引导信息的修改,建议首先备份重要的文件和数据以避免数据丢失。

二、进入BIOS/UEFI设置

1、关机后重启笔记本,在电脑开机自检时按下'F2'或'Delete'键进入BIOS/UEFI设置页面。

不同型号可能会不同,建议查阅产品说明书获取确切的按键信息。

2、在BIOS/UEFI菜单中,使用方向键导航至“Boot”选项卡。

在这里,您将看到系统引导设备的顺序列表。

三、设置U盘作为首选启动项

1、在Boot选项卡中,找到已插入U盘的名称或相关选项,通常会显示为“Removable Devices”或具体的U盘品牌名称。

2、使用“+”和“-”键或其他指令键,将U盘移动到启动顺序的顶部位置,确保其成为首选启动设备。

3、设定完成后,按“F10”键保存修改并退出设置。

确认保存时,系统将自动重启。

四、验证U盘启动成功

1、在重新启动过程中,系统应该从U盘启动。

如果设置正确,您会看到U盘中所存在的操作系统引导画面。

2、若未能成功启动,返回BIOS/UEFI设置页面,确认启动顺序配置是否正确,或尝试插入其他USB接口重新设置。

拓展知识:

1、UEFI与Legacy BIOS区别:多数新型笔记本已支持UEFI启动模式,此模式相较传统BIOS引导更为快速,并支持更大容量硬盘。

然而,有些U盘始牌镜像或旧版系统只支持Legacy BIOS模式启动。

如遇兼容性问题,可尝试在BIOS/UEFI中切换启动模式。

2、制作用于启动的U盘:如果您需要制作一个启动U盘,可以使用免费的Rufus工具。

Rufus支持多种操作系统ISO镜像,如Windows、Linux等,并提供UEFI支持选项。

总结:

设置Sony笔记本的U盘启动是一项非常实用的技巧,它可以帮助您在需要重装系统或进行其他系统维护时节省时间和精力。

通过对系统引导的合理设置,您不仅能够有效解决当前的问题,同时也为未来可能需要的自救手段做好准备。

只需经过几个简单的步骤,您便能对Sony笔记本的启动选项进行调整,为自己提供更加灵活的使用体验。

希望本篇文章对您有所帮助,助您成为IT生活中的能手。

sony笔记本重装系统步骤图文演示

专业的在线重装系统软件 全新设计 / 全新代码编写 / 全新支持所有机型 全新支持Window 11 安装 当使用的电脑时间久后磁盘碎片增多,变得越来越卡顿,经常蓝屏死机的时候,我们可以考虑通过一键重装系统的方法解决。最近就有使用索尼笔记本的用户想重装但是不知道如何重装系统。

下面小编就给大家演示下sony笔记本重装系统详细步骤。

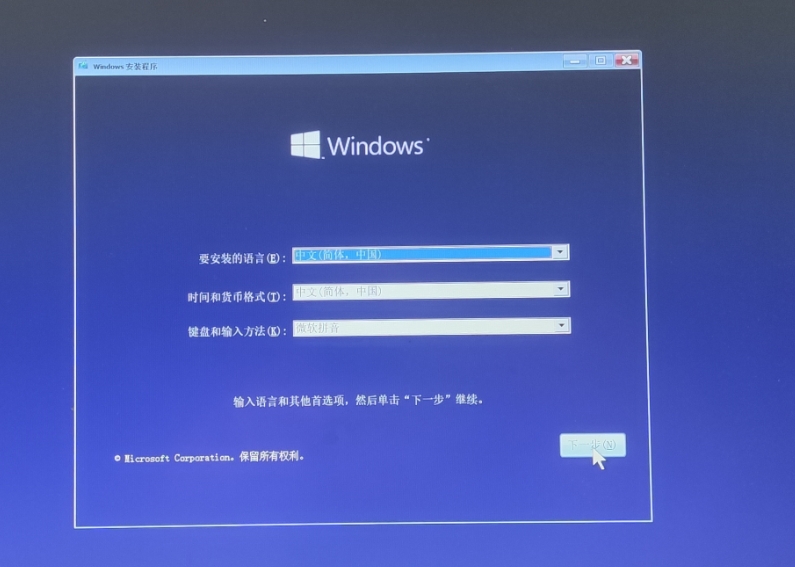

具体的步骤如下:1、首先在索尼笔记本上搜索“小白系统官网”下载小白三步装机版工具打开,选择需要安装的系统,然后点击立即重装。

2、软件自动开始下载系统镜像等。

3、无需操作,等待软件自动安装部署系统。

4、部署完成后,可以选择立即重启。

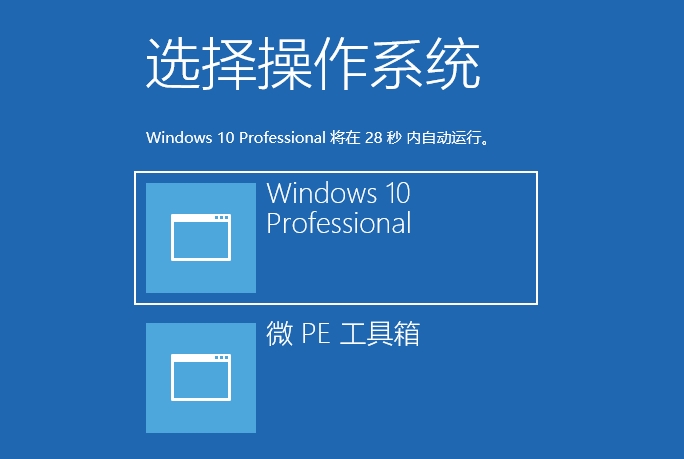

5、重启系统后,选择xiaobai-pe系统进入。

6、进入pe后,小白装机工具会自动进行系统安装。

7、等待安装成功后立即重启,重启后等待安装完成进入系统即可。

以上便是通过小白三步装机版工具快速一键重装系统的详细步骤,无需安装软件,操作非常简单,安全可靠。

有需要的小伙伴都可以去下载安装使用。

始皇陵藏惊天秘密,陵顶石榴树竟能看出地下水银总量

西安骊山北麓,秦始皇陵矗立两千余年,《史记》记载地宫以水银为江河大海,是史实还是夸张?答案,藏在封土堆顶的石榴树里。这些树长得矮小、果实畸形、含剧毒汞,恰恰印证地下藏着海量水银。

今天就扒一扒:始皇陵到底浇灌了多少水银?石榴树又藏着哪些秘密?史书记载:水银为百川江河大海司马迁在《史记・秦始皇本纪》明确写道:“以水银为百川江河大海,机相灌输,上具天文,下具地理。

”意思是,地宫用水银模拟天下江河,机械驱动循环流动,顶部绘星空、底部仿地貌,复刻整个大秦疆域。

两千年来,这段文字常被质疑是文学夸张 —— 要形成 “江河大海”,得多少水银?秦朝生产力能办到吗?科学实锤:12000㎡强汞异常区真相,在 1981 年揭开。

中国地质调查局用汞量测量技术探测封土堆,结果震惊学界:封土堆存在约 12000 平方米强汞异常区,汞含量远超正常土壤几十倍;

分布呈东南强、西北弱,完美对应秦代渤海、黄海方位,与《史记》描述完全吻合;

2002 年复测确认:汞来自地宫挥发,非土壤天然富集。

这直接证明:地宫水银真实存在,且规模巨大。

山顶石榴树:水银量的 “活标尺”最直观的证据,是封土堆上的石榴树。

反常生长:矮小、畸形、不结果普通石榴树高 3-7 米、枝干粗壮、果实饱满;

但始皇陵顶的石榴树仅 1-2 米高、枝叶稀疏、叶片发黄、果实瘦小畸形。

化验惊人:汞含量超标百倍专家采样检测发现:树根、叶片汞含量平均 205ppb,最高 1440ppb(比正常值高数十倍);

果实汞含量严重超标百倍,是名副其实的 “毒石榴”,绝对不能吃。

原理:汞蒸气渗透,植物 “中毒”地宫水银持续挥发,汞蒸气沿土壤裂隙向上渗透,被石榴树根系吸收,干扰生长、积累毒素。

简单说:石榴树的 “病态”,就是地下水银海量且持续挥发的铁证。

重磅数据:地宫到底有多少水银?结合汞异常区面积、土壤汞浓度、地宫空间,专家推算:保守估算:100 吨(水银层仅 1 厘米厚,就需约 100 吨);

合理区间:100-150 吨(符合秦朝生产力,需约 115 吨丹砂提炼);

排除 “千吨” 夸张说法:地宫面积仅约 4000㎡,根本容纳不下千吨液体。

100 吨水银是什么概念?相当于20 万瓶 500ml 水银;

能覆盖整个地宫(约 4000㎡)2.5 厘米深;

两千多年持续挥发,仍能让山顶植物 “中毒”,可见储量之恐怖。

秦始皇为何灌海量水银?防盗:汞蒸气剧毒,能毒死盗墓者,两千年来护陵墓周全;

防腐:水银杀菌防腐,保护地宫与陪葬品不朽;

象征:以水银复刻江河大海,彰显皇权至高无上,死后仍掌天下;

长生:古人认为水银与长生相关,助其灵魂不朽。

结语始皇陵地宫100 吨 + 水银,不是传说,是被史书、科学探测、山顶石榴树三重印证的史实。

那些矮小畸形、含剧毒的石榴树,默默守护两千余年,用自身 “病态”,揭开了秦始皇陵最神秘的面纱。

猜你喜欢