win10系统盘制作教程:详细步骤教你快速上手

通过制作U盘或光盘系统盘,用户可快速安装或重装系统,解决电脑问题。

正确使用Win10系统盘能提高系统稳定性,保障数据安全。

【菜科解读】

Windows 10是目前全球使用最广泛的操作系统之一。但在日常使用中,难免会遇到系统故障、性能降低等问题。

此时,制作一个Win10系统盘,既可以用于重装系统,也可用于系统修复,十分实用。

本文将详细介绍如何制作Win10系统盘,助您快速掌握这一技能。

工具原料:

系统版本:

- Windows 10(版本22H2,最新正式版)品牌型号:

- 电脑:戴尔 XPS 13(2022款)- U盘:三星 BAR Plus 32GB USB 3.1软件版本:

- Windows 10 媒体创建工具(Media Creation Tool)2023年最新版一、准备工作

1、确认硬件需求:

- **U盘要求**:准备一个容量至少为8GB的U盘,建议使用高速USB 3.0或以上规格,以提高制作速度和稳定性。- **电脑配置**:确保电脑正常运行,网络连接稳定,有足够的磁盘空间(至少8GB)用于下载系统文件。

2、下载媒体创建工具:

- 前往[微软官方Windows 10下载页面](https://www.microsoft.com/zh-cn/software-download/windows10),下载“立即下载工具”。- 保存Media Creation Tool可执行文件至电脑本地磁盘。

3、备份U盘数据:

- **重要提示**:制作系统盘会格式化U盘,清除其中所有数据。请提前备份U盘内的重要文件。

二、制作Win10系统盘的详细步骤

1、运行媒体创建工具:

- 双击运行下载的“MediaCreationTool.exe”文件。- 在用户账户控制(UAC)弹窗中,点击“是”以允许程序更改设备。

2、接受许可条款:

- 阅读微软软件许可条款,点击“接受”继续。3、选择操作:

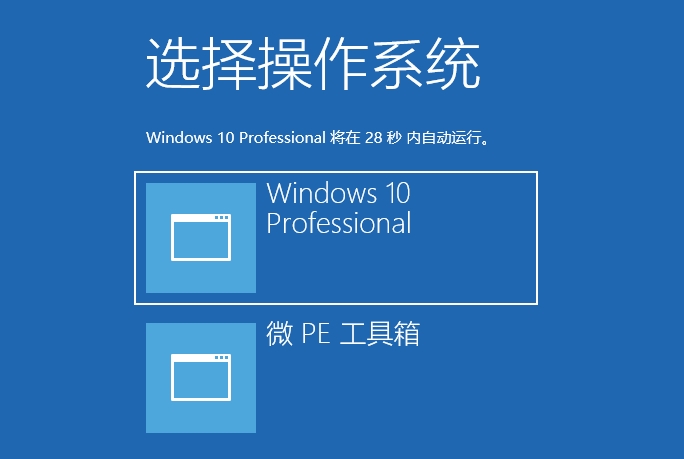

- 在“您想执行什么操作?”界面,选择“为另一台电脑创建安装介质(U盘、DVD或ISO文件)”。- 点击“下一步”。

4、选择语言、体系结构和版本:

- 默认情况下,媒体创建工具会根据当前系统推荐选项。- 如需修改,取消勾选“使用此电脑的推荐选项”,手动选择需要的**语言**(如简体中文)、**版本**(Windows 10)、**体系结构**(64位、32位或二者)。

- 点击“下一步”。

5、选择介质:

- 在“选择要使用的介质”界面,选择“U盘”。- 点击“下一步”。

6、选择U盘:

- 插入准备好的U盘,媒体创建工具会自动检测连接的设备。- 从列表中选择目标U盘,确保选中正确的设备。

- 点击“下一步”。

7、下载Windows 10系统文件:

- 工具将开始下载Windows 10系统镜像文件,大小约为4GB至5GB。- 下载时间取决于网络速度,请耐心等待。

8、创建Windows 10安装介质:

- 下载完成后,工具会自动将系统文件写入U盘,制作启动盘。- 期间请勿拔出U盘或关闭电脑。

9、完成制作:

- 当界面显示“您的U盘已准备就绪”时,点击“完成”。- 系统会自动清理临时文件,关闭程序。

三、验证与使用Win10系统盘

1、验证系统盘:

- 打开“此电脑”,查看U盘内容,应该包含“bootmgr”、“setup.exe”等文件。- 这表明系统盘已成功制作。

2、使用系统盘重装系统:

- **备份数据**:在重装系统前,请备份电脑中重要的个人文件。- **设置 BIOS 启动顺序**:重启电脑,按下F2、F12、Del等键进入BIOS设置,将U盘设置为第一启动项。

- **启动安装程序**:保存并退出BIOS设置,电脑会从U盘启动,进入Windows安装界面。

- **按照提示安装系统**:选择语言、输入法,点击“现在安装”,根据向导完成系统安装。

3、使用系统盘修复系统:

- 从U盘启动电脑,在安装界面选择左下角的“修复计算机”。- 在“选择一个选项”界面,点击“疑难解答”,可选择“启动修复”、“系统还原”等工具,对系统进行修复。

拓展知识:

1、使用第三方工具制作启动盘:

- 除了微软官方的媒体创建工具,您还可以使用Rufus、Ventoy等第三方软件制作Win10系统盘。- **Rufus**:支持创建UEFI和Legacy启动盘,提供更多高级选项。

- **Ventoy**:可在同一个U盘中放入多个ISO镜像,启动时选择需要的系统,方便实用。

2、了解UEFI和Legacy BIOS:

- **UEFI模式**:新的主板通常支持UEFI启动,具有启动速度快、支持大容量硬盘等优点。- **Legacy BIOS模式**:兼容性强,适用于老旧设备。

- 制作系统盘时,需根据目标电脑的启动模式选择合适的分区类型(GPT或MBR)。

3、Windows 10版本选择:

- **家庭版**:适合普通家庭用户,功能全面,易于使用。- **专业版**:包含家庭版的所有功能,另增加了远程桌面、组策略管理等高级功能,适合专业用户和企业使用。

- 在制作系统盘时,可根据需求选择合适的版本。

?Win7升级到Win10的详细步骤与注意事项?

想重装系统不会怎么办?菜科网一键重装系统轻松在线帮您搞定系统重装问题。

软件支持 在线重装、U盘制作、自定义重装 等多种模式。

电脑品牌型号:联想ThinkPad X1 Carbon 2022版、Dell XPS 13 9310、华为MateBook X Pro 2022版操作系统版本:Windows 7 Professional/Ultimate(版本号:SP1)硬件配置:Intel Core i5/i7第11代处理器,8GB/16GB DDR4内存,512GB/1TB NVMe固态硬盘,集成显卡或独立显卡(如NVIDIA MX450)软件版本:Windows 10 22H2(最新版本)工具软件:Windows Media Creation Tool(微软官方工具)、驱动程序备份软件(如Driver Booster)、数据备份软件(如AOMEI Backupper)一、准备工作:确保硬件兼容与数据备份1、硬件兼容性确认:在升级前,首先确认你的电脑硬件支持Windows 10。

大部分2020年以来的主流硬件都已优化支持Win10,但仍需检查CPU、内存、硬盘空间和显卡驱动是否符合要求。

可以访问设备制造商官网或微软官方兼容性检测工具进行确认。

例如,联想、Dell、华为等品牌的最新型号均已支持Win10 22H2版本。

2、数据备份:升级过程中存在数据丢失风险,建议提前备份重要文件。

可以使用Windows自带的备份工具或第三方软件(如AOMEI Backupper)将重要资料、系统镜像、驱动程序等完整备份到外部硬盘或云端存储,确保数据安全。

3、驱动程序准备:提前下载好关键硬件的最新驱动程序,尤其是显卡、声卡、网卡等,以便在升级后快速安装,避免驱动不兼容导致的系统故障。

二、下载与制作Windows 10安装介质1、下载Windows 10镜像文件:访问微软官网,下载最新的Windows 10 22H2版本ISO镜像文件。

建议选择官方渠道,确保镜像的安全性和完整性。

2、制作启动U盘:使用微软官方的Media Creation Tool(媒体创建工具)制作启动U盘。

插入空白U盘(建议容量8GB以上),运行工具,选择“为另一台电脑创建安装介质”,按照提示完成制作。

此U盘将作为系统安装的启动盘,确保操作的便捷性和安全性。

3、验证U盘启动:制作完成后,将U盘插入目标电脑,重启并进入BIOS设置,将启动顺序调整为U盘优先启动。

确认U盘可以正常引导,避免后续安装中出现问题。

三、正式升级流程:从Win7到Win101、进入安装界面:插入制作好的启动U盘,重启电脑,进入BIOS设置,选择U盘启动。

系统会加载Windows安装程序,进入安装界面。

2、选择安装类型:在“安装Windows”界面,选择“自定义:仅安装Windows(高级)”。

此方式允许你选择目标硬盘分区,进行全新安装或升级安装。

3、硬盘分区管理:建议在安装前对硬盘进行分区整理,确保系统分区(通常为C盘)有足够空间(建议至少50GB以上),并删除旧系统分区(注意备份数据)。

如果你希望保留部分数据,可以选择“升级”选项,但建议进行全新安装以获得更稳定的系统体验。

4、安装过程:按照提示选择目标分区,确认无误后开始安装。

整个过程可能需要20-40分钟,期间电脑会多次重启。

请勿中断,确保电源稳定。

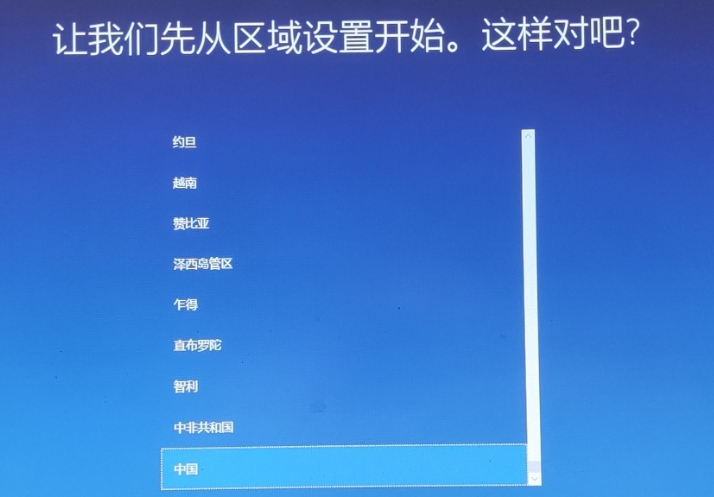

5、首次启动配置:安装完成后,系统会引导你进行初次设置,包括地区、语言、网络连接、微软账号登录等。

建议使用微软账号登录,以同步设置和应用。

6、驱动与软件安装:系统安装完成后,建议立即安装硬件驱动程序,确保硬件正常工作。

可以使用驱动备份软件或从设备制造商官网下载最新驱动程序。

此外,安装常用软件和安全防护软件,确保系统安全与高效运行。

四、升级后优化与常见问题解决1、系统更新:完成安装后,立即检查Windows Update,下载并安装所有最新的安全补丁和功能更新,确保系统安全稳定。

2、驱动兼容性:部分硬件在升级后可能出现驱动不兼容问题。

可以通过设备管理器检查硬件状态,必要时手动更新驱动或使用制造商提供的驱动程序包。

3、性能优化:关闭不必要的启动项和后台程序,调整虚拟内存,优化系统性能。

可以使用Windows自带的“性能监视器”或第三方优化工具进行调优。

4、常见故障排查:如系统启动缓慢、蓝屏、驱动冲突等问题,建议使用系统还原点恢复,或重装系统。

确保备份的系统镜像可用,以便快速恢复到稳定状态。

五、系统安全与维护建议1、启用Windows Defender:确保系统自带的安全防护开启,定期扫描病毒和恶意软件。

2、定期更新:保持系统和驱动程序的最新状态,避免安全漏洞和兼容性问题。

3、备份策略:建立定期备份习惯,尤其是在进行重大系统变更前,确保数据安全无忧。

4、硬件维护:保持硬件清洁,定期检测硬盘健康状态(如使用CrystalDiskInfo),延长硬件使用寿命。

拓展知识:1、Windows 10的优势:相比Win7,Win10提供了更强的安全性、更好的多任务处理能力、更丰富的应用生态系统以及持续的系统更新支持。

例如,Win10引入了虚拟桌面、多窗口管理、Cortana语音助手等实用功能,极大提升了用户体验。

2、升级策略建议:对于硬件较老的设备(如2014年前的机型),升级到Win10可能会遇到性能瓶颈。

建议先评估硬件性能,必要时考虑硬件升级或全新购买设备,以获得更好的使用体验。

3、系统迁移技巧:如果你希望在升级过程中保留旧系统环境,可以考虑使用系统镜像备份或迁移工具,将旧系统完整迁移到新硬盘或新系统环境中,减少配置和软件重新安装的繁琐。

4、常见误区:部分用户误以为升级后无需重新安装软件,实际上许多软件在新系统中可能需要重新激活或更新。

建议在升级前做好软件清单,逐一确认兼容性和激活状态。

总结:从Windows 7升级到Windows 10是提升系统安全性、体验和功能的有效途径。

整个过程包括硬件兼容性确认、数据备份、制作启动介质、正式安装以及后续优化。

操作过程中应注意备份重要数据,确保驱动程序的兼容性,并在升级后及时进行系统更新和性能调优。

通过科学合理的升级策略,用户可以最大程度地减少故障风险,享受Windows 10带来的全新体验。

未来,随着技术的不断发展,持续关注系统安全和硬件升级,将为数字生活提供更坚实的保障。

标签: 注意:本站所刊载的文章均为学习交流之用,请勿用于商业用途。

对于商业使用,请联系各自版权所有者,否则法律问题自行承担。

Win7升级到Win10的详细步骤与注意事项 分类于: 回答于:2025-08-10 电脑品牌型号:联想ThinkPad X1 Carbon 2022版、Dell XPS 13 9310、华为MateBook X Pro 2022版操作系统版本:Windows 7 Professional/Ultimate(版本号:SP1)硬件配置:Intel Core i5/i7第11代处理器,8GB/16GB DDR4内存,512GB/1TB NVMe固态硬盘,集成显卡或独立显卡(如NVIDIA MX450)软件版本:Windows 10 22H2(最新版本)工具软件:Windows Media Creation Tool(微软官方工具)、驱动程序备份软件(如Driver Booster)、数据备份软件(如AOMEI Backupper)一、准备工作:确保硬件兼容与数据备份1、硬件兼容性确认:在升级前,首先确认你的电脑硬件支持Windows 10。

大部分2020年以来的主流硬件都已优化支持Win10,但仍需检查CPU、内存、硬盘空间和显卡驱动是否符合要求。

可以访问设备制造商官网或微软官方兼容性检测工具进行确认。

例如,联想、Dell、华为等品牌的最新型号均已支持Win10 22H2版本。

2、数据备份:升级过程中存在数据丢失风险,建议提前备份重要文件。

可以使用Windows自带的备份工具或第三方软件(如AOMEI Backupper)将重要资料、系统镜像、驱动程序等完整备份到外部硬盘或云端存储,确保数据安全。

3、驱动程序准备:提前下载好关键硬件的最新驱动程序,尤其是显卡、声卡、网卡等,以便在升级后快速安装,避免驱动不兼容导致的系统故障。

二、下载与制作Windows 10安装介质1、下载Windows 10镜像文件:访问微软官网,下载最新的Windows 10 22H2版本ISO镜像文件。

建议选择官方渠道,确保镜像的安全性和完整性。

2、制作启动U盘:使用微软官方的Media Creation Tool(媒体创建工具)制作启动U盘。

插入空白U盘(建议容量8GB以上),运行工具,选择“为另一台电脑创建安装介质”,按照提示完成制作。

此U盘将作为系统安装的启动盘,确保操作的便捷性和安全性。

3、验证U盘启动:制作完成后,将U盘插入目标电脑,重启并进入BIOS设置,将启动顺序调整为U盘优先启动。

确认U盘可以正常引导,避免后续安装中出现问题。

三、正式升级流程:从Win7到Win101、进入安装界面:插入制作好的启动U盘,重启电脑,进入BIOS设置,选择U盘启动。

系统会加载Windows安装程序,进入安装界面。

2、选择安装类型:在“安装Windows”界面,选择“自定义:仅安装Windows(高级)”。

此方式允许你选择目标硬盘分区,进行全新安装或升级安装。

3、硬盘分区管理:建议在安装前对硬盘进行分区整理,确保系统分区(通常为C盘)有足够空间(建议至少50GB以上),并删除旧系统分区(注意备份数据)。

如果你希望保留部分数据,可以选择“升级”选项,但建议进行全新安装以获得更稳定的系统体验。

4、安装过程:按照提示选择目标分区,确认无误后开始安装。

整个过程可能需要20-40分钟,期间电脑会多次重启。

请勿中断,确保电源稳定。

5、首次启动配置:安装完成后,系统会引导你进行初次设置,包括地区、语言、网络连接、微软账号登录等。

建议使用微软账号登录,以同步设置和应用。

6、驱动与软件安装:系统安装完成后,建议立即安装硬件驱动程序,确保硬件正常工作。

可以使用驱动备份软件或从设备制造商官网下载最新驱动程序。

此外,安装常用软件和安全防护软件,确保系统安全与高效运行。

四、升级后优化与常见问题解决1、系统更新:完成安装后,立即检查Windows Update,下载并安装所有最新的安全补丁和功能更新,确保系统安全稳定。

2、驱动兼容性:部分硬件在升级后可能出现驱动不兼容问题。

可以通过设备管理器检查硬件状态,必要时手动更新驱动或使用制造商提供的驱动程序包。

3、性能优化:关闭不必要的启动项和后台程序,调整虚拟内存,优化系统性能。

可以使用Windows自带的“性能监视器”或第三方优化工具进行调优。

4、常见故障排查:如系统启动缓慢、蓝屏、驱动冲突等问题,建议使用系统还原点恢复,或重装系统。

确保备份的系统镜像可用,以便快速恢复到稳定状态。

五、系统安全与维护建议1、启用Windows Defender:确保系统自带的安全防护开启,定期扫描病毒和恶意软件。

2、定期更新:保持系统和驱动程序的最新状态,避免安全漏洞和兼容性问题。

3、备份策略:建立定期备份习惯,尤其是在进行重大系统变更前,确保数据安全无忧。

4、硬件维护:保持硬件清洁,定期检测硬盘健康状态(如使用CrystalDiskInfo),延长硬件使用寿命。

拓展知识:1、Windows 10的优势:相比Win7,Win10提供了更强的安全性、更好的多任务处理能力、更丰富的应用生态系统以及持续的系统更新支持。

例如,Win10引入了虚拟桌面、多窗口管理、Cortana语音助手等实用功能,极大提升了用户体验。

2、升级策略建议:对于硬件较老的设备(如2014年前的机型),升级到Win10可能会遇到性能瓶颈。

建议先评估硬件性能,必要时考虑硬件升级或全新购买设备,以获得更好的使用体验。

3、系统迁移技巧:如果你希望在升级过程中保留旧系统环境,可以考虑使用系统镜像备份或迁移工具,将旧系统完整迁移到新硬盘或新系统环境中,减少配置和软件重新安装的繁琐。

4、常见误区:部分用户误以为升级后无需重新安装软件,实际上许多软件在新系统中可能需要重新激活或更新。

建议在升级前做好软件清单,逐一确认兼容性和激活状态。

总结:从Windows 7升级到Windows 10是提升系统安全性、体验和功能的有效途径。

整个过程包括硬件兼容性确认、数据备份、制作启动介质、正式安装以及后续优化。

操作过程中应注意备份重要数据,确保驱动程序的兼容性,并在升级后及时进行系统更新和性能调优。

通过科学合理的升级策略,用户可以最大程度地减少故障风险,享受Windows 10带来的全新体验。

未来,随着技术的不断发展,持续关注系统安全和硬件升级,将为数字生活提供更坚实的保障。

菜科网系统致力于解决 Windows 系统重装解决方案,提供高效、安全、免费的系统重装服务。

?Win10家庭版升级专业版详细教程与注意事项?

想重装系统不会怎么办?菜科网一键重装系统轻松在线帮您搞定系统重装问题。软件支持 在线重装、U盘制作、自定义重装 等多种模式。

Win10家庭版升级专业版详细教程与注意事项简介:Windows 10作为微软推出的主流操作系统之一,广泛应用于个人用户、企业和教育机构中。

家庭版(Windows 10 Home)适合普通用户使用,但在某些场景下,专业版(Windows 10 Pro)提供了更丰富的功能,如远程桌面、组策略管理、BitLocker加密等,满足更高安全性和管理需求。

许多用户在使用家庭版时,出于工作或安全考虑,选择将系统升级到专业版。

本文将详细介绍Win10家庭版升级到专业版的操作流程、注意事项及相关知识,帮助用户安全、顺利完成升级。

工具原料:电脑品牌型号:联想ThinkPad X1 Carbon 2022、Dell XPS 13 9310、华为MateBook X Pro 2022操作系统版本:Windows 10家庭版(版本21H2或22H2)软件版本:Windows 10最新的更新补丁(截至2023年10月)激活码:正版Windows 10专业版激活密钥(购买正版授权或企业批量授权)一、升级前的准备工作1、确认系统版本:在“设置”“系统”“关于”中查看当前Windows版本,确保为家庭版(Windows 10 Home)且版本为21H2或22H2。

只有家庭版才能通过数字许可证或激活码升级到专业版。

2、备份重要数据:升级过程中可能会出现意外情况,建议提前备份C盘重要文件、文档、照片等,避免数据丢失。

可以使用Windows自带的备份工具或第三方备份软件进行备份。

3、确保系统已更新:在“设置”“更新与安全”中检查Windows更新,安装所有可用的补丁,确保系统稳定性和兼容性。

4、准备激活密钥:购买正版专业版激活码,确保其来源正规,避免使用非授权或破解密钥,以免影响系统稳定性和安全性。

二、升级流程详解1、打开“设置”“更新与安全”“激活”。

2、在“升级你的Windows”部分,点击“更改产品密钥”。

3、输入正版的Windows 10专业版激活码,点击“下一步”。

系统会自动验证密钥的有效性,若验证成功,系统会提示“激活成功”。

4、如果没有激活码,可以选择“前往Microsoft Store”购买正版升级包,或使用数字许可证自动激活(如果之前已在其他设备激活过专业版)。

5、等待系统自动下载和安装专业版升级文件,过程中请勿关闭电脑。

升级完成后,系统会自动重启,完成升级。

6、升级完成后,再次进入“设置激活”,确认系统已显示“Windows 10专业版”并已激活状态。

三、升级后常见问题及解决方案1、激活失败:确认激活码是否正确、有效,或尝试重新输入。

若仍无法激活,可联系微软客服或通过“命令提示符”执行激活命令(如slmgr /ipk)进行手动激活。

2、系统性能问题:升级后若出现卡顿或异常,建议运行“系统文件检查器”命令(sfc /scannow)修复系统文件,或重启电脑后观察表现。

3、功能缺失:确保已登录Microsoft账户,部分功能(如远程桌面)需要手动开启或配置。

可以在“设置系统远程桌面”中开启相关功能。

4、驱动兼容性:升级后可能出现硬件驱动不兼容问题,建议访问硬件制造商官网下载安装最新驱动程序,确保硬件正常工作。

拓展知识:1、Windows 10专业版的优势:除了家庭版的基本功能外,专业版支持组策略管理、企业级安全策略、BitLocker硬盘加密、远程桌面、加入域等,适合需要更高安全性和管理能力的用户。

2、激活方式:专业版激活可以通过数字许可证(Digital License)自动激活,也可以使用批量激活工具或企业批量授权密钥。

建议购买正版授权,避免使用破解软件,以确保系统安全和稳定。

3、升级的影响:升级过程中,系统会保留用户数据和应用程序,但某些个性化设置可能会重置。

建议提前备份配置文件和重要信息。

4、常见误区:部分用户误以为升级会导致系统变慢或不稳定,实际上只要系统环境良好,升级后性能不会下降,反而能享受更多高级功能。

确保系统已打补丁、驱动正常,能有效避免潜在问题。

背景知识:Windows 10的不同版本主要区别在于功能集,家庭版适合普通用户,专业版则面向企业和高级用户。

升级到专业版后,可以更好地进行系统管理和安全控制,特别是在企业环境中,组策略和远程管理功能尤为重要。

总结:升级Windows 10家庭版到专业版是提升系统安全性和管理能力的重要途径。

整个过程相对简单,但需要提前准备激活码、备份数据,并确保系统已更新。

升级后,用户可以享受更多高级功能,满足工作和安全需求。

建议用户在操作过程中严格按照步骤进行,避免误操作导致系统异常。

通过合理的准备和操作,普通用户也能轻松实现系统升级,提升使用体验和系统安全性。

标签: 注意:本站所刊载的文章均为学习交流之用,请勿用于商业用途。

对于商业使用,请联系各自版权所有者,否则法律问题自行承担。

Win10家庭版升级专业版详细教程与注意事项 分类于: 回答于:2025-08-09 Win10家庭版升级专业版详细教程与注意事项简介:Windows 10作为微软推出的主流操作系统之一,广泛应用于个人用户、企业和教育机构中。

家庭版(Windows 10 Home)适合普通用户使用,但在某些场景下,专业版(Windows 10 Pro)提供了更丰富的功能,如远程桌面、组策略管理、BitLocker加密等,满足更高安全性和管理需求。

许多用户在使用家庭版时,出于工作或安全考虑,选择将系统升级到专业版。

本文将详细介绍Win10家庭版升级到专业版的操作流程、注意事项及相关知识,帮助用户安全、顺利完成升级。

工具原料:电脑品牌型号:联想ThinkPad X1 Carbon 2022、Dell XPS 13 9310、华为MateBook X Pro 2022操作系统版本:Windows 10家庭版(版本21H2或22H2)软件版本:Windows 10最新的更新补丁(截至2023年10月)激活码:正版Windows 10专业版激活密钥(购买正版授权或企业批量授权)一、升级前的准备工作1、确认系统版本:在“设置”“系统”“关于”中查看当前Windows版本,确保为家庭版(Windows 10 Home)且版本为21H2或22H2。

只有家庭版才能通过数字许可证或激活码升级到专业版。

2、备份重要数据:升级过程中可能会出现意外情况,建议提前备份C盘重要文件、文档、照片等,避免数据丢失。

可以使用Windows自带的备份工具或第三方备份软件进行备份。

3、确保系统已更新:在“设置”“更新与安全”中检查Windows更新,安装所有可用的补丁,确保系统稳定性和兼容性。

4、准备激活密钥:购买正版专业版激活码,确保其来源正规,避免使用非授权或破解密钥,以免影响系统稳定性和安全性。

二、升级流程详解1、打开“设置”“更新与安全”“激活”。

2、在“升级你的Windows”部分,点击“更改产品密钥”。

3、输入正版的Windows 10专业版激活码,点击“下一步”。

系统会自动验证密钥的有效性,若验证成功,系统会提示“激活成功”。

4、如果没有激活码,可以选择“前往Microsoft Store”购买正版升级包,或使用数字许可证自动激活(如果之前已在其他设备激活过专业版)。

5、等待系统自动下载和安装专业版升级文件,过程中请勿关闭电脑。

升级完成后,系统会自动重启,完成升级。

6、升级完成后,再次进入“设置激活”,确认系统已显示“Windows 10专业版”并已激活状态。

三、升级后常见问题及解决方案1、激活失败:确认激活码是否正确、有效,或尝试重新输入。

若仍无法激活,可联系微软客服或通过“命令提示符”执行激活命令(如slmgr /ipk)进行手动激活。

2、系统性能问题:升级后若出现卡顿或异常,建议运行“系统文件检查器”命令(sfc /scannow)修复系统文件,或重启电脑后观察表现。

3、功能缺失:确保已登录Microsoft账户,部分功能(如远程桌面)需要手动开启或配置。

可以在“设置系统远程桌面”中开启相关功能。

4、驱动兼容性:升级后可能出现硬件驱动不兼容问题,建议访问硬件制造商官网下载安装最新驱动程序,确保硬件正常工作。

拓展知识:1、Windows 10专业版的优势:除了家庭版的基本功能外,专业版支持组策略管理、企业级安全策略、BitLocker硬盘加密、远程桌面、加入域等,适合需要更高安全性和管理能力的用户。

2、激活方式:专业版激活可以通过数字许可证(Digital License)自动激活,也可以使用批量激活工具或企业批量授权密钥。

建议购买正版授权,避免使用破解软件,以确保系统安全和稳定。

3、升级的影响:升级过程中,系统会保留用户数据和应用程序,但某些个性化设置可能会重置。

建议提前备份配置文件和重要信息。

4、常见误区:部分用户误以为升级会导致系统变慢或不稳定,实际上只要系统环境良好,升级后性能不会下降,反而能享受更多高级功能。

确保系统已打补丁、驱动正常,能有效避免潜在问题。

背景知识:Windows 10的不同版本主要区别在于功能集,家庭版适合普通用户,专业版则面向企业和高级用户。

升级到专业版后,可以更好地进行系统管理和安全控制,特别是在企业环境中,组策略和远程管理功能尤为重要。

总结:升级Windows 10家庭版到专业版是提升系统安全性和管理能力的重要途径。

整个过程相对简单,但需要提前准备激活码、备份数据,并确保系统已更新。

升级后,用户可以享受更多高级功能,满足工作和安全需求。

建议用户在操作过程中严格按照步骤进行,避免误操作导致系统异常。

通过合理的准备和操作,普通用户也能轻松实现系统升级,提升使用体验和系统安全性。

菜科网系统致力于解决 Windows 系统重装解决方案,提供高效、安全、免费的系统重装服务。

猜你喜欢