揭秘Win7自动关机原因及解决方法,专业知识分享

了解更多Win7自动关机技巧,优化您的操作体验。

【菜科解读】

在使用Windows 7操作系统的过程中,许多用户可能会遇到电脑自动关机的问题。

这不仅影响了工作和娱乐的连续性,还可能导致数据丢失。

本文将揭秘Win7自动关机的原因,并提供详细的解决方法,帮助用户更好地管理和维护自己的电脑。

工具原料:

系统版本:Windows 7 SP1

品牌型号:Dell XPS 13 (2021款)、HP Spectre x360 (2021款)

软件版本:BIOS最新版本、Windows Update最新补丁

一、Win7自动关机的常见原因

1、硬件过热

硬件过热是导致电脑自动关机的常见原因之一。

CPU、GPU等关键部件在高负荷运行时会产生大量热量,如果散热不良,温度过高会触发自动关机保护机制。

2、电源问题

电源供应不稳定或电源适配器故障也可能导致电脑自动关机。

电源问题不仅会影响电脑的正常运行,还可能对硬件造成损害。

3、系统设置

Windows 7系统中某些设置可能会导致自动关机。

例如,电源管理设置中的“自动关机”选项,或者计划任务中的关机命令。

4、病毒或恶意软件

病毒或恶意软件可能会通过修改系统文件或设置来触发自动关机。

这类问题通常伴随着其他异常行为,如系统变慢、弹出广告等。

二、解决Win7自动关机的方法

1、检查硬件温度

使用HWMonitor等工具监控CPU、GPU的温度。

如果温度过高,建议清理散热器、更换散热硅脂或增加散热设备。

2、检查电源供应

确保电源适配器和电源线正常工作。

可以尝试更换电源适配器或使用不间断电源(UPS)来稳定电源供应。

3、调整系统设置

进入控制面板,检查电源管理设置,确保没有设置自动关机选项。

还可以检查计划任务,删除不必要的关机任务。

4、扫描并清除病毒

使用Windows Defender或其他杀毒软件进行全盘扫描,清除病毒和恶意软件。

定期更新杀毒软件和系统补丁,保持系统安全。

三、背景知识

1、Windows 7的历史

Windows 7是微软公司于2009年发布的操作系统,作为Windows Vista的继任者,Win7在用户界面和性能上进行了大量改进,广受用户好评。

尽管微软已于2020年停止对Win7的主流支持,但由于其稳定性和兼容性,仍有大量用户在使用。

2、硬件散热技术的发展

随着计算机性能的提升,硬件散热技术也在不断进步。

从早期的风冷散热到现在的液冷散热,甚至是热管散热技术,散热效率得到了显著提升。

然而,用户仍需定期维护散热系统,确保其正常工作。

内容延伸:

1、如何预防电脑自动关机

除了上述解决方法,用户还可以采取一些预防措施。

例如,定期清理电脑内部灰尘,保持良好的通风环境,避免长时间高负荷运行等。

2、其他操作系统的自动关机问题

不仅是Windows 7,其他操作系统如Windows 10、macOS等也可能遇到自动关机问题。

用户可以参考类似的方法进行排查和解决。

3、使用第三方工具进行系统优化

一些第三方工具如CCleaner、Advanced SystemCare等可以帮助用户优化系统设置,清理垃圾文件,提升系统稳定性,减少自动关机的可能性。

?笔记本重装win7系统的详细步骤与注意事项?

想重装系统不会怎么办?菜科网一键重装系统轻松在线帮您搞定系统重装问题。

软件支持 在线重装、U盘制作、自定义重装 等多种模式。

简介:随着科技的不断发展,笔记本电脑已成为人们日常工作、学习和娱乐的重要工具。

尤其是在使用过程中,系统的稳定性和性能直接影响用户体验。

Windows 7作为一款经典的操作系统,因其稳定性和兼容性仍被部分用户青睐。

然而,随着时间推移,系统可能出现运行缓慢、病毒感染或硬件兼容性问题,重装系统成为解决这些问题的有效途径。

本文将详细介绍笔记本重装Win7系统的步骤与注意事项,帮助用户安全、快速地完成系统重装,提升设备性能。

工具原料:电脑品牌型号:联想ThinkPad X1 Carbon 2022版、戴尔XPS 13 9310、华为MateBook 14 2023版操作系统版本:Windows 7 Ultimate SP1 64位软件版本:Windows 7官方原版镜像(ISO文件)、Rufus 3.20、驱动程序包(根据硬件型号下载)其他工具:U盘(容量8GB以上)、一台正常工作的电脑、网络连接(用于下载驱动和系统镜像)一、准备工作与环境搭建1、备份重要数据:在重装系统前,务必将重要文件、照片、文档等备份到外部存储设备或云端,避免数据丢失。

可以使用U盘、移动硬盘或云存储服务(如百度云、OneDrive)进行备份。

2、确认硬件兼容性:确保笔记本硬件支持Windows 7,尤其是新型号硬件可能存在驱动兼容性问题。

建议提前在官网查找对应硬件的驱动程序,或准备好驱动包备用。

3、准备系统镜像:下载官方Windows 7 ISO镜像文件,建议选择官方原版,确保系统安全稳定。

可以从微软官方网站或可信的第三方镜像站点获取。

4、制作启动U盘:使用Rufus等工具,将ISO镜像写入U盘,制作成启动盘。

操作步骤包括选择ISO文件、设置分区类型(MBR或GPT,根据硬件支持情况)、启动方式(BIOS或UEFI)等。

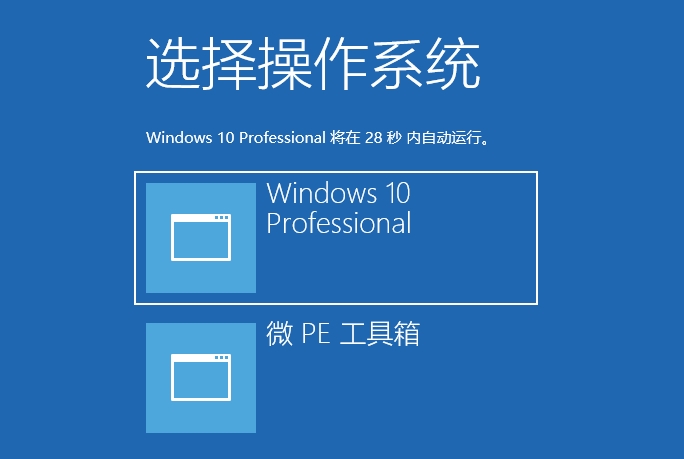

二、设置BIOS/UEFI启动项1、进入BIOS/UEFI:开机时按下特定按键(如F2、F12、DEL或ESC)进入设置界面。

不同品牌型号略有差异,建议查阅设备手册或官网指导。

2、调整启动顺序:将U盘设置为第一启动项,确保系统可以从U盘启动。

关闭安全启动(Secure Boot)选项,启用Legacy BIOS(如果适用),以兼容Windows 7的启动方式。

3、保存设置并重启:确认设置无误后,保存退出,设备将从U盘启动进入系统安装界面。

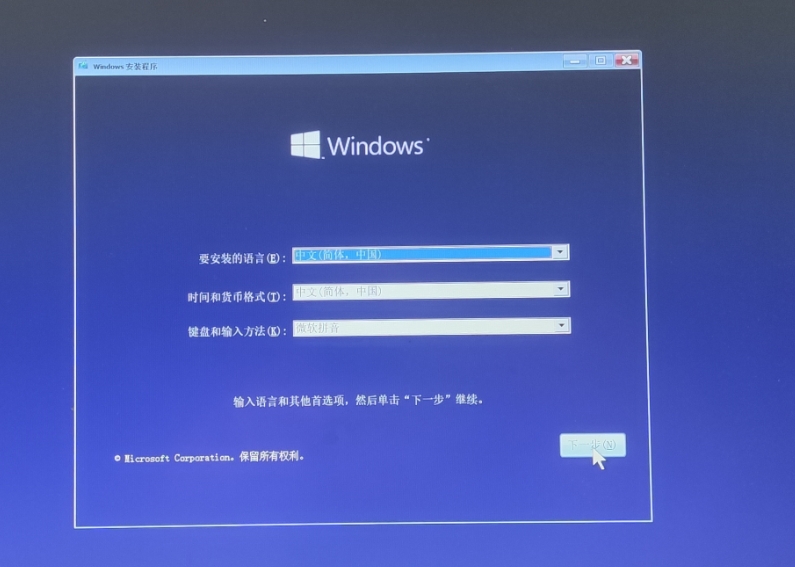

三、系统安装流程1、启动安装程序:插入制作好的启动U盘,重启电脑,系统会自动从U盘启动,进入Windows 7安装界面。

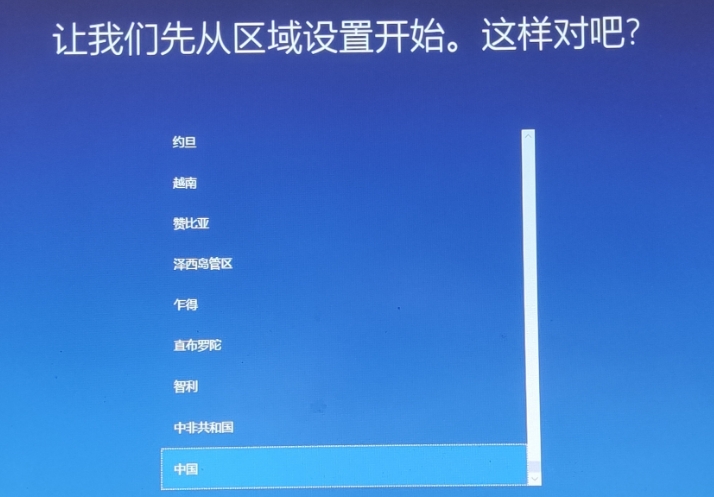

2、选择语言和区域:根据实际需求选择合适的语言、时间和货币格式、键盘输入方式,点击“下一步”。

3、开始安装:点击“安装”按钮,输入产品密钥(如果有),或选择稍后输入。

接受许可协议,点击“下一步”。

4、选择安装类型:建议选择“自定义(高级)”安装方式,以便格式化硬盘和进行全新安装。

5、硬盘分区:在分区界面,删除旧分区(注意备份数据),创建新分区,建议将系统安装在主分区(如C盘),格式化后继续安装。

6、安装过程:系统会自动复制文件、安装驱动和配置环境,整个过程可能需要20-30分钟,期间不要断电或中断操作。

7、首次启动:安装完成后,系统会自动重启,进入Windows 7的初始设置界面。

根据提示设置用户名、密码、区域等信息。

四、驱动安装与系统优化1、驱动程序安装:进入系统后,首先安装硬件驱动。

可以使用设备管理器检测未识别设备,访问硬件厂商官网(如联想、戴尔、华为)下载对应驱动包,或使用驱动管理软件(如Driver Booster)辅助安装。

2、系统更新:虽然Windows 7官方已停止主流支持,但仍可通过微软的“Windows Update”获取安全补丁和重要更新,确保系统安全性。

3、性能优化:关闭不必要的启动项和后台服务,调整视觉效果,启用硬盘高速缓存,安装杀毒软件(如360安全卫士、腾讯安全管家)以保障系统安全。

4、备份系统:完成系统配置后,建议使用系统自带的备份工具或第三方软件(如AOMEI Backupper)创建系统镜像,方便日后快速恢复。

五、常见问题与解决方案1、无法从U盘启动:确认U盘制作正确,BIOS设置正确,启动顺序已调整。

尝试重新制作启动盘或更换U盘。

2、驱动无法识别硬件:确保下载的驱动版本适配Windows 7,必要时联系硬件厂商获取最新驱动包,或使用通用驱动程序。

3、系统安装后性能不佳:检查硬件兼容性,确保驱动正确安装,关闭不必要的后台程序,进行系统优化。

4、系统出现蓝屏或死机:可能是驱动冲突或硬件故障,尝试进入安全模式卸载最近安装的驱动或软件,必要时进行硬件检测。

拓展知识:1、关于Windows 7的支持:微软已于2020年1月停止对Windows 7的主流支持,但企业用户仍可通过“扩展安全更新”获得部分补丁。

个人用户建议尽快升级到Windows 10或Windows 11,以获得更好的安全性和性能保障。

2、硬件兼容性注意事项:新硬件(如NVMe固态硬盘、USB-C接口设备)在Windows 7上可能存在驱动缺失问题。

建议在重装前确认硬件支持情况,或考虑升级操作系统以获得更好的硬件支持。

3、系统安全建议:安装正版系统和驱动,定期更新,使用强密码,避免下载未知来源的软件,开启防火墙和杀毒软件,确保系统安全稳定运行。

4、系统维护技巧:定期清理垃圾文件、碎片整理、监控硬件状态,及时更新驱动和补丁,保持系统良好状态,延长硬件使用寿命。

总结:笔记本重装Windows 7系统虽然步骤繁琐,但只要按照正确流程操作,配合合理的工具和准备工作,完全可以实现安全、快速的系统重装。

重装系统不仅能解决系统运行缓慢、病毒感染等问题,还能优化硬件性能,延长设备使用寿命。

值得注意的是,随着技术的发展,建议用户逐步考虑升级到更现代的操作系统,以获得更好的安全性和兼容性。

希望本文的详细步骤和注意事项能帮助广大用户顺利完成系统重装,提升数码设备的使用体验。

标签: 注意:本站所刊载的文章均为学习交流之用,请勿用于商业用途。

对于商业使用,请联系各自版权所有者,否则法律问题自行承担。

笔记本重装win7系统的详细步骤与注意事项 分类于: 回答于:2025-08-09 简介:随着科技的不断发展,笔记本电脑已成为人们日常工作、学习和娱乐的重要工具。

尤其是在使用过程中,系统的稳定性和性能直接影响用户体验。

Windows 7作为一款经典的操作系统,因其稳定性和兼容性仍被部分用户青睐。

然而,随着时间推移,系统可能出现运行缓慢、病毒感染或硬件兼容性问题,重装系统成为解决这些问题的有效途径。

本文将详细介绍笔记本重装Win7系统的步骤与注意事项,帮助用户安全、快速地完成系统重装,提升设备性能。

工具原料:电脑品牌型号:联想ThinkPad X1 Carbon 2022版、戴尔XPS 13 9310、华为MateBook 14 2023版操作系统版本:Windows 7 Ultimate SP1 64位软件版本:Windows 7官方原版镜像(ISO文件)、Rufus 3.20、驱动程序包(根据硬件型号下载)其他工具:U盘(容量8GB以上)、一台正常工作的电脑、网络连接(用于下载驱动和系统镜像)一、准备工作与环境搭建1、备份重要数据:在重装系统前,务必将重要文件、照片、文档等备份到外部存储设备或云端,避免数据丢失。

可以使用U盘、移动硬盘或云存储服务(如百度云、OneDrive)进行备份。

2、确认硬件兼容性:确保笔记本硬件支持Windows 7,尤其是新型号硬件可能存在驱动兼容性问题。

建议提前在官网查找对应硬件的驱动程序,或准备好驱动包备用。

3、准备系统镜像:下载官方Windows 7 ISO镜像文件,建议选择官方原版,确保系统安全稳定。

可以从微软官方网站或可信的第三方镜像站点获取。

4、制作启动U盘:使用Rufus等工具,将ISO镜像写入U盘,制作成启动盘。

操作步骤包括选择ISO文件、设置分区类型(MBR或GPT,根据硬件支持情况)、启动方式(BIOS或UEFI)等。

二、设置BIOS/UEFI启动项1、进入BIOS/UEFI:开机时按下特定按键(如F2、F12、DEL或ESC)进入设置界面。

不同品牌型号略有差异,建议查阅设备手册或官网指导。

2、调整启动顺序:将U盘设置为第一启动项,确保系统可以从U盘启动。

关闭安全启动(Secure Boot)选项,启用Legacy BIOS(如果适用),以兼容Windows 7的启动方式。

3、保存设置并重启:确认设置无误后,保存退出,设备将从U盘启动进入系统安装界面。

三、系统安装流程1、启动安装程序:插入制作好的启动U盘,重启电脑,系统会自动从U盘启动,进入Windows 7安装界面。

2、选择语言和区域:根据实际需求选择合适的语言、时间和货币格式、键盘输入方式,点击“下一步”。

3、开始安装:点击“安装”按钮,输入产品密钥(如果有),或选择稍后输入。

接受许可协议,点击“下一步”。

4、选择安装类型:建议选择“自定义(高级)”安装方式,以便格式化硬盘和进行全新安装。

5、硬盘分区:在分区界面,删除旧分区(注意备份数据),创建新分区,建议将系统安装在主分区(如C盘),格式化后继续安装。

6、安装过程:系统会自动复制文件、安装驱动和配置环境,整个过程可能需要20-30分钟,期间不要断电或中断操作。

7、首次启动:安装完成后,系统会自动重启,进入Windows 7的初始设置界面。

根据提示设置用户名、密码、区域等信息。

四、驱动安装与系统优化1、驱动程序安装:进入系统后,首先安装硬件驱动。

可以使用设备管理器检测未识别设备,访问硬件厂商官网(如联想、戴尔、华为)下载对应驱动包,或使用驱动管理软件(如Driver Booster)辅助安装。

2、系统更新:虽然Windows 7官方已停止主流支持,但仍可通过微软的“Windows Update”获取安全补丁和重要更新,确保系统安全性。

3、性能优化:关闭不必要的启动项和后台服务,调整视觉效果,启用硬盘高速缓存,安装杀毒软件(如360安全卫士、腾讯安全管家)以保障系统安全。

4、备份系统:完成系统配置后,建议使用系统自带的备份工具或第三方软件(如AOMEI Backupper)创建系统镜像,方便日后快速恢复。

五、常见问题与解决方案1、无法从U盘启动:确认U盘制作正确,BIOS设置正确,启动顺序已调整。

尝试重新制作启动盘或更换U盘。

2、驱动无法识别硬件:确保下载的驱动版本适配Windows 7,必要时联系硬件厂商获取最新驱动包,或使用通用驱动程序。

3、系统安装后性能不佳:检查硬件兼容性,确保驱动正确安装,关闭不必要的后台程序,进行系统优化。

4、系统出现蓝屏或死机:可能是驱动冲突或硬件故障,尝试进入安全模式卸载最近安装的驱动或软件,必要时进行硬件检测。

拓展知识:1、关于Windows 7的支持:微软已于2020年1月停止对Windows 7的主流支持,但企业用户仍可通过“扩展安全更新”获得部分补丁。

个人用户建议尽快升级到Windows 10或Windows 11,以获得更好的安全性和性能保障。

2、硬件兼容性注意事项:新硬件(如NVMe固态硬盘、USB-C接口设备)在Windows 7上可能存在驱动缺失问题。

建议在重装前确认硬件支持情况,或考虑升级操作系统以获得更好的硬件支持。

3、系统安全建议:安装正版系统和驱动,定期更新,使用强密码,避免下载未知来源的软件,开启防火墙和杀毒软件,确保系统安全稳定运行。

4、系统维护技巧:定期清理垃圾文件、碎片整理、监控硬件状态,及时更新驱动和补丁,保持系统良好状态,延长硬件使用寿命。

总结:笔记本重装Windows 7系统虽然步骤繁琐,但只要按照正确流程操作,配合合理的工具和准备工作,完全可以实现安全、快速的系统重装。

重装系统不仅能解决系统运行缓慢、病毒感染等问题,还能优化硬件性能,延长设备使用寿命。

值得注意的是,随着技术的发展,建议用户逐步考虑升级到更现代的操作系统,以获得更好的安全性和兼容性。

希望本文的详细步骤和注意事项能帮助广大用户顺利完成系统重装,提升数码设备的使用体验。

菜科网系统致力于解决 Windows 系统重装解决方案,提供高效、安全、免费的系统重装服务。

?win7升级win8详细步骤与注意事项?

想重装系统不会怎么办?菜科网一键重装系统轻松在线帮您搞定系统重装问题。软件支持 在线重装、U盘制作、自定义重装 等多种模式。

电脑品牌型号:Dell XPS 13 9300、Lenovo ThinkPad X1 Carbon 2020、HP Spectre x360 14等操作系统版本:Windows 7 SP1(旗舰版/专业版/家庭版)软件版本:Windows 8.1(含Update 1)存储设备:至少128GB SSD或更大容量硬盘备份工具:外接硬盘、云存储(如OneDrive、Google Drive)驱动程序:硬件制造商提供的最新驱动程序包安装介质:Windows 8.1官方ISO镜像文件、U盘(容量至少8GB)一、升级前的准备工作1、备份重要数据:在升级前,务必将个人文件、工作资料、照片、视频等重要数据进行完整备份。

可以使用外接硬盘、云存储或专用备份软件(如AOMEI Backupper)进行备份,确保数据安全,避免升级过程中出现意外导致数据丢失。

2、确认硬件兼容性:检查电脑硬件是否满足Windows 8的最低配置要求。

一般来说,Intel Core i3/i5/i7处理器,4GB以上内存,支持UEFI启动的主板,支持Secure Boot的硬件都能良好运行Windows 8。

建议访问硬件制造商官网,确认驱动程序支持情况,特别是显卡、声卡、网卡等关键硬件。

3、清理系统和空间:卸载不必要的软件,清理临时文件,确保硬盘有至少20%的剩余空间。

建议使用系统自带的磁盘清理工具或第三方软件(如CCleaner)进行优化,避免空间不足影响升级过程。

4、获取Windows 8.1安装介质:访问微软官方网站,下载Windows 8.1 ISO镜像文件,制作启动U盘。

确保ISO文件为官方正版,避免使用非官方版本带来的安全风险。

二、升级步骤详解1、创建启动U盘:使用微软提供的“Windows USB/DVD Download Tool”或Rufus软件,将ISO镜像写入U盘,制作启动盘。

操作时选择GPT分区方案,确保支持UEFI启动。

2、设置BIOS/UEFI:重启电脑,进入BIOS/UEFI设置界面(通常按F2、DEL或Esc键),将启动模式切换为UEFI,关闭安全启动(Secure Boot),以确保U盘启动正常。

保存设置后退出。

3、启动安装程序:插入U盘,重启电脑,选择从USB设备启动。

进入Windows安装界面后,选择“自定义安装”。

4、分区选择与格式化:在安装界面中,选择原Windows 7所在的系统分区(通常为C盘),建议先格式化该分区(注意备份数据),以确保干净安装。

若不想丢失数据,可选择升级安装,但建议备份后进行全新安装以获得更佳性能。

5、安装过程:按照提示完成安装,系统会自动复制文件、安装驱动和更新。

整个过程大约需要30-60分钟,期间电脑会多次重启。

6、激活与驱动:安装完成后,进入Windows 8.1系统,连接网络,激活系统(若有正版密钥),并安装硬件驱动程序。

建议从硬件制造商官网下载最新驱动,确保硬件兼容性和性能表现。

7、系统优化:关闭不必要的启动项,调整电源管理设置,安装常用软件,恢复备份数据。

建议开启Windows Update,下载最新的安全补丁和功能更新。

三、升级后的注意事项与常见问题解决1、驱动兼容性:部分旧硬件在Windows 8.1上可能出现驱动不兼容问题。

建议优先使用官方驱动,必要时使用兼容模式安装驱动程序,或联系硬件厂商获取支持。

2、系统性能优化:关闭不必要的后台程序,调整视觉效果,启用快速启动,提升系统响应速度。

可以使用“性能监视器”检测瓶颈所在。

3、软件兼容性:部分旧软件在Windows 8.1上可能出现兼容性问题。

可以使用“兼容性模式”运行程序,或寻找更新版本替代。

4、常见故障排查:如系统启动缓慢、蓝屏、驱动崩溃等问题,建议使用“系统还原”或“重置此电脑”功能,必要时重新安装系统或联系专业技术支持。

拓展知识:1、Windows 8.1的优势:相比Windows 7,Windows 8.1引入了更快的启动速度、更好的多任务处理能力、内置的应用商店和改进的安全机制。

特别是在触控设备和二合一笔记本上,界面优化带来更佳体验。

2、UEFI与Secure Boot:现代硬件普遍支持UEFI启动和Secure Boot,有助于提升系统安全性。

升级前应确认硬件支持,避免启动失败。

3、系统迁移技巧:建议在升级前创建系统映像备份,遇到问题时可以快速还原到原始状态。

使用第三方工具(如AOMEI Backupper、Macrium Reflect)可以简化备份与还原流程。

4、Windows 8.1的维护:定期更新系统补丁,安装杀毒软件,清理临时文件,保持系统稳定。

建议开启“Windows Defender”或第三方安全软件,保障系统安全。

总结:从Windows 7升级到Windows 8.1是提升系统性能、安全性和使用体验的重要步骤。

整个过程需要充分准备,包括备份数据、确认硬件兼容性、制作启动介质等。

按照步骤操作,注意驱动和兼容性问题,能有效避免升级中的常见故障。

升级后,建议进行系统优化和安全维护,充分发挥Windows 8.1的优势,为日常工作和娱乐提供更流畅的体验。

未来,随着硬件和软件的不断更新,用户应持续关注系统安全和性能,保持设备的最佳状态。

标签: 注意:本站所刊载的文章均为学习交流之用,请勿用于商业用途。

对于商业使用,请联系各自版权所有者,否则法律问题自行承担。

win7升级win8详细步骤与注意事项 分类于: 回答于:2025-08-10 电脑品牌型号:Dell XPS 13 9300、Lenovo ThinkPad X1 Carbon 2020、HP Spectre x360 14等操作系统版本:Windows 7 SP1(旗舰版/专业版/家庭版)软件版本:Windows 8.1(含Update 1)存储设备:至少128GB SSD或更大容量硬盘备份工具:外接硬盘、云存储(如OneDrive、Google Drive)驱动程序:硬件制造商提供的最新驱动程序包安装介质:Windows 8.1官方ISO镜像文件、U盘(容量至少8GB)一、升级前的准备工作1、备份重要数据:在升级前,务必将个人文件、工作资料、照片、视频等重要数据进行完整备份。

可以使用外接硬盘、云存储或专用备份软件(如AOMEI Backupper)进行备份,确保数据安全,避免升级过程中出现意外导致数据丢失。

2、确认硬件兼容性:检查电脑硬件是否满足Windows 8的最低配置要求。

一般来说,Intel Core i3/i5/i7处理器,4GB以上内存,支持UEFI启动的主板,支持Secure Boot的硬件都能良好运行Windows 8。

建议访问硬件制造商官网,确认驱动程序支持情况,特别是显卡、声卡、网卡等关键硬件。

3、清理系统和空间:卸载不必要的软件,清理临时文件,确保硬盘有至少20%的剩余空间。

建议使用系统自带的磁盘清理工具或第三方软件(如CCleaner)进行优化,避免空间不足影响升级过程。

4、获取Windows 8.1安装介质:访问微软官方网站,下载Windows 8.1 ISO镜像文件,制作启动U盘。

确保ISO文件为官方正版,避免使用非官方版本带来的安全风险。

二、升级步骤详解1、创建启动U盘:使用微软提供的“Windows USB/DVD Download Tool”或Rufus软件,将ISO镜像写入U盘,制作启动盘。

操作时选择GPT分区方案,确保支持UEFI启动。

2、设置BIOS/UEFI:重启电脑,进入BIOS/UEFI设置界面(通常按F2、DEL或Esc键),将启动模式切换为UEFI,关闭安全启动(Secure Boot),以确保U盘启动正常。

保存设置后退出。

3、启动安装程序:插入U盘,重启电脑,选择从USB设备启动。

进入Windows安装界面后,选择“自定义安装”。

4、分区选择与格式化:在安装界面中,选择原Windows 7所在的系统分区(通常为C盘),建议先格式化该分区(注意备份数据),以确保干净安装。

若不想丢失数据,可选择升级安装,但建议备份后进行全新安装以获得更佳性能。

5、安装过程:按照提示完成安装,系统会自动复制文件、安装驱动和更新。

整个过程大约需要30-60分钟,期间电脑会多次重启。

6、激活与驱动:安装完成后,进入Windows 8.1系统,连接网络,激活系统(若有正版密钥),并安装硬件驱动程序。

建议从硬件制造商官网下载最新驱动,确保硬件兼容性和性能表现。

7、系统优化:关闭不必要的启动项,调整电源管理设置,安装常用软件,恢复备份数据。

建议开启Windows Update,下载最新的安全补丁和功能更新。

三、升级后的注意事项与常见问题解决1、驱动兼容性:部分旧硬件在Windows 8.1上可能出现驱动不兼容问题。

建议优先使用官方驱动,必要时使用兼容模式安装驱动程序,或联系硬件厂商获取支持。

2、系统性能优化:关闭不必要的后台程序,调整视觉效果,启用快速启动,提升系统响应速度。

可以使用“性能监视器”检测瓶颈所在。

3、软件兼容性:部分旧软件在Windows 8.1上可能出现兼容性问题。

可以使用“兼容性模式”运行程序,或寻找更新版本替代。

4、常见故障排查:如系统启动缓慢、蓝屏、驱动崩溃等问题,建议使用“系统还原”或“重置此电脑”功能,必要时重新安装系统或联系专业技术支持。

拓展知识:1、Windows 8.1的优势:相比Windows 7,Windows 8.1引入了更快的启动速度、更好的多任务处理能力、内置的应用商店和改进的安全机制。

特别是在触控设备和二合一笔记本上,界面优化带来更佳体验。

2、UEFI与Secure Boot:现代硬件普遍支持UEFI启动和Secure Boot,有助于提升系统安全性。

升级前应确认硬件支持,避免启动失败。

3、系统迁移技巧:建议在升级前创建系统映像备份,遇到问题时可以快速还原到原始状态。

使用第三方工具(如AOMEI Backupper、Macrium Reflect)可以简化备份与还原流程。

4、Windows 8.1的维护:定期更新系统补丁,安装杀毒软件,清理临时文件,保持系统稳定。

建议开启“Windows Defender”或第三方安全软件,保障系统安全。

总结:从Windows 7升级到Windows 8.1是提升系统性能、安全性和使用体验的重要步骤。

整个过程需要充分准备,包括备份数据、确认硬件兼容性、制作启动介质等。

按照步骤操作,注意驱动和兼容性问题,能有效避免升级中的常见故障。

升级后,建议进行系统优化和安全维护,充分发挥Windows 8.1的优势,为日常工作和娱乐提供更流畅的体验。

未来,随着硬件和软件的不断更新,用户应持续关注系统安全和性能,保持设备的最佳状态。

菜科网系统致力于解决 Windows 系统重装解决方案,提供高效、安全、免费的系统重装服务。

猜你喜欢