全面qq企业邮箱:提升团队沟通效率的利器

其功能包括大容量存储、团队协作、日历管理等,帮助企业提升沟通效率和信息安全。

选择QQ企业邮箱,助力企业数字化转型,优化内部管理。

【菜科解读】

在现代企业中,沟通效率直接影响到团队的协作和工作成果。

QQ企业邮箱作为一款专为企业用户设计的邮箱服务,凭借其强大的功能和便捷的使用体验,成为提升团队沟通效率的重要工具。

本文将全面解析QQ企业邮箱的特点、优势及其在实际工作中的应用,帮助用户更好地利用这一工具。

工具原料:

电脑品牌型号:联想ThinkPad X1 Carbon Gen 9

手机品牌型号:华为Mate 40 Pro

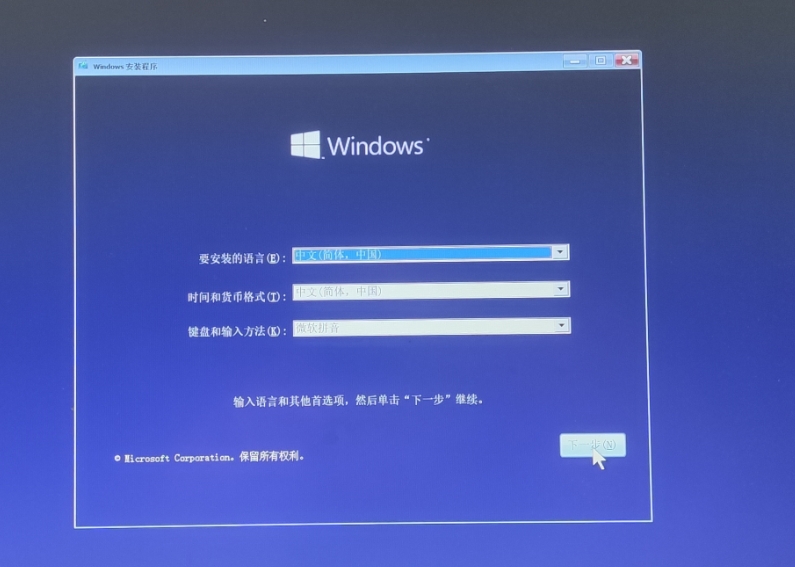

操作系统版本:Windows 11、Android 11

软件版本:QQ企业邮箱最新版本(2023年更新)

一、QQ企业邮箱的基本功能

QQ企业邮箱提供了多种功能,旨在满足企业用户的需求。

首先,它支持大容量存储,用户可以享受高达10GB的邮箱空间,适合存储大量邮件和附件。

其次,QQ企业邮箱具备强大的反垃圾邮件功能,能够有效过滤垃圾邮件,确保用户的收件箱整洁。

此外,企业邮箱还支持多终端同步,用户可以在电脑、手机等多个设备上随时随地访问邮件,极大地方便了工作。

二、提升团队沟通效率的优势

1. 实时沟通与协作:QQ企业邮箱与QQ即时通讯工具无缝集成,用户可以在邮箱中直接发起聊天,快速解决问题,提升沟通效率。

2. 任务管理与日程安排:企业邮箱提供日历功能,用户可以在邮箱中创建日程安排,设置会议提醒,确保团队成员及时了解重要事项。

3. 安全性与隐私保护:QQ企业邮箱采用多重安全机制,包括数据加密和身份验证,确保企业信息的安全性,保护用户隐私。

三、实际应用案例

在某科技公司,团队成员通过QQ企业邮箱进行项目管理。

项目经理利用邮箱的日历功能安排会议,并通过邮件发送项目进度报告。

团队成员在收到邮件后,能够迅速通过QQ进行讨论,及时反馈意见。

这种高效的沟通方式使得项目进展顺利,最终按时完成任务。

此外,某电商企业在促销活动期间,通过QQ企业邮箱向客户发送活动通知和优惠券,结合即时通讯工具进行客户咨询,极大地提升了客户的参与度和满意度。

拓展知识:

1. 企业邮箱的选择标准:在选择企业邮箱时,用户应关注邮箱的存储空间、反垃圾邮件能力、用户界面友好性以及与其他工具的集成能力。

2. 邮件管理技巧:为了提高工作效率,用户可以定期清理邮箱,使用文件夹分类管理邮件,设置邮件优先级,确保重要邮件不被遗漏。

3. 安全意识:企业用户应定期更新密码,开启双重身份验证,避免因密码泄露导致的信息安全问题。

十大最受欢迎的浏览器软件:QQ浏览器上榜,360浏览器排第一

浏览器是我们上网不可缺少的工具,一款好用的pc浏览器对于电脑来说如虎添翼,而不好用的则会让使用者叫苦连连,那么你心中哪款PC浏览器最好呢?现在菜科网小编为大家介绍十大最受欢迎的浏览器软件:QQ浏览器上榜,360浏览器排第一,感兴趣的小伙伴不妨一起往下看!十大最受欢迎的浏览器软件1.360浏览器360浏览器是由360安全中心推出的一款以IE和Chrome双内核为基础的安全浏览器,于360安全卫士和360杀毒等软件产品同为360安全中心系列产品,浏览器还具有恶意网址拦截的功能,独创的沙箱模式使浏览器在隔离模式下依旧可以访问,却不会感染木马病毒。

2.Chrome浏览器这是一款由世界品牌500强排行榜前十的Google公司开发的一款网页浏览器,以稳定性、速度和安全性而闻名,且创造出简单且有效的使用者界面,最初的测试版本在2008年9月2日发布,并提供50种语言版本,支持多平台。

3.QQ浏览器QQ浏览器的前身为TT浏览器,而这款浏览器继承了TT浏览器1-4系列方便易用的特点,只是技术架构不同,在交互和视觉表现方面也重新进行了设计,采用Chromium内核+IE双内核,让用户在浏览时更加快速稳定,拒绝卡顿。

4.火狐浏览器这是一款自由集开放源代码的网页浏览器,搭载Gecko排版引擎,并支持如Windows、Mac OS X及GNU/Linux等多种操作系统,并且分为普通和ESR两个版本,其中ESR版本的升级周期为42周,而普通版本的升级周期则为六周。

5.猎豹浏览器猎豹浏览器是由金山网络推出的一款主打安全和极速特性的浏览器,采用Trident和WebKit双渲染引擎,对Chrome的Webkit内核进行了100多项的技术优化,使得用户访问网页时速度可以更快。

6.搜狗浏览器搜狗浏览器是由搜狗公司基于谷歌chromium内核开发出的一款力求为用户提供跨终端无缝使用体验的浏览器,有着上网更简单和网页阅读更流畅的特点,并且首创网页关注功能,将网站内容以订阅的方式提供给用户浏览。

7.百度浏览器百度浏览器是以满足浏览网页为基础,以强大的搜索平台为依靠的一款具有简洁轻快和智能懂你特点的浏览器,它整合了百度体系业务优势,致力于为用户带来更加方便的浏览方式,并更舒适的百度特色上网体验。

8.UC浏览器这是一款由UC Mobile Limited于2004年8月开发的一款软件,目前已经是全球使用量最大的第三方手机浏览器,截止2016年月活用户就超过了4亿,目前已经是阿里巴巴移动事业部的核心产品,在全球市场份额中占据17.24%,已经超过苹果safari成为全球第二大浏览器。

9.傲游云浏览器这是业界首款打通多种浏览设备的浏览器,依托的是傲游强大的跨青苔云端服务,为用户提供了真正无缝的浏览体验,是无缝浏览在人们生活中成为了现实,傲游云推出的C4云引擎,还可以有效保障数据信息在所有平台上的上传、下载和同步。

10.2345浏览器2345王牌浏览器诞生于2010年12月,是上海二三四五网络科技有限公司主推的重要产品之一,最新一代浏览器主打极速和安全的特点,基于Chromium深度定制,引入了网页智能预加载技术,保证了用户在浏览网页时更加迅速。

QQ阅读如何关闭自动续费

QQ阅读如何关闭自动续费?QQ阅读是可以自动续费开通会员的,开通会员的用户不知道QQ阅读中的自动续费功能如何的关闭,接下来就是小编为用户带来的QQ阅读关闭自动续费方法图文教程,感兴趣的用户快来一起看看吧! QQ阅读如何关闭自动续费第一步:打开QQ阅读APP;第二步:主页面右下角【我】专区点击,选择【等级】;

第三步:进入到等级页面中,选择右下角的【会员享成长值加速】;

第四步:在最新页面中点击【管理自动续费】;

第五步:来到自动续费的页面中就可以轻松的关闭了。

猜你喜欢

![[快速恢复QQ聊天记录]](http://www.cvshuo.com/uploads/0diannao/w10/4.png)