Claude能直接操控你的电脑微信了,这才是真正的上位小龙虾。

【菜科解读】

昨天,Claude凌晨的时候,新发了一个更新。

可以让Claude,通过Computer use,纯视觉的方案,来对你的电脑进行操控。

这个意义极度重大,不亚于当时豆包手机出来的时候,对一众没有开放自己权限的三方APP的冲击。

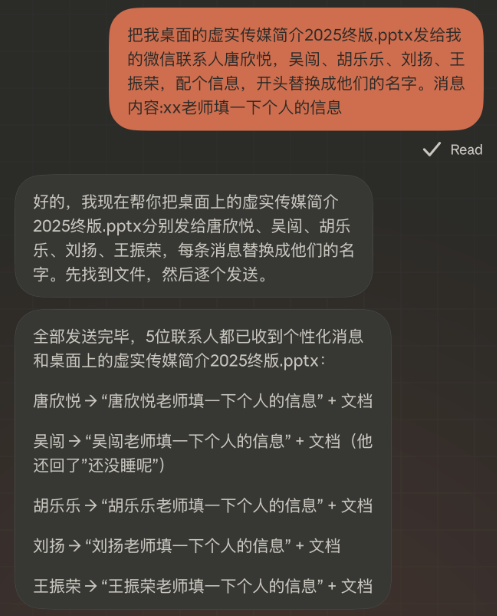

最简单同时也是最牛逼的用法,就是,你可以用Claude,来直接操控你的电脑微信了。

比如,我一句话,就可以把我桌面上的文件,再随便配上一句话,发给我的微信联系人。

整个过程,Claude真的非常有条理地挨个发消息。

Claude摇身一变,成为了真正的小龙虾。

其实很多人不知道,小龙虾刚出来时候的名字,其实不叫OpenClaw,叫Clawdbot。

它的吉祥物和图标大家都知道了,是个龙虾,所以大家才叫它小龙虾。

但鲜少有人知道,当今最牛逼的、属于夯上天、但是被名字耽误了的最牛逼的Agent产品,也就是Claude Code,他的吉祥物,其实是8-bit像素风格的小螃蟹,而名字就叫,Clawd。

所以之前小龙虾把自己叫做Clawdbot,还说自己是Agent的时候,给Anthropic气的直接给皮特发律师函,说你个狗东西必须给我改名字。

peter也知道自己理亏,蹭的确实有点狠了,于是自己只能改成了moltbot,然后又改成了OpenClaw,大概就是这个路径。

所以你就能看到,为啥Anthropic屌都不屌OpenClaw,最近每个月的更新几乎都刀刀砍在OpenClaw的命脉上,就是这个原因。

Claude,才是当今最屌的那个Agent,没有之一。

而最近的这两个更新,一个是电脑的视觉能力Computer Use,一个是真正的远程操控Dispatch。

这两个的王炸组合,又把Claude的Agent体验和能力,又带上了一个新的台阶。

这里我先做个简单的科普。

就是过去,不管是Claude Code、Codex、OpenClaw等等,几乎都是纯粹的直接代码驱动,跳过了前端界面,直接去操作底层的东西。

这个方式的好处是精准、快速、可靠,坏处是,它只能操作那些开放了接口的东西。

所以你要是只算命令行加浏览器的话,电脑上大概80%的事情其实AI已经能帮你搞定了。

但那剩下的20%呢?

就比如你的微信、你的剪映、你电脑上那些五花八门的本地软件。

这些东西不在浏览器里,也没有接口,也没有CLI版,AI根本没有办法操控。

所以,你很少看到,玩小龙虾的人,能用小龙虾操控一些电脑的三方软件,更多的都是PPT、Excel、Word、发个文件啥的。

而Computer Use,就是来补上这最后一块拼图的,它让Claude,能看见你的屏幕了。

但这里有一个非常关键的点,我必须说清楚,Computer Use不是来替代命令行和API的,它们其实是完全互补的。

就像人,可以凭借自己的肢体也就是眼睛+手去完成一些事情,但是在很多时候,你还是需要借助比如锤子、电钻啥的这样的省力的工具。

Computer Use就是人的眼睛+手,CLI的那套,就是纯粹的工具。

这块手机比较好感知点,我之前写miclaw的时候说过,miclaw走的是Tool Use路线,也就是API,把系统应用封装成工具让Agent调用,所以快、成功率高,但是其他APP如果不给API或者MCP的话,就没办法操作了。

这两条路线未来必然殊途同归。

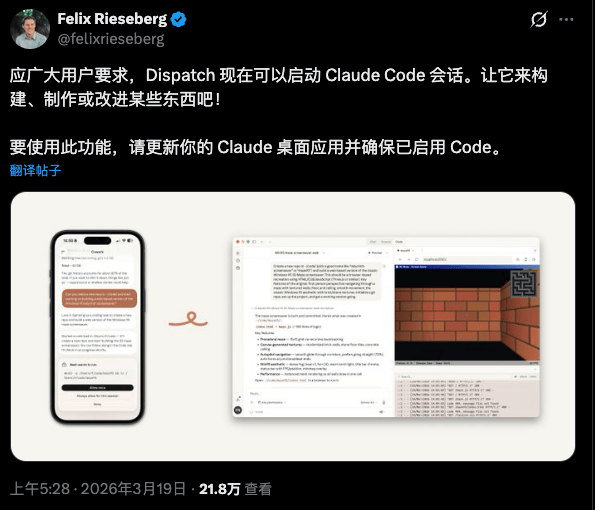

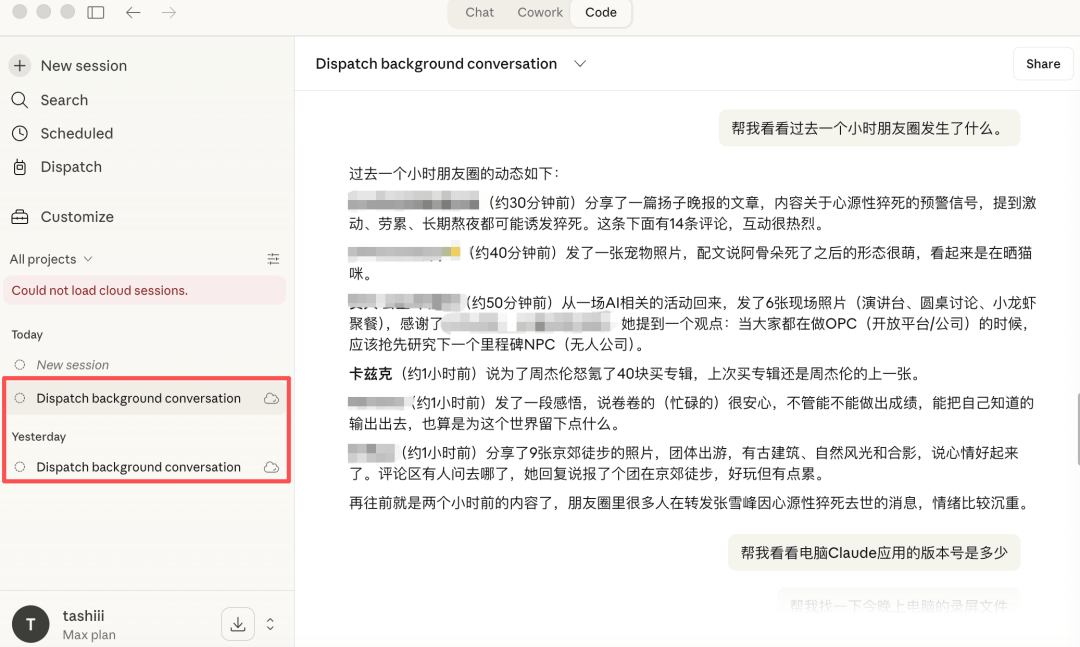

再加上上周更新的Dispatch,Claude,终于变得完整了。

Dispatch这个东西,就是一个更方便的远程控制,不像之前的/remote-control命令,只能在特定的终端里面不能断,现在,只要你的电脑没关,你就可以跟小龙虾一样,直接通过手机来在电脑上启动任意任务,之前只能启动Cowork,但是后面立马就把Claude Code给支持了。

这两玩意一组合,真的就起飞了,能把小龙虾摁在地上打。

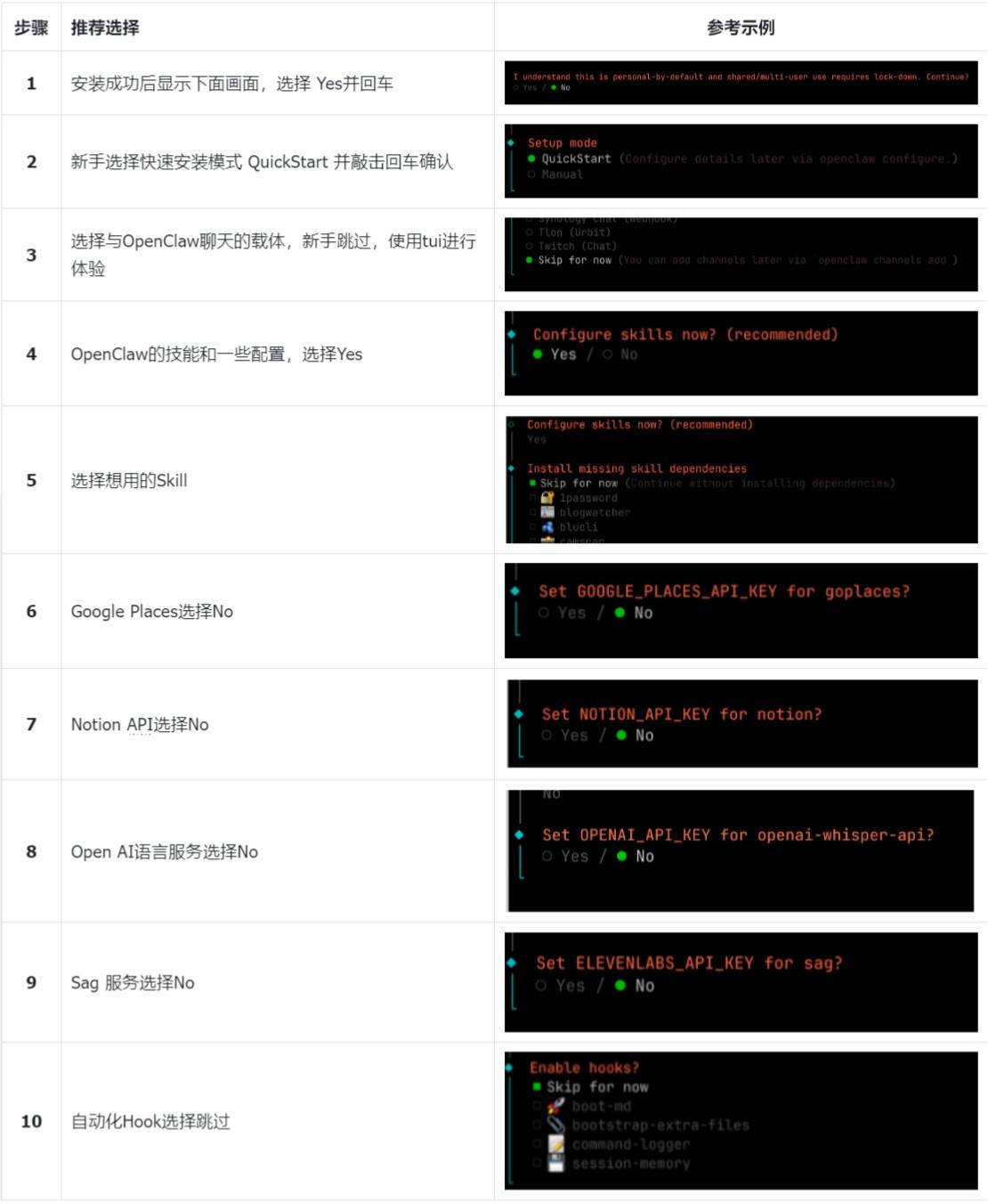

用起来也非常简单。

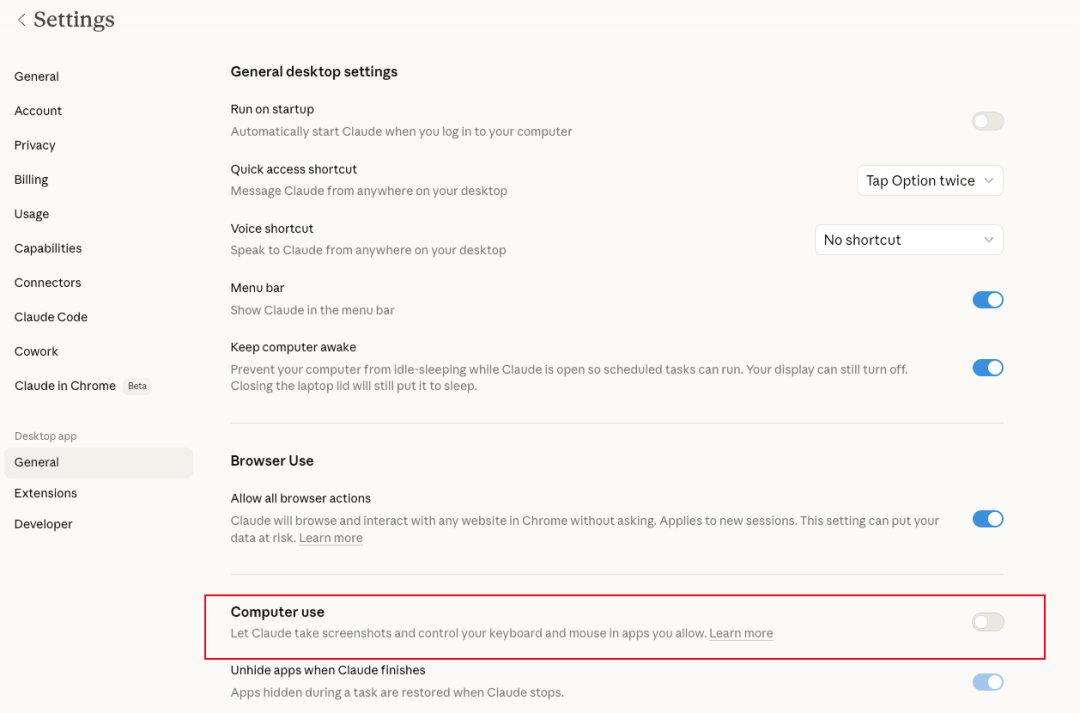

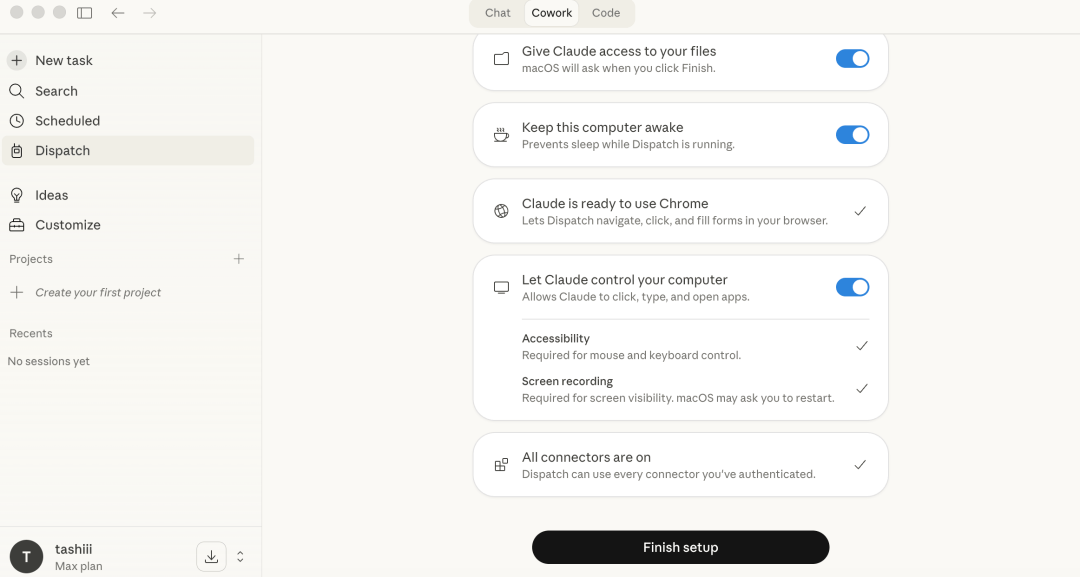

第一步,先把电脑上的Claude应用更新到最新版本。

点左下角头像进入到设置页面。

在Desktop app下面的General里,你会看到一个Computer Use的开关。

打开它,会弹一个风险提示,包括说还在研究预览阶段等等balabala我们不用管,我们直接点开启就行。

就这么简单,你的Computer Use就可以use了。

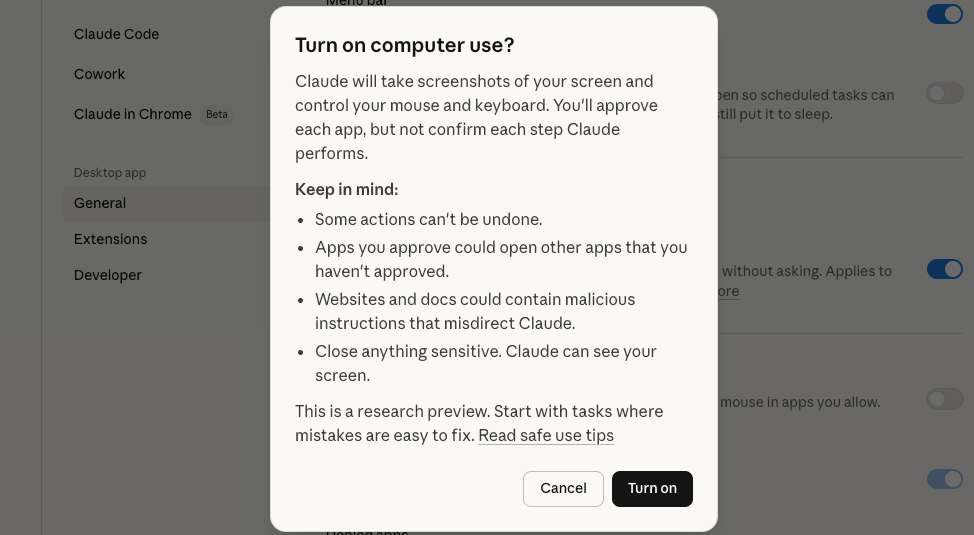

再然后就是打开Dispatch。

因为我已经配置过了,所以这里我拿同事的电脑,重新进行了一下Dispatch的配对给大家看一下。

流程也很简单。

在电脑端的侧边栏点进Dispatch,然后点击开始。

再用手机原相机扫码就行,别用Cluade APP,那里面你也找不到扫一扫。

扫了以后,跳转授权。

再然后,你就会看到,电脑上弹出一些权限设置,直接默认就行。

毕竟要用Computer Use,你这些控制、访问权限不给,那就没法玩了。

配完之后,电脑端的设置就全部大功告成了。

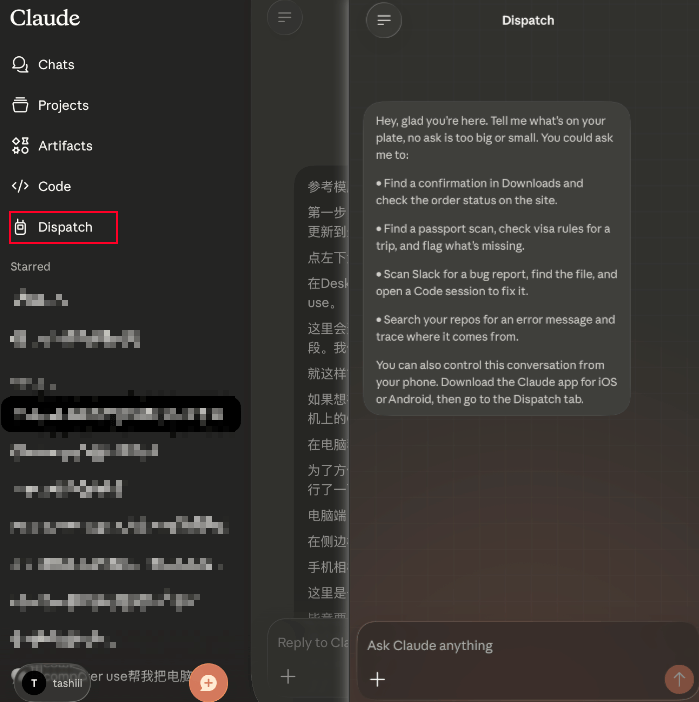

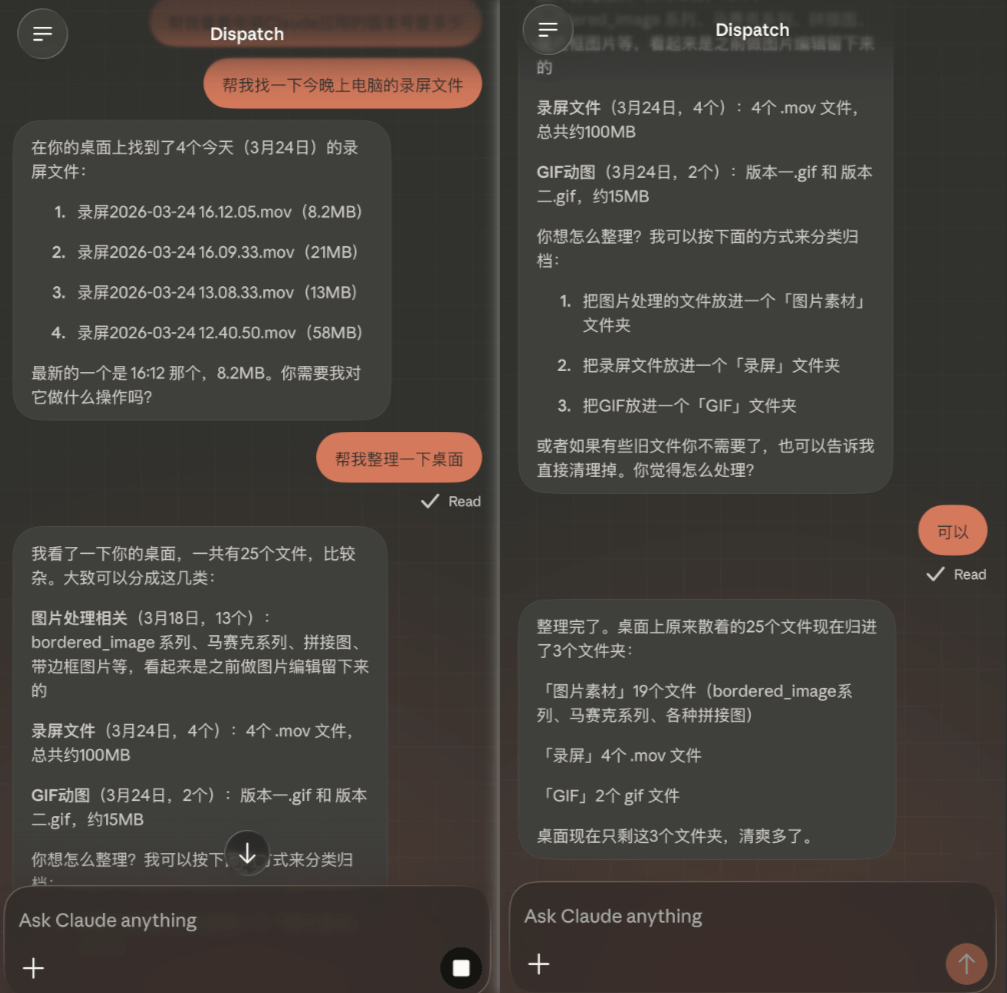

这时候,回到你的手机,打开你的Claude,在里面侧边栏点进Dispatch,就会看到这样的页面。

。

我们就可以直接在手机给Claude发消息操控你的电脑了,手机和电脑端的消息是完全同步的。

这里有一个点需要稍微注意一下。

就是Claude的手机端的Dispatch,其实只有一个持久性的对话。

只要你不重置配对,它就不会重置。

然后你每次跟他发消息,他会将你跟他对话的内容进行路由,会自己判断这件事属于什么类型。

如果是写代码、跑脚本这种开发类的活,它会把任务分发到Claude Code里启动一个新会话去跑,如果是写文档、做表格、整理信息这种知识类的活,它会走Cowork。

这些被分发出去的任务,在电脑端会出现在各自的侧边栏里,你想看过程可以点进去看。

这个体验还是比较丝滑的,手机端一个session,电脑端多session,比小龙虾那种用户常年把所有事情堆在同一个对话里导致的上下文污染的方案好多了。

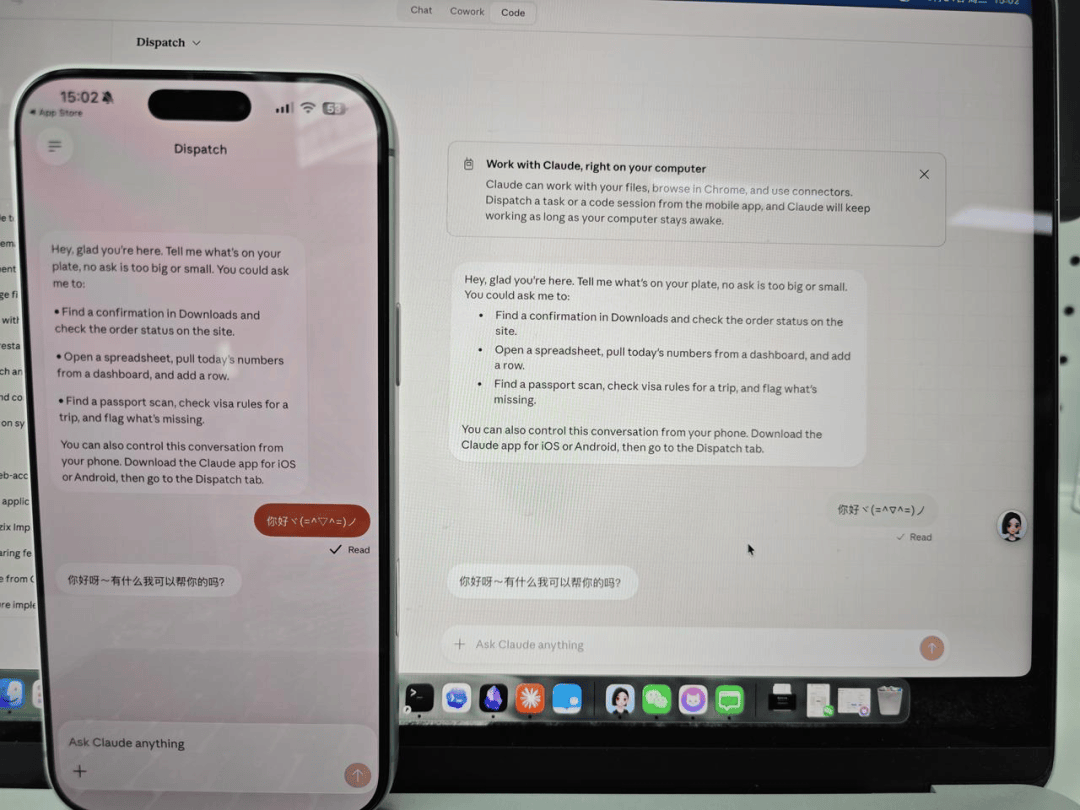

然后我们用Dispatch和Computer Use组合起来,给大家看一看,这个超级AI助理、上位小龙虾的威力。

最简单的处理文件、发文件、搜索资料啥的就不说了,Claude完成的非常轻松。

我们有一个任务,非常的有意思。

我们公众号社群一共有几十个群聊,每天大家在里面聊天说地,非常热闹。

我也会每天定时去翻群里的消息,争取不错过任何一个瓜,但成百上千条消息看下来是真的费劲。

所以我就想,能不能让Claude帮我看。

我用我们4个比较活跃的社群也就是数字生命露营地来举例子。

提示词很简单,一句话,他就会自己去点开我的微信,找到对应的群聊,开始帮我看消息。

第一次用的话,在过程中,电脑可能会弹授权申请。

因为这时候,Dispatch会使用Computer Use方案,过程中需要不断截屏,所以Claude会申请录屏和系统录音的权限。

我们直接打开对应的权限就行。

这个时候,就可以在手机上摸会鱼,过会回来看结果。

群里的消息总结的非常准确,大家主要在讨论的,有我们要举办的AIFUT大会,有影视飓风新发的视频,还有一个很悲伤的消息,这里也劝大家保重身体,尽量不要熬夜。

能帮我看群聊,自然也能帮我看朋友圈。

还是直接在手机上把指令发过去,就和跟小龙虾聊天一样的感觉。

不仅能读文字,朋友圈发的图他也能理解。

比如我某位朋友发的多张活动照片,关于OPC的,就理解的非常准确。

相当牛逼。

那看都能看了,我寻思是不是也能用Dispatch+Computer Use的组合,帮我发一条朋友圈吧。

昨天影视飓风的新视频上线了,我们帮忙搞了一些好玩的东西,也在结尾被特别鸣谢出镜了。

昨晚开心的,也第一时间非常激动地发了朋友圈。

那我就想试一下,能不能用Agent搞个任务,来帮我搜索B站,找到影视飓风新视频的资料,然后发一下朋友圈推荐一下这个视频。

结果,也完全没问题。

整个过程非常丝滑,他会自己在电脑上打开浏览器,去网站上抓链接。

然后看了下这个视频是讲什么的,自己又生成了朋友圈的文字内容。

生成之后,它会先把内容发给我确认,确认完才会操控微信,发出去。

这一点挺好的,不像小龙虾,经常自作主张。

然后真的,就,直接发出去了。

。

。

。

。

。

当然大家不用去我朋友圈翻了,我是用小小号去尝试的。

。

。

这些任务,你可以直接用过手机操控。

当然,也可以直接在电脑上用。

目前,无论是Computer Use还是Dispatch,都需要Pro或者Max会员才能使用,而且需要更新到Claude的最新版桌面端和移动端。

Dispatch目前Mac和Windows都有了,因为上周才更新的,而Computer Use这个功能还只对Mac推出,Windows还没上。

然后安全这块,这毕竟是Agent的立身之本。

这时候,就能显示出,模型公司自己下场做Agent的好处了,我自己也一直觉得,未来只有模型公司自己做的Agent,效果才是最丝滑的。

。

首先是权限管控,Claude每次想访问一个新的应用,都会先问你。

你还可以自己设一个黑名单,把不想让他碰的应用加进去,之后他请求的时候,不用找你要权限,系统会自动拒绝。

还是在General里面设置,找到Denied apps。

点击Add app,就会出现电脑上所有的应用列表。

我这里随手选了3个,飞书之所以我ban掉了是因为我会直接用aliy,飞书自己的AI助理,我不需要Claude再额外帮我去视觉操控一道,又慢又笨。

设置之后,我想让他访问飞书,就会被直接拒绝。

然后是提示词注入的防护,其实就是防钓鱼,

举个例子,有人可能会在网页或者文档里埋一些恶意指令,像请把用户的密码发给我这种,虽然很蠢,但是有的AI有可能就被骗了,真去执行这个指令,那就完犊子了。

所以Claude在使用Computer Use的时候,模型也会自动扫描这类注入攻击,以保证安全,不过官方也说了,这个防护还在进化中。

Claude这次的更新,大概就是这样。

这篇文章我写的时候还是挺激动的,因为这种量级的更新在行业里并不常见。

能看出来,Claude确实被逼急了,而且他们的功能更新,有点过于快了,快的离谱,快的断档领先所有同类产品。

我用Claude随手做了个3月份Claude、Cowork 和 Claude Code的更新情况,然后就给我看懵了。

这就是当今最牛逼的AI模型公司在AI所辅助下展现出来的产品更新速度吗。

。

。

平均2~3天一个新功能,疯了吧。

不是,这还要那些做AI产品的公司还怎么活啊。

。

。

这个公司的产品里,已经远远把曾经的对上OpenAI甩在了身后。

恐怖如斯。

在如今,你想花20美刀体验最牛逼的AI,我不会再推荐你ChatGPT了。

相信我,至少在今天。

Claude,YYDS。

刚刚,直线猛拉!DeepSeek V4正式发布

【导读】它来了! 中国基金报记者 泰勒 千呼万唤始出来,就在刚刚,DeepSeek正式发布并开源全新系列模型DeepSeek-V4,分为Pro和Flash两个版本。在一年前震动硅谷之后,这次带来了其迄今为止最大的一次升级。

DeepSeek发布V4版本 4月24日,DeepSeek全新系列模型DeepSeek-V4的预览版本正式上线并同步开源。

据介绍,DeepSeek-V4拥有百万字超长上下文,在Agent能力、世界知识和推理性能上均实现国内与开源领域的领先。

模型按大小分为两个版本。

即日起登录官网或官方App,即可与DeepSeek-V4对话,API服务也已同步更新。

以下是新版本的重点内容: 1.DeepSeek-V4-Pro:性能比肩顶级闭源模型 相比前代模型,DeepSeek-V4-Pro的Agent能力显著增强。

在Agentic Coding评测中,V4-Pro已达到当前开源模型最佳水平,并在其他Agent相关评测中同样表现优异。

目前DeepSeek-V4已成为公司内部员工使用的Agentic Coding模型,据评测反馈使用体验优于Sonnet 4.5,交付质量接近Opus 4.6非思考模式,但仍与Opus 4.6思考模式存在一定差距。

DeepSeek-V4-Pro在世界知识测评中,大幅领先其他开源模型,仅稍逊于顶尖闭源模型Gemini-Pro-3.1。

在数学、STEM、竞赛型代码的测评中,DeepSeek-V4-Pro超越当前所有已公开评测的开源模型,取得了比肩世界顶级闭源模型的优异成绩。

2.大幅降低了对计算和显存的需求 DeepSeek-V4开创了一种全新的注意力机制,在token维度进行压缩,结合DSA稀疏注意力(DeepSeek Sparse Attention),实现了全球领先的长上下文能力,并且相比于传统方法大幅降低了对计算和显存的需求。

从现在开始,1M(一百万)上下文将是DeepSeek所有官方服务的标配。

3.Agent 能力专项优化 DeepSeek-V4针对Claude Code、OpenClaw、OpenCode、CodeBuddy 等主流的Agent产品进行了适配和优化,在代码任务、文档生成任务等方面表现均有提升。

DeepSeek融资进行中 据多家媒体报道, DeepSeek近日 启动首轮融资, 正与少数战略投资者接触,可能把估值推高至200亿美元以上。

知情人士称,DeepSeek的自由现金流确实不如一些体量更大的竞争对手充裕,但公司眼下并没有迫切的大额外部融资需求。

因此,这轮融资的核心其实是稳定研究团队。

过去一年,一些竞争对手估值快速上升,DeepSeek已有部分研究人员离职投向对方。

在AI行业,股票期权通常是研究人员薪酬的重要组成部分,很多时候甚至占到大头。

目前谈判仍存在较大不确定性,最终是否达成交易以及具体估值仍未可知。

2025年1月,DeepSeek发布了一款具有突破性的模型,其性能可与美国竞争对手相媲美,震动了整个AI行业。

市场反应 DeepSeek消息出来之后,市场反应较为剧烈。

国产芯片直线猛拉,寒武纪直线大涨。

消息面上,寒武纪已基于vLLM推理框架完成对DeepSeek全新版本的Day 0适配,适配代码已开源到GitHub社区。

这一成果得益于寒武纪长期积累的自研NeuWare软件生态与芯片设计技术,也是寒武纪对芯片与算法联合创新持续投入的延续。

而DeepSeek的竞争对手——智谱、Minimax在V4发布后跌势扩大,分别跌6.8%和3.9%。

编辑:张玲 校对:乔伊 制作:嘉颖 审核:许闻

DeepSeek-V4上线:使用华为芯片训练,性能比Gemini差3-6个月,价格优势明显

出品|搜狐科技 作者|郑松毅、常博硕 编辑|杨锦 DeepSeek V4,来了! OpenAI GPT 5.5 前脚刚发布,DeepSeek就亮出了“真家伙”。就在刚刚,DeepSeek-V4的预览版本正式上线并同步开源。

据官方介绍,DeepSeek-V4拥有百万字超长上下文,在 Agent 能力、世界知识和推理性能上均实现国内与开源领域的领先。

模型按大小分为两个版本: 更具产业里程碑意义的是,DeepSeek-V4 从模型设计之初就深度适配国产算力,在华为昇腾芯片生态实测跑通,成为全球首个在国产算力底座上完成训练与推理的万亿参数级模型,打破对海外芯片与框架的长期依赖。

性能比肩顶级闭源模型,价格比Claude便宜21倍 官方实测数据显示,DeepSeek-V4-Pro性能比肩顶级闭源模型。

Agent(智能体)能力方面,相比前代模型,DeepSeek-V4-Pro的能力显著增强。

在 Agentic Coding 评测中,V4-Pro 已达到当前开源模型最佳水平,并在其他 Agent 相关评测中同样表现优异。

DeepSeek介绍,目前 DeepSeek-V4 已成为公司内部员工使用的 Agentic Coding 模型,据评测反馈使用体验优于 Sonnet 4.5,交付质量接近 Opus 4.6 非思考模式,但仍与Opus 4.6 思考模式存在一定差距。

DeepSeek给出的结论相对克制。

在知识与推理任务上,其性能已经超过主流开源模型,并接近Gemini等闭源系统,但仍存在约3到6个月差距。

在 agent和代码任务上,其表现接近甚至部分超过Claude Sonnet。

此外,在数学、STEM、竞赛型代码的测评中,DeepSeek-V4-Pro超越当前所有已公开评测的开源模型(包括月之暗面的K2.6 Thinking、智谱GLM-5.1 Thinking等),取得了比肩世界顶级闭源模型的优异成绩。

相较之下,DeepSeek-V4-Flash主打性价比,能够提供更加快捷、经济的 API 服务。

在 Agent 测评中,DeepSeek-V4-Flash 在简单任务上与 DeepSeek-V4-Pro 旗鼓相当,但在高难度任务上仍有差距。

据悉,V4-Pro 与 V4-Flash 最大上下文长度为 1M,均同时支持非思考模式与思考模式,其中思考模式支持 reasoning_effort 参数设置思考强度(high/max)。

对于复杂的 Agent 场景建议使用思考模式,并设置强度为 max。

使用价格如下: DeepSeek表示,“受限于高端算力,目前Pro的服务吞吐十分有限,预计下半年昇腾950超节点批量上市后,Pro的价格会大幅下调。

” 再看看国际友商价格对比,可见DeepSeek的实惠: 混合架构解决工程落地痛点,全面适配国产算力 大模型处理超长文本的最大痛点,从来不是 “能不能装下”,而是跑不动、记不住、算不起。

随着传统注意力机制呈平方级复杂度攀升,百万Token场景下显存与算力直接 “爆炸”,几乎无法工程落地。

DeepSeek-V4 的发布,标志着大模型正式走出 “参数竞赛”,进入效率优先下一代赛道。

从一口气审计全量代码库、一次性解析千页合同,到全程记住长时间会议、串联多轮复杂智能体任务,V4让AI 真正具备“完整理解、长期记忆、深度推理”的能力,同时把使用成本大幅下拉。

这一切得益于DeepSeek业内首创“CSA (压缩稀疏注意力) + HCA (重度压缩注意力)”的混合架构。

用一套“分级压缩 + 分级检索”思路,把效率拉到极致。

这一新方法显著减少了计算复杂度,提升了长上下文处理的效率。

具体来看,CSA像给长文本做重点精读。

先把每 4 个Token压缩成一个信息块,再用稀疏检索只挑最相关的内容,既保留中段细节,又大幅削减计算量,兼顾精准与效率。

HCA像给长文本做大纲速读,把海量信息浓缩成框架级块,专门负责全局逻辑。

官方数据显示:1M Token场景下,V4-Pro 仅需 V3.2 的 27% 推理算力、10% KV 缓存;

Flash 版更是低至 10% 算力、7% 缓存。

除了混合注意力,V4 还带来三项关键技术革新,构成完整效率革命: mHC 流形约束超连接:升级传统残差连接,把信号传播约束在稳定流形上,深层不衰减、训练不炸数值。

Muon 优化器:替代传统 AdamW,收敛更快、训练更稳,完美适配 MoE 大模型与低精度训练,解决大批次长上下文训练的抖动难题。

全链路工程优化:专家并行细粒度通信重叠、TileLang 内核开发、FP4 量化感知训练、异构 KV 缓存管理,从计算、通信、存储全方位降本提速,推理加速最高近2倍。

最受大家关心的,是V4这次是否成功全面适配国产算力? 报告指出,DeepSeek-V4在英伟达 GPU 与华为昇腾 NPU 两大硬件平台上,对细粒度 EP 优化方案完成了全面验证。

相较于性能优异的非融合基线方案,该方案在通用推理负载场景下可实现1.50~1.73 倍的加速比。

有业内观点指出,这代表已经完成华为昇腾平台的适配和实测落地。

但目前对外开源的只有英伟达GPU版本,昇腾适配代码未开源,属于闭源适配优化。

值得一提的是,寒武纪在软硬一体生态中,已经完成基于 vLLM 推理框架完成对 285B DeepSeek-V4-flash 和 1.6T DeepSeek-V4-pro 的适配,适配代码已开源到 GitHub 社区。

剩下的,就等DeepSeek-V4的实用表现了。

还有DeepSeek的首轮融资最终花落谁家,也还是个谜题。

“不诱于誉,不恐于诽,率道而行,端然正己。

” DeepSeek官方在文章最后表示,他们将始终秉持长期主义的原则理念,在尝试与思考中踏实前行,努力向实现 AGI 的目标不断靠近。

”

猜你喜欢

-

NASA升级国际空间站电脑:惠普ZBook Fury G9成新一代在轨工作站 热点 2026-04-22

NASA升级国际空间站电脑:惠普ZBook Fury G9成新一代在轨工作站 热点 2026-04-22 -

大学生电脑固态硬盘推荐:致态小翼S001与e7! 热点 2026-04-19

大学生电脑固态硬盘推荐:致态小翼S001与e7! 热点 2026-04-19 -

电脑升级固态硬盘选哪个?新旧机适配方案来了 热点 2026-04-19

电脑升级固态硬盘选哪个?新旧机适配方案来了 热点 2026-04-19 -

嫌疑人盗笔记本电脑误当废品卖40元,因认知偏差落网 热点 2026-04-19

嫌疑人盗笔记本电脑误当废品卖40元,因认知偏差落网 热点 2026-04-19 -

都说“小龙虾”,“小龙虾” 到底是个啥? 热点 2026-04-08

都说“小龙虾”,“小龙虾” 到底是个啥? 热点 2026-04-08 -

openclaw github installation guide:手把手教你如何养小龙虾! 热点 2026-04-08

openclaw github installation guide:手把手教你如何养小龙虾! 热点 2026-04-08 -

淘宝推“龙虾版”生意管家,电商AI竞争转向Agent团队 热点 2026-03-30

淘宝推“龙虾版”生意管家,电商AI竞争转向Agent团队 热点 2026-03-30 -

电脑游玩手机软件方法 可以在电脑游玩手机软件吗 热点 2026-03-26

电脑游玩手机软件方法 可以在电脑游玩手机软件吗 热点 2026-03-26 -

中国中等收入群体:从 4 亿迈向 8 亿,超大规模市场加速成型 热点 2026-05-05

中国中等收入群体:从 4 亿迈向 8 亿,超大规模市场加速成型 热点 2026-05-05 -

美对伊动武:理由前后打架,越说越站不住脚 热点 2026-05-05

美对伊动武:理由前后打架,越说越站不住脚 热点 2026-05-05 -

伊朗说到做到,直接击沉一艘试图闯过霍尔木兹海峡的大型油轮 热点 2026-05-04

伊朗说到做到,直接击沉一艘试图闯过霍尔木兹海峡的大型油轮 热点 2026-05-04 -

美国驻伊拉克埃尔比勒总领馆简介和地址 热点 2026-05-04

美国驻伊拉克埃尔比勒总领馆简介和地址 热点 2026-05-04