制作U盘启动盘:简易方法与专业技巧分享

【菜科解读】

简介:

制作U盘启动盘是现代电脑用户和科技爱好者必备的一项技能。

无论是为了安装操作系统、修复系统故障,还是执行一些高级操作,一个U盘启动盘都能大显身手。

本文将详细介绍如何制作U盘启动盘,包括所需的工具和原料、详细步骤以及一些专业技巧,帮助你轻松掌握这项技能。

工具原料:

系统版本:

Windows 10、Windows 11、macOS Ventura

品牌型号:

电脑:Dell XPS 13 (2022), MacBook Pro (2023)

U盘:SanDisk Extreme Pro 64GB, Samsung BAR Plus 128GB

软件版本:

Rufus 3.18, balenaEtcher 1.10.1, macOS内建磁盘工具

一、准备工作

1、选择合适的U盘。

建议选择容量不低于8GB的U盘,例如SanDisk Extreme Pro 64GB和Samsung BAR Plus 128GB,这些U盘的读取和写入速度较快,能够缩短制作时间。

2、下载操作系统镜像文件。

无论你是想制作Windows、Linux还是macOS的启动盘,都需要提前下载相应的操作系统镜像文件(ISO)。

确保下载的文件是官方版本,以免出现兼容性问题。

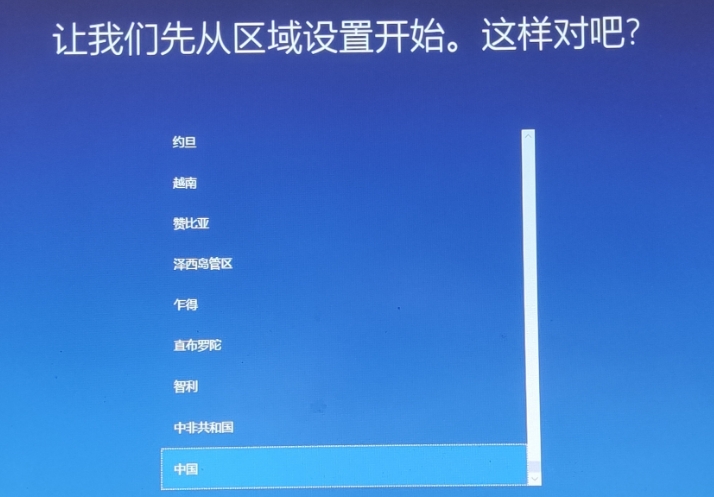

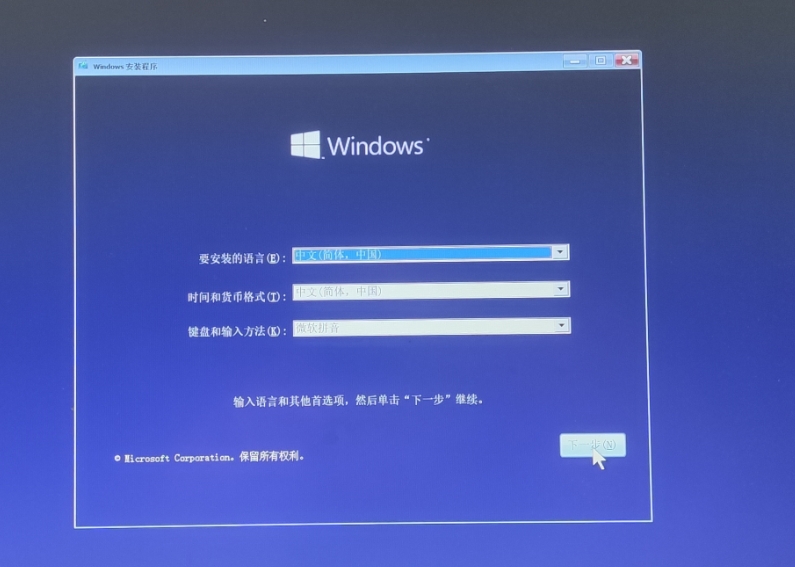

二、使用Rufus制作Windows启动盘

1、下载并安装Rufus。

Rufus是一个轻量级、易用的启动盘制作工具,适用于Windows平台。

访问[Rufus官网](https://rufus.ie/)下载最新版本的Rufus。

2、插入U盘并运行Rufus。

打开Rufus后,它会自动识别插入的U盘。

选择刚才下载的操作系统镜像文件,通常是ISO格式。

3、设置参数。

在Rufus主界面中,选择“分区类型”为“MBR”或“GPT” (根据目标电脑的硬件配置),“文件系统”选择“NTFS”或“FAT32”,其他选项保持默认即可。

4、点击“开始”按钮。

Rufus会提示你确认操作,点击“确定”后,等待几分钟,直到进度条完成,U盘启动盘制作完成。

三、使用balenaEtcher制作多平台启动盘

1、下载并安装balenaEtcher。

balenaEtcher是一款跨平台的启动盘制作工具,支持Windows、macOS和Linux。

访问[balenaEtcher官网](https://www.balena.io/etcher/)下载并安装最新版本的Etcher。

2、插入U盘并运行balenaEtcher。

启动balenaEtcher后,点击“Flash from file”选择操作系统镜像文件,然后点击“Select target”选择插入的U盘。

3、点击“Flash”按钮。

确认选项无误后,点击“Flash”按钮,Etcher会自动开始制作启动盘。

整个过程大约需要几分钟时间。

四、使用macOS内建磁盘工具制作macOS启动盘

1、下载macOS安装程序。

通过App Store下载最新版本的macOS安装程序,例如macOS Ventura。

2、插入U盘并打开“终端”。

确保U盘已插入并格式化为Mac OS扩展格式。

打开“终端”应用程序,输入以下命令:

`sudo /Applications/Install macOS Ventura.app/Contents/Resources/createinstallmedia --volume /Volumes/MyVolume`

3、执行命令并等待。

根据提示输入管理员密码,按下回车键,等待创建过程完成。

内容延伸:

1、验证启动盘的有效性。

制作完成后,建议在目标电脑上尝试启动,确保启动盘制作成功。

如果出现问题,可以检查U盘的文件系统格式,重新下载操作系统镜像文件,或者更换U盘。

2、备份U盘数据。

制作启动盘会清空U盘上的所有数据,建议在操作前备份U盘中的重要文件。

3、了解启动盘的更多用途。

除了安装操作系统,启动盘还可以用来运行诊断工具、备份和恢复系统、执行数据恢复等高级任务。

总结:

制作U盘启动盘是一项实用且必要的技能,尤其在现代科技生活中。

通过本文介绍的方法和工具,科技爱好者和电脑手机小白用户都可以轻松制作出自己的启动盘。

不仅如此,掌握这些技巧还可以帮助你在各种系统维护和故障修复中游刃有余。

希望这篇文章对你有所帮助,祝你在科技之路上不断进步!

[u盘制作启动盘工具]

简介:在现代科技发展的背景下,越来越多的人开始使用U盘制作启动盘工具。本文将介绍U盘制作启动盘工具的相关内容,包括工具原料、使用方法以及其作用和意义。

工具原料:要制作U盘启动盘,我们需要准备以下工具原料:1. 一台电脑:用于操作和制作U盘启动盘。

2. 一个U盘:作为启动盘的载体,需要具备足够的存储空间。

3. 启动盘制作软件:如Rufus、WinToUSB等,用于将操作系统镜像文件写入U盘。

正文:一、展示2023最新的天梯图排行榜天梯图排行榜是一种评估电脑硬件性能的工具,它可以根据不同的硬件配置和性能指标,对电脑进行排名。

通过制作U盘启动盘,我们可以方便地查看最新的天梯图排行榜,了解各种硬件配置的性能表现。

二、介绍或推荐排名前几的产品根据最新的天梯图排行榜,我们可以了解到排名前几的产品。

例如,目前排名第一的显卡是XXX,它具备强大的图形处理能力和稳定的性能表现。

而排名第一的处理器是XXX,它拥有高频率和多核心的优势。

三、介绍U盘制作启动盘的意义或作用制作U盘启动盘的意义在于方便快捷地安装或修复操作系统。

当我们的电脑出现问题或需要重新安装操作系统时,只需插入U盘启动盘,即可进行系统的安装或修复,避免了繁琐的光盘安装过程。

四、自由拓展内容除了安装和修复操作系统,U盘启动盘还可以用于数据备份和恢复。

我们可以将重要的文件和数据存储在U盘中,以备不时之需。

同时,U盘启动盘还可以用于系统的克隆和迁移,方便我们在不同的电脑上使用相同的系统配置。

总结:通过制作U盘启动盘工具,我们可以方便地查看最新的天梯图排行榜,了解各种硬件配置的性能表现。

同时,U盘启动盘还可以用于操作系统的安装、修复、数据备份和系统迁移等多种用途。

在现代科技发展的背景下,U盘制作启动盘工具已经成为越来越多人必备的工具之一。

六月限定浪漫!傍晚西北天空,金星木星准时相拥

六月黄昏藏着年度绝美天象,金星合木星如约上演。不用望远镜、不用去郊外,晴天傍晚抬头就能看见。

两颗全天最亮的星星慢慢靠拢,中下旬还有弯月凑局,随手就能拍出朋友圈爆款星空图。

暮色天边,两颗巨星跨越星海奔赴约会日落过后,天边晚霞慢慢褪去色彩。

西北低空率先冒出两颗格外耀眼的光点。

莹白刺眼的是金星,淡黄温润的便是木星。

一个是夜空中最亮行星,一个是太阳系气态巨行星。

从六月初开始,两颗星星每天都在慢慢靠近。

肉眼能清晰看见它们一点点缩短彼此的距离。

6 月 9 日到达最佳观赏时刻,间距仅 1.64。

大概三颗满月并排,一根小拇指就能横向盖住双星。

饭后散步偶然抬头撞见,很容易被这份宇宙温柔惊艳。

肉眼贴在一起,实际相隔亿万公里很多人看到双星紧挨,误以为星球快要相撞。

其实金木相拥,只是地球视角造就的视觉奇遇。

两颗星体在宇宙之中相隔数亿公里的虚空。

各自循着公转轨道运转,恰巧运行到黄道同一方位。

行星相合年年都有,但大多被太阳光遮蔽看不见。

今年六月是全年观测条件最好的一次金木相合。

古人对着双星遐想编织神话,今人抬头读懂天体规律。

零成本观赏,手机随手拍出氛围感大片观赏黄金时间:日落之后 30~60 分钟。

天色半蓝半暗,星体亮度拉满,还不会快速落山。

尽量挑选西边无高楼大树遮挡的开阔位置。

江边、楼顶、空旷公园,都是绝佳打卡点位。

城市光污染也能裸眼看清两颗亮星。

手机架上三脚架,蓝调黄昏直接拍出星空大片。

有小型双筒望远镜,还能看见月牙金星与木卫。

天象接连加码,三星列队 + 双星抱月轮番上线9 日双星亲密碰面后,精彩天象还在持续。

没过几天,低空水星悄然现身,形成三星并排。

小小的水星紧贴地平线,需要静下心仔细寻找。

6 月 17 日迎来整月颜值巅峰:双星抱月。

一弯细细蛾眉月卡在金木两颗亮星中间。

暮色、弯月、两大行星同框,画面治愈又梦幻。

整轮天象横跨十几天,晴天随时都能出门观赏。

放下琐碎,抬头接住宇宙送来的小浪漫平日里忙于工作琐事,很少留意头顶的夜空。

大自然总在悄悄准备免费的浪漫天象。

全国全境都能观测,没有地域限制。

不必远行,家门口就能邂逅亿万年一次的相逢。

闲暇傍晚走出家门,望向西北方的天际。

在漫天暮色里,赴一场跨越星海的行星之约。

猜你喜欢