怎么把deepseek放到word里

【菜科解读】

今天给各位分享如何把deepseek放到word里_excel如何接入deepseek,其中也会对大家所疑惑的内容进行解释,如果能解决您现在面临的问题,别忘了关注多特软件站哦,现在开始吧!

如何把deepseek放到word里

要在Word中使用DeepSeek,可以通过安装官方插件来实现。

以下是详细的步骤:

首先,确保你的Word版本与DeepSeek插件兼容。

如果兼容,你可以按照以下步骤进行操作:

1. 打开Word软件,找到并点击“插件”或“应用商店”选项。

2. 在搜索栏中输入“DeepSeek”,找到官方插件后点击安装。

3. 安装完成后,可能需要进行账号绑定。

完成绑定后,重启Word以确保插件生效。

启用DeepSeek插件后,你将在Word的菜单栏中看到一个新的“DeepSeek”选项卡。

通过这个选项卡,你可以访问DeepSeek提供的各项功能,从而在文档中更高效地工作。

需要注意的是,具体的安装和使用步骤可能会因Word版本和DeepSeek插件版本的不同而有所差异。

因此,在实际操作中,建议参考DeepSeek官方提供的最新安装和使用指南,以确保顺利安装和使用。

如果你的Word版本不支持DeepSeek插件,或者遇到无法直接安装的问题,可以考虑其他解决方案。

例如,你可以通过在线服务使用DeepSeek,或者将文档导出为其他格式后再进行处理。

总之,通过上述方法,你可以轻松地在Word中集成和使用DeepSeek,提升文档处理的效率和效果。

excel如何接入deepseek

要在Excel中接入DeepSeek,首先需要在DeepSeek平台上注册并获取API密钥。

一旦你获得了API密钥,便可以通过多种方式将DeepSeek的数据连接到Excel中。

例如,你可以使用Excel的“数据”菜单中的“从Web获取数据”功能,输入DeepSeek API的URL,并将你的API密钥作为参数传递。

这样,你可以选择需要查询的字段,并将数据导入到Excel工作表中。

如果你熟悉VBA编程,还可以编写自定义脚本来自动化这个过程。

通过VBA,你可以更灵活地控制数据的获取、处理和展示方式。

这不仅提高了工作效率,还使得数据操作更加精准和便捷。

值得注意的是,具体的接入步骤可能会随着DeepSeek平台的更新而有所变化。

因此,建议查阅DeepSeek的官方文档或联系他们的技术支持以获取最准确的信息。

总的来说,虽然Excel接入DeepSeek需要一定的技术背景,但如果你熟悉Excel和API的使用,这将是一个非常强大的工具组合,能帮助你更高效地处理和分析数据。

无论你是选择使用内置的数据获取功能还是编写自定义的VBA脚本,都能显著提升数据管理的效率和灵活性。

以上内容就是小编为大家整理的如何把deepseek放到word里_excel如何接入deepseek全部内容了,希望能够帮助到各位小伙伴了解情况!

更多全新内容敬请关注多特软件站(www.duote.com)!

人工智能赋能卫生健康高质量发展 AI技术把体检报告变成“健康说明书”

封面新闻记者 张越熙 在深度学习技术突破与大数据浪潮的双重驱动下,人工智能正以前所未有的速度融入医疗健康领域。清华大学宣布成立人工智能医院,医院建设将分阶段进行;

北京协和医院部署基于深度学习的人工智能诊断系统……"AI+医疗"应用遍地开花,价值日益凸显:从提升诊疗效率到赋能日常健康管理,人工智能正在重塑医疗服务模式,为健康中国建设注入强劲动力。

春季是传统的体检季,可很多人拿到体检报告却犯了难。

一项5000名网友参与的调研显示,80%的受访者表示体检报告没有得到详细讲解,也不知道检后该怎么做;

75%的受访者没有按体检报告的建议进行复查。

5月6日,AI健康应用蚂蚁阿福启动“健康中国体检关怀行动”。

用户打开阿福App拍照或上传体检报告,即可获得实时、免费、专业的解读。

记者体验发现,打开App首页,点击+号或者“报告解读”按钮,对着体检报告拍照或者上传PDF文件,就能获取报告解读,该AI解读体检报告会以“红绿灯”形式清晰告知检查结果关注优先级,并给到针对性的健康行动清单。

解读完成后,用户可自主选择是否将体检报告存入阿福的健康档案,方便随时查看和管理,未来也能让AI提供更精准、个性化的健康问答服务。

对普通人来说,这相当于身边多了一位私人健康顾问。

随着“健康中国”战略深入推进,预防性健康管理成为大众关切的重点,体检更是提升全民健康水平的重要抓手。

AI解读体检报告,降低了报告解读门槛,有助于让体检真正成为用户健康管理的起点。

相关产品负责人表示,AI正在成为用户获取健康服务的重要入口。

阿福的体检报告解读功能最适合三类人群使用:忙碌的打工族、照顾全家的家庭顶梁柱以及高度关注健康的老年人。

通过AI解读体检报告,可以帮用户更早识别健康风险,主动管好自己和家人的健康。

北京佑安医院感染综合科主任医师李侗曾表示:“很多人不知道,其实看懂体检报告和体检本身同样重要。

AI技术帮1亿人把体检报告变成‘健康说明书’,非常实用,它让普通人也能了解自己的身体状况,使体检真正成为管理健康的起点。

这正是科技该有的温度,也将有效助力‘健康中国’战略加速推进。

”

到澳门摸一把,蚂蚁银行报销路费

蚂蚁银行(澳门)是阿里巴巴集团投资设立的澳门数字银行,也是澳门首批数字银行之一(类似于内地互联网银行,如腾讯旗下的微众银行),由澳门金融管理局监管,享80万澳门元存款保障。人到澳门后只需要一部手机,10分钟就能完成线上开户,方便快捷! 一、开户前需要做哪些准备? 18岁以上内地居民 港澳通行证剩余有效期大于6个月 中国内地居民身份证剩余有效期大于30天 内地银行卡,且预留的手机号与蚂蚁银行开户手机号一致 手机号要开通国际漫游,需要在澳门接收短信验证码 二、开户活动:5月1日~5月31日 1、开户即送财富兑换卡一张(约90港币,可兑换3股小米) 2、转入资金达3000港币并留存10个工作日,平台送2张财富兑换卡(价值约270港币,可兑换2港股阿里巴巴)。

股票卡领取说明:在蚂蚁银行APP证券页面- 「个人中心」-「我的卡券」-点击「兑换」,等待股票发放到持仓。

限时特别福利!活动时间:5月1日~5月10日 活动内容:凡是活动期间购买交通票目的地为澳门/珠海,单张票据大于等于300港币,交通票到达7日内成功开通蚂蚁银行(澳门)账户,凭「交通票凭证+证券账户号」提交到指定邮箱审核,即可领取交通补贴“150港币股票现金卡(3张50)”。

三、入境澳门半小时后,下载【出入境记录文件】 微信搜索小程序「移民局12367」 进入小程序后,主页点击“中国公民服务”,然后点击“出入境记录查询” 再次点击“出入境记录查询”,选择“三个月”,点击下一步 出现记录后,点击记录下载,存到手机上即可 注:出入境记录更新可能有延迟,如果看不到,过10分钟刷新即可。

四、开户流程 ①一定要用郭二侠渠道专属链接注册开户,才有新户奖励!!! 复制到微信或浏览器打开,点击「立即开户」收到验证码后点击登录,然后下载「螞蟻銀行(澳門)」APP。

默认邀请码:LPSANHKW ②需要人在澳门,连接澳门的WiFi(关口、商场、星巴克、酒店、银行网点等场景都可以免费连接) 在澳门蚂蚁银行APP按流程一步一步操作并提交开户。

③开户资料审核成功,上传《出入境记录》文件(90天内提交,回内地也可以上传),开户成功会收到短信提醒 澳门蚂蚁银行支持澳门元、港元和美元币种,资金进入户根据币种汇入相应活期账户。

④澳门蚂蚁银行账户开通成功后,再授权开通证券账户 澳门蚂蚁银行,港股交易佣金万2,每单最低收费30港币;

美股交易佣金每股0.0088美元,每单最低收费2.88美元。

五、免费领取澳门通

猜你喜欢

-

DeepSeek加入多模态功能,小鲸鱼终于能看到东西了 热点 2026-04-30

DeepSeek加入多模态功能,小鲸鱼终于能看到东西了 热点 2026-04-30 -

男子随地小便被制止,腾空飞踹管理员时把自己摔骨折,反索赔18万!法院判了 热点 2026-04-27

男子随地小便被制止,腾空飞踹管理员时把自己摔骨折,反索赔18万!法院判了 热点 2026-04-27 -

枪手如何绕开白宫记协晚宴层层安保?真相来了 热点 2026-04-27

枪手如何绕开白宫记协晚宴层层安保?真相来了 热点 2026-04-27 -

趁着美国被拖入中东泥潭,深夜,俄军突然出手,把乌克兰炸成火海 热点 2026-04-24

趁着美国被拖入中东泥潭,深夜,俄军突然出手,把乌克兰炸成火海 热点 2026-04-24 -

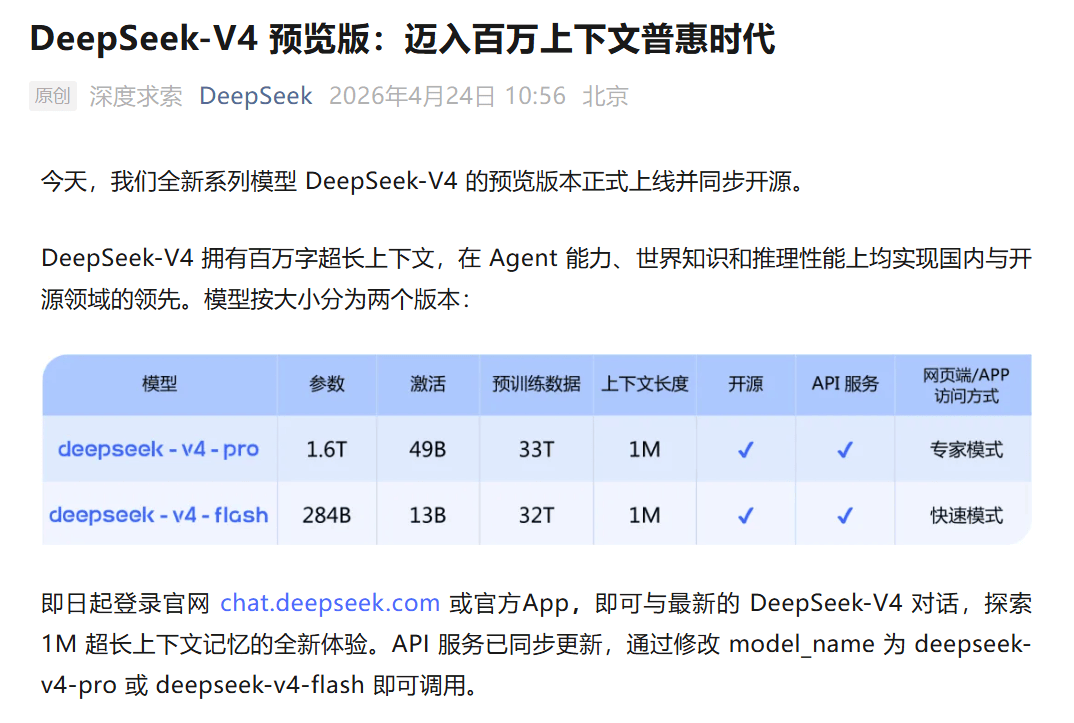

刚刚,直线猛拉!DeepSeek V4正式发布 热点 2026-04-24

刚刚,直线猛拉!DeepSeek V4正式发布 热点 2026-04-24 -

1967年属羊人2026年运势及运程 1967年属羊人在2026年的运势如何 风水 2026-04-24

1967年属羊人2026年运势及运程 1967年属羊人在2026年的运势如何 风水 2026-04-24 -

2026年属蛇男2026年财运怎么 2026年属蛇财运如何? 风水 2026-04-24

2026年属蛇男2026年财运怎么 2026年属蛇财运如何? 风水 2026-04-24 -

DeepSeek-V4上线:使用华为芯片训练,性能比Gemini差3-6个月,价格优势明显 热点 2026-04-24

DeepSeek-V4上线:使用华为芯片训练,性能比Gemini差3-6个月,价格优势明显 热点 2026-04-24 -

杜蕾斯air和超薄套区别杜蕾斯air空气套和超薄套哪个好 AI 2026-04-25

杜蕾斯air和超薄套区别杜蕾斯air空气套和超薄套哪个好 AI 2026-04-25 -

Deepswap在线?AI?换脸,轻松生成换脸视频、照片! AI 2026-04-11

Deepswap在线?AI?换脸,轻松生成换脸视频、照片! AI 2026-04-11 -

怎么使用deepseek写材料 AI 2026-04-11

怎么使用deepseek写材料 AI 2026-04-11 -

玩转Deepseek必备的100个话术指令 AI 2026-04-11

玩转Deepseek必备的100个话术指令 AI 2026-04-11