1987秦岭千人村落凭空不见,谁能揭开这惊天谜团?

这一事件引发了广泛猜测,从外星人绑架到军事秘密行动,各种说法甚嚣尘上。

尽管

【菜科解读】

1987年,陕西秦岭脚下的晶山村在一夜之间离奇消失,村民与牲畜踪迹全无,仅留空荡建筑。

这一事件引发了广泛猜测,从外星人绑架到军事秘密行动,各种说法甚嚣尘上。

尽管官方始终未公布调查结果,但民间流传的多个版本与历史记载、文献资料交织,为这起神秘事件蒙上了一层神秘的面纱。

事件前因:平静村庄的异常开端

晶山村位于秦岭脚下,村民们祖祖辈辈在此过着日出而作、日落而息的平静生活。

然而,1987年10月12日凌晨4点左右,这份平静被彻底打破。

据当时目击者称,一道道刺眼的紫光惊醒了熟睡中的村民,他们往窗外望去,只见天空中赫然漂浮着许多不明飞行物,这些飞行物闪烁着神秘的紫光,仿佛无数个火球在空中飞舞。

村民们被这突如其来的景象吓得不敢出门,只能躲在家中。

事件经过:一夜之间全村消失

天亮后,看到不明飞行物的附近村民担心晶山村的情况,便前往查看。

越往晶山村深处走,他们越是心惊。

往日热闹的村庄,当天却静得出奇,不要说人声,就连犬吠声都听不到。

当几个胆大的村民壮着胆子向村里探去后,发现村里连人带牲畜,竟然在一夜之间消失得无影无踪。

整个村庄仿佛被一只无形的大手瞬间抹去,只留下孤零零的建筑物矗立在原地。

官方态度:避而不谈引发猜测

事件发生后,官方对此事避而不谈,既没有发布任何相关通告,也没有对外界的询问做出回应。

这种反常的处理方式更加剧了人们的猜疑,各种猜测和谣言开始在民间流传开来。

有人声称晶山村可能得罪了神仙,导致神仙施法直接摧毁了整个村庄作为惩罚;

也有人认为晶山村可能遭遇了外星人的攻击或绑架,而为了掩盖真相,上级部门故意隐瞒了事实。

民间猜测:多种版本各执一词

外星人绑架说

这一说法在民间流传最广,也最具神秘色彩。

支持者认为,周边不少村民都在凌晨看到不明飞行物在晶山村聚集,在它们离开后,晶山村1000多口人和牲畜失踪,很难不将二者联系到一起。

他们猜测,这些不明飞行物是外星人的飞船,外星人为了进行某种实验或研究,将晶山村的村民和牲畜全部掳走。

军事秘密行动说

一些老人表示,早在晶山村村民失踪之前,军方就曾宣布过要在当地进行军事演习。

因此,有人猜测晶山村的消失与这场军事演习有关。

他们认为,军方为了村民们的安全考虑,将晶山村举村迁移到了别的地方。

由于这次军事行动的代号是“夜狸猫行动”,所以晶山村神秘失踪事件又被称为“夜狸猫事件”。

特务渗透说

当时我国正处于经济和军事发展的高速时期,国外有人忌惮我国的发展,派遣了很多间谍渗透到我国。

秦岭深处藏着我国一处秘密军事基地,有人猜测晶山村可能牵扯到了特务事件。

敌对势力为了获取军事基地的情报,渗透进了晶山村,威胁到了军事基地的安全,于是军方将这个村子的人员全部迁走。

自然灾害说

还有人认为晶山村的消失是因为自然灾害造成的。

秦岭一方面处于地震的活跃地带,而且周边的天气时常不太稳定,经常会发生雷电或龙卷风。

然而,这一说法很难令人信服,因为如果发生自然灾害,不可能只有活物消失,而建筑物完好无损。

关于晶山村神秘消失事件,虽然没有官方的详细记载,但在民间和网络上却流传着大量的相关资料。

一些网友在论坛、博客等平台上分享自己的所见所闻和猜测,使得这一事件的影响力不断扩大。

此外,一些自媒体和网站也对这一事件进行了报道和解读,虽然其中不乏夸张和虚构的成分,但也为研究这一事件提供了一定的线索和参考。

例如,有资料显示,在晶山村消失事件发生后,我国超自然机构925基地曾对其进行过探索研究。

925基地是隐藏在北京郊区一所大院里的中科院下属的一个科研单位,专门研究一些神秘的灵异事件。

然而,该基地最终并未对外界透露过调查结果,这也使得这一事件更加神秘莫测。

科学视角:探寻真相的理性之路

从科学的角度来看,晶山村神秘消失事件目前仍然是一个未解之谜。

虽然民间流传着多种解释,但这些解释大多缺乏可靠的证据和科学的依据。

外星人绑架说虽然神秘有趣,但目前还没有确凿的证据证明外星人的存在,更不用说他们绑架地球村民了。

军事秘密行动说和特务渗透说虽然有一定的合理性,但也缺乏直接的证据支持。

自然灾害说则难以解释为什么只有活物消失而建筑物完好无损。

在科学研究中,我们需要遵循证据和逻辑的原则,不能轻易相信没有根据的猜测和谣言。

对于晶山村神秘消失事件,我们应该保持理性和客观的态度,等待更多的证据和线索出现。

秦岭未解之谜:龙脉之地和夜狸猫事件至今都仍被争论

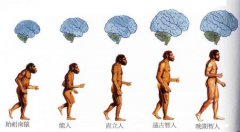

龙脉其实就是山脉。因为龙善于变化,能大能小,能屈能伸,能隐能现,能飞能潜。

山势就像龙一样变化多端,故而以"龙"称呼。

龙脉的形与势是有别,千尺为势,百尺为形,势是远景,形是近观。

势是形之崇,形是势之积。

有势然后有形,有形然后知势,势住于外,形住于内。

势如城郭墙垣,形似楼台门弟。

势是起伏的群峰,形是单座的山头。

秦岭横贯中国中部的东西走向山脉。

西起甘肃南部,经陕西南部到河南西部,主体位于陕西省南部与四川省北部交界处,呈东西走向, 长约1600多千米。

为黄河支流渭河与长江支流嘉陵江、汉水的分水岭。

秦岭脚下诞生了中国古代的绚烂文明。

因此,在秦始皇统一中国之前,秦岭被称为昆仑;后来,又因为秦岭矗立在秦国都城之南,所以秦岭又被称作终南山,或者南山。

也正是这些原因,秦岭被尊为华夏文明的龙脉,秦岭与淮河一綫被称为中国地理上最重要的南北分界线。

秦岭龙脉被称为昆仑三大龙脉中的中龙,意义非凡。

而且秦岭龙脉更特别的是,它竟然拥有两条最强的龙脉血液,就是长江和黄河。

山是龙的势,水是龙的血,因而龙脉离不开山与水。

龙脉之说中,龙脉讲究的是山水合一。

古代最早记述秦岭的文字是《山海经》和《禹贡》。

《禹贡》的成书时间大致为战国时期,在它的文字记述中,中国山脉的布局是一个"三条四列"的系统,其中秦岭被列为中条。

然而直到司马迁在他那著名的《史记》中,写下"秦岭,天下之大阻"这句话之后,秦岭才有了正式的文字记载。

秦岭龙脉出了多少个帝王古人们相信如果自己的陵墓能够埋在龙脉之下,自己的子孙后代就会享受永世的安宁,这也是大多数帝王陵墓选址都在龙脉的原因。

而我国最大的一条龙脉,埋了6代24位帝王,古墓数量都超过了十万座,那就是位于河南省洛阳市邙山北部的一处墓葬群。

在这片土地上,形成了周、秦、汉、唐四朝,更重要的是历史上有13个王朝在此建都,同时有72位皇帝在此登基称帝。

在这片土地上,埋葬着第一位皇帝秦始皇,然后是汉帝国的缔造者刘邦长陵,埋葬着整个西汉王朝的帝王陵。

包括汉孝惠帝刘盈的安陵、汉孝文帝刘恒的霸陵、汉孝景帝刘启阳的陵寝、汉孝武帝刘彻的茂陵等等,所有这些西汉的皇帝都葬在这里。

这足以说明这里的风水是独一无二的。

除了皇帝,还有很多王公大臣都葬在这里。

这些人被给了这个地方来埋葬。

比如卫青和霍去病的墓在这里,他们的墓在西汉墓中,就是为了纪念他们在西汉打败匈奴的功绩。

从1959年开始,东方帝王谷开始发掘,在此后的一段时间里,直到现在,这里的很多帝王陵墓都没有被发掘,比如秦始皇陵。

值得一提的是,在秦始皇陵周边,发现了17座甲字形陪葬墓,棺椁等级很高。

但随葬品和尸骨与其他帝王陵墓不同。

大部分死者尸骨散落,身首分离,这些人的身份在史学界仍有争议。

多数历史学家认为,这些人是秦二世胡亥的兄弟姐妹,这从另一个角度来看是完全可能的。

从棺材等级上看,应该是这样的,如果不是秦始皇的亲戚,那么一般人肯定不会有棺材等级。

古代的丧葬文化非常严格,一个人死后,绝不会随葬入葬品。

要说秦岭有龙脉什么的传闻可是流传了好久的,有龙脉的地方嘛,总是带点灵气什么的,就算发生些什么诡异的事件也是可以理解的。

这个2010年的秦岭事件最早是在网上流传起来的,那个时候网络刚刚普及,很多年年轻人喜欢上网,一则关于"秦岭山底一个村庄一夜之间消失"的帖子在网络上疯传,特别是当时的微博上被疯狂转载。

帖子里面讲到:一整个村庄全部神秘消失,包括所有的牲畜和人类...文章中说道"听说,昨天凌晨4点,秦岭山底的一个村庄,一夜之间全部消失了!...这件事已经引起了当地领导高度重视,直到现在有大批军队在封锁现场..."其实内容真的是说的语焉不详的,但是又将重点标会出来,失踪,而且是集体失踪,还是比较吸引人的,加上这件事将军方政府什么的牵扯进来,所以真的是十分抓住吃瓜群众的眼球..但是经过发酵之后,网友在关注所谓的"秦岭山脚下一村庄消失"。

据此地域相关人员称,事件发生后凌晨四点秦岭山下一村庄神秘消失,事发地被军队封锁,网上已全被和谐掉,事发晚上10点左右,好多人都看见秦岭方向上空有非常诡异的闪光,据目击者说,那种闪光是紫色的,那个地方周围三五里全是黑云。

更多的网友是对此事将信将疑,保持怀疑态度的。

经过调查之后,以及秦岭周边的汉中市、安康市、宝鸡市、西安市、商洛市求证,各个地区均表示没有接到相关报告,所以,这的确有可能是一个网络谣言...

在整个太阳系里,月球的存在本身就是最大的bug,越来越多疑点指向外星造物

从古至今,月球都是夜空中最温柔的存在,我们一直默认它是天然形成的卫星。但随着人类登月探测、地质数据解析,越来越多反常现象浮出水面。

很多科学家大胆提出猜想:月球或许不是普通天体,它有可能是外星文明刻意制造的球体,甚至是一颗隐藏在地球身边的巨型宇宙飞船。

今天我们聊聊月球身上那些无法解释的奇怪疑点,看完颠覆你的认知。

离谱到反常的完美天体比例在整个太阳系里,月球的存在本身就是最大的bug。

按照天然天体规律,行星的卫星普遍偏小,比例差距悬殊。

但月球和地球的比例太夸张了,大小配比完全不符合宇宙常态。

月球直径足足是地球的四分之一,质量比例远超太阳系所有卫星。

这么大的卫星,稳稳围绕地球旋转,本身就充满违和感。

更诡异的是日月完美重合的天文巧合。

太阳距离地球的距离,刚好是月球距离的400倍。

太阳直径也恰好是月球的400倍,这才让日全食完美上演。

这种极致精准的概率,天然形成的可能性几乎为零。

永远背对地球的神秘背面月球最让人细思极恐的一点,就是潮汐锁定。

数十亿年来,月球永远只有正面朝向地球,背面从不示人。

天然星球的自转和公转,很难做到如此绝对、永久的同步。

这就像有人刻意操控,固定住月球的姿态。

仿佛是故意不让人类看见,月球背面隐藏的秘密。

早年人类从未探测月球背面,各种外星基地、飞船猜想层出不穷。

即便如今探测器拍下背面影像,依旧疑点重重。

空心结构:颠覆天文常识的诡异震动如果月球是天然岩石星球,它一定是实心结构。

但美国阿波罗登月任务,曾做过一个震惊世界的地震实验。

宇航员在月球表面投放登月舱,撞击月面引发月震。

让人难以置信的是,月震持续了整整三个小时才消散。

科学家解释:实心岩石星球,震动会快速衰减。

只有空心球体,才会产生长时间回荡的震动效果。

这直接推翻了月球是天然实心星球的固有结论。

一颗天然形成的天体,不可能是完美的空心结构。

年龄悖论:月球比地球还要古老按照天体演化逻辑,卫星的形成时间,绝对晚于行星。

但科学家对月球岩石采样检测,得出惊人结果。

月球采集的岩石样本,年龄普遍在53亿年以上。

而我们居住的地球,目前公认年龄只有46亿年。

月球比地球还要古老7亿年,彻底违背天体演化规律。

它不是地球诞生后衍生的卫星,更像是外来的“不速之客”。

金属外壳:疑似人工装甲层探测器数据分析发现,月球表层金属含量异常离谱。

月球表面存在大量稀有金属、钛合金、耐高温金属层。

这些金属纯度极高,天然地质运动根本无法形成。

更诡异的是,月球表层有一层坚硬的金属硬壳。

厚度远超天然岩石层,硬度异常强悍。

很多研究者大胆推测:这是宇宙飞船的防护装甲层。

内部空心、外层装甲、精准轨道,完全符合人造飞行器特征。

大胆猜想:月球是外星文明的观测飞船综合所有反常疑点,越来越多学者认可一个大胆猜想。

月球根本不是天然卫星,而是外星文明打造的巨型宇宙飞船。

它被刻意放置在地球轨道,用来长期观测、监测地球文明。

空心结构是内部舱体,金属层是防护外壳,锁定姿态是刻意控制。

数十亿年来,它静静悬停在地球身旁,默默注视着人类演化。

写在最后目前没有任何证据,能百分百证实月球的真实身份。

但所有违背自然规律的细节,都在指向同一个答案。

这颗陪伴人类亿万年的银色星球,或许从来都不简单。

它不是自然的馈赠,而是来自宇宙深处的巨型造物。

至于外星文明为何放置月球,背后藏着怎样的目的,至今仍是宇宙最大的未解之谜。

猜你喜欢