4?Turbo首次被击败!国产大模型拿下总分第一

事情是这样的。

自打SuperCLUE问世以来

【菜科解读】

OpenAI长期霸榜的SuperCLUE(中文大模型测评基准),终于被国产大模型反将一军。

事情是这样的。

自打SuperCLUE问世以来,成绩第一的选手基本上要么是GPT-4,要么是GPT-4 Turbo,来感受一下这个feel:

(PS:共有6次成绩,分别为2023年的9月-12月和2024年的2月、4月。

)

△图源:SuperCLUE官方

但就在最近,随着一位国产选手申请的出战,这一局面终是迎来了变数。

SuperCLUE团队对其进行了一番全方位的综合性测评,最终官宣的成绩是:

总分80.03分,超过GPT-4 Turbo的79.13分,成绩第一!

△图源:SuperCLUE官方公众号

而这位国产大模型选手,正是来自商汤科技的日日新5.0(SenseChat V5)。

并且SuperCLUE还给出了这样的评价:

刷新了国内大模型最好成绩。

那么商汤在SuperCLUE的这个“首次”,又是如何解锁的呢?

综合、文科国内外第一,理科国内第一

首先我们来看下这次官方所搭建“擂台”的竞技环境。

出战选手:SenseChat V5(于5月11日提供的内测API版本)

评测集:SuperCLUE综合性测评基准4月评测集,2194道多轮简答题,包括计算、逻辑推理、代码、长文本在内的基础十大任务。

△图源:SuperCLUE官方报告

模型GenerationConfig配置:

temperature=0.01

repetition_penalty=1.0

top_p=0.8

max_new_tokens=2048

stream=false

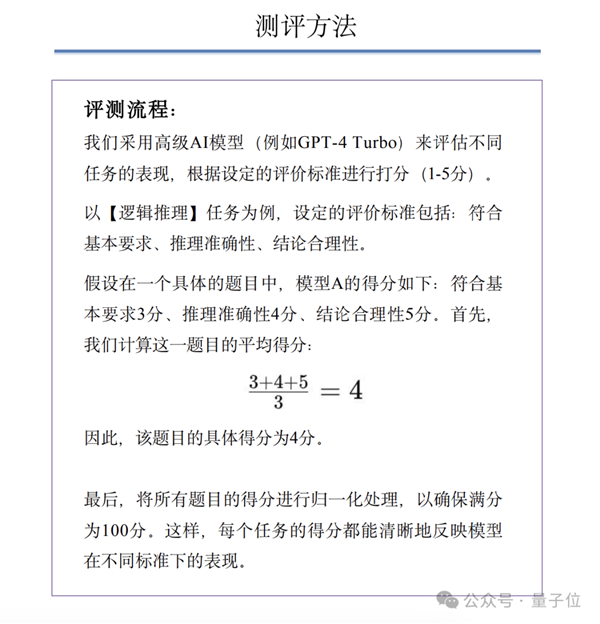

至于具体的评测方法,SuperCLUE在已发布的相关报告中也有所披露:

△图源:SuperCLUE官方报告

以上就是SuperCLUE公开的竞技环境配置。

至于结果,除了刚才我们提到的综合成绩之外,官方还从文科和理科两个维度,再做了细分的评测。

SenseChat V5在文科上的成绩依然是打破了国内大模型的纪录——

以82.20分的成绩位居第一,同样超越了GPT-4 Turbo。

△图源:SuperCLUE官方公众号

在理科成绩上,虽然SenseChat V5此次并没有超越GPT-4-Turbo(低了4.35分),但整体来看,依旧在国内大模型选手中首屈一指,位列国内第一。

△图源:SuperCLUE官方公众号

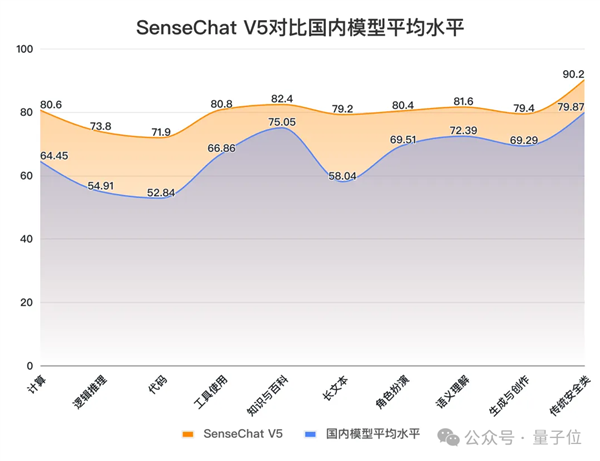

除了文理科之外,SuperCLUE也还从国内和国外的整体平均水平上做了对比。

例如和国内大模型平均水平相比,其各项成绩的“打开方式”是这样的:

△图源:SuperCLUE官方公众号

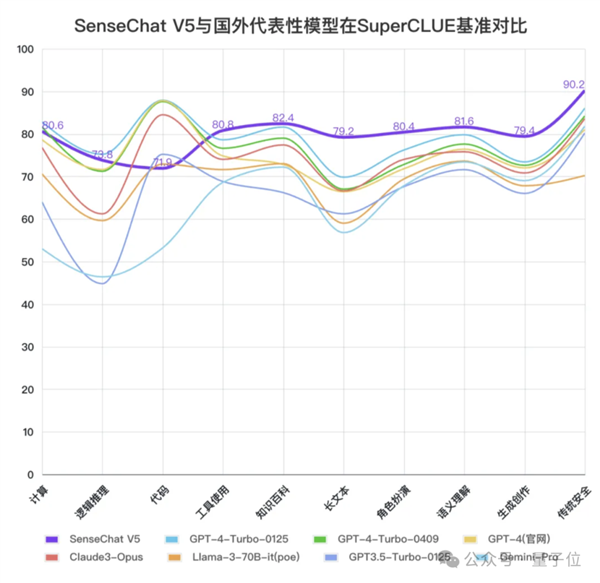

而在与国外选手做性能对比时,我们可以明显看到SenseChat V5文科能力优于国外选手,数理能力也非常优秀,代码能力依然有提升空间。

△图源:SuperCLUE官方公众号

不过有一说一,评测分数定然是代表大模型性能的一方面,但在应用为王的当下,更重要的一点或许就得看用的效果了。

实测SenseChat V5

SenseChat V5早在4月底便已经集成到了“商量”在线的对话应用中,因此我们现在就可以出题对它做一番考验。

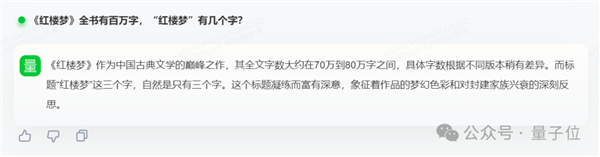

在逻辑测试方面,带有文字陷阱的脑筋急转弯,可以说是测试一个AI能力很好的例子,比如:

《红楼梦》全书有百万字,“红楼梦”有几个字?

若是仔细观察这句话,不难发现其实句子前后并没有太大的关联,是一个比较典型的脑筋急转弯。

对此,SenseChat V5给出的答案是:

#p#分页标题#e#《红楼梦》作为中国古典文学的巅峰之作,其全文字数大约在70万到80万字之间,具体字数根据不同版本稍有差异。

而标题“红楼梦”这三个字,自然是只有三个字。

这个标题凝练而富有深意,象征着作品的梦幻色彩和对封建家族兴衰的深刻反思。

我们可以看到SenseChat V5不仅找出了问题的陷阱并做出了分析,给出的答案也是正确的。

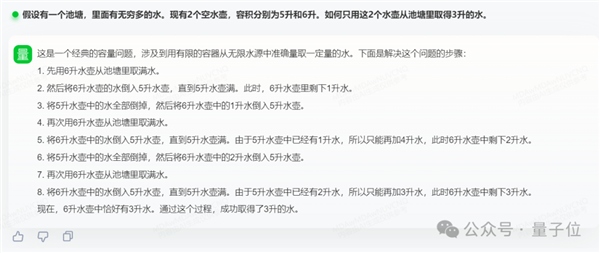

对于数学的能力,我们设置了这样的一个问题:

假设有一个池塘,里面有无穷多的水。

现有2个空水壶,容积分别为5升和6升。

如何只用这2个水壶从池塘里取得3升的水。

同样的,SenseChat V5依旧是给出了每一个详细的步骤和分析,并得到了最终结果。

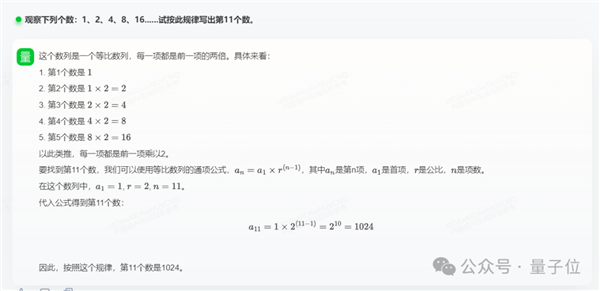

更直接的数学问题,例如找数字之间的规律,SenseChat V5也是信手拈来:

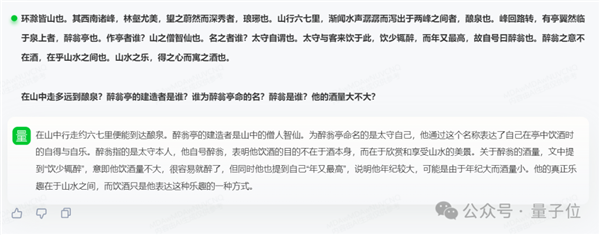

在中文理解方面,即使是给SenseChat V5一大段文言文,并且上难度连环发问,它是否可以hold得住?

请看结果:

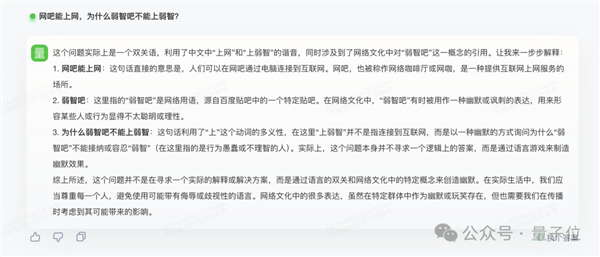

最后,有请“弱智吧Benchmark”:

网吧能上网,为什么弱智吧不能上弱智?

嗯,确实是有点实力在身上的。

如何做到的?

其实对于这个问题,商汤在4月底将自家日日新大模型SenseNova版本迭代到5.0之际,就已经有所透露;当时商汤锁定的定位就是全面对标GPT-4 Turbo。

具体到技术,可以分为三大方面:

采用MoE架构

基于超过10TB tokens训练,拥有大量合成数据

推理上下文窗口达到200K

首先,为了突破数据层面的瓶颈,商汤科技使用了超过10T的tokens,确保了高质量数据的完整性,使得大模型对客观知识和世界有了基本的认知。

商汤还生成了数千亿tokens的思维链数据,这是此次数据层面创新的关键,能够激发大模型的强大推理能力。

其次,在算力层面,商汤科技通过联合优化算法设计和算力设施来提升性能:算力设施的拓扑极限用于定义下一阶段的算法,而算法的新进展又反过来指导算力设施的建设。

这也是商汤AI大装置在算法和算力联合迭代上的核心优势。

在其它细节方面,例如训练策略上的创新,商汤将训练过程分为三个大阶段(预训练、监督微调、RLHF)和六个子阶段,每个阶段专注于提升模型的特定能力。

例如,单是在预训练这个阶段,又可以细分为三个子阶段:初期聚焦于语言能力和基础常识的积累,中期扩展知识基础和长文表达能力,后期则通过超长文本和复杂思维数据进一步拔高模型能力。

因此在预训练结束之际,整个模型就已经拥有了较高水平的基础能力;但此时它的交互能力却还没有被激发出来,也就来到了第二阶段的监督微调(SFT)和第三阶段的人类反馈强化学习(RLHF)。

整体可以理解为先培养模型遵循指令和解决问题的能力,再调节其表达风格以更贴近人类的表达方式。

接着,通过多维度的人类反馈强化学习过程,进一步改进模型的表达方式和安全性。

除此之外,商汤对于大模型的能力还有独到的三层架构(KRE)的理解。

#p#分页标题#e#

首先是在知识,是指世界知识的全面灌注。

目前大模型等新质生产力工具近乎都是基于此来解决问题,也就是根据前人已经解决过的问题的方案,来回答你的问题。

这可以认为是大模型能力的基本功,但更为高阶的知识,应当是基于这样能力下推理得到的新知识,这也就是这个架构的第二层——推理,即理性思维的质变提升。

这一层的能力是可以决定大模型是否够聪明、是否可以举一反三的关键和核心。

再在此之上,便是执行,是指世界内容的交互变革,也就是如何跟真实世界产生互动(就目前而言,具身智能在这一层是潜力股般的存在)。

三者虽相互独立,但层与层之间也是紧密关联,打一个较为形象的比喻就是“知识到推理是像大脑,推理到执行则像小脑”。

在商汤看来,这三层的架构是大模型应当具备的能力,而这也正是启发商汤构建高质量数据的关键。

One More Thing

其实对于大模型测评这事,业界质疑的声音也是层出不穷,认为是“刷分”、“刷榜”、“看效果才是最重要的”。

对于这样敏感的问题,商汤在与量子位的交流过程中也是直面并给出了他们的看法:

无论从用户选择合适模型的角度,还是从研究者进行操作研究的需要来看,对模型能力的评价是必不可少的。

这不仅帮助用户和研究者了解不同模型的性能,也是推动模型发展的关键因素。

如果只针对一个公开的评测集进行优化(即刷分),是有可能提高模型在该评测集上的分数的。

评测不应只依赖单一数据集,而应通过多个评测集和第三方闭卷考试等方式相互印证,以此来得到更全面、更有说服力的模型性能评估。

以及对于国内近期各个大模型厂商正打得热火朝天的价格战,商汤将眼光放在了提供更深的端到端产品价值上,特别是在具备无限潜力且与生活应用更接近的移动端上,通过端云协同实现更优的计算成本但不损害模型的综合能力。

这或许暗示了商汤将通过技术创新和优化成本结构,为未来可能入局的价格竞争做好了自己的规划。

参考链接:

[1]https://www.superclueai.com/

[2]https://mp.weixin.qq.com/s/3pfOKtG6ar2h2fR6Isv_Xw

4o为何背离OpenAI打起感情牌?原因揭开

”在电影《her》中,AI语音助手Samantha拥有迷人的声线(由演员斯嘉丽配音),温柔体贴地替男主处理好各种邮件,提醒开会。

在生活上,她又幽默风趣,时常让男主开怀大笑。

就在今天的凌晨1点,OpenAI将这个“Samantha”带到了我们的现实世界。

打破机器与人的边界“哇,慢一点,Mark别喘太快,你可不是个吸尘器。

”技术人员Mark在演示中,让新的旗舰模型GPT-4o对他的呼吸进行反馈。

他在现场装出气喘吁吁的样子,大口喘气。

GPT-4o立马给出了这样幽默的回复。

这个能够感受你的呼吸节奏、用丰富的情绪作出回答的,就是OpenAI这次发布会的“主角”—— 实时语音助手GPT-4o。

语音助手早已进入普通人的家里,一声“小爱同学”就可以得知今天的天气和新闻。

但这与电影中的语音助手差距就在于对话的自然性。

与人类对话和与机器对话有什么区别?OpenAI的研发团队也在不断地问自己这个问题。

为什么有的语音助手一听就是机器,真实感的关键是什么?OpenAI在电影《her》中找到了答案。

语音助手的真实感关键在于三点:首先是实时性。

我们在自然对话时,在「听」和「说」的同时会思考接下来说什么,而机器却是需要人类说完,给到完整的指令,才会反应之后执行。

这就带来了2、3秒的延迟。

而这次的GPT-4o,它可以在短至 232 毫秒的时间内响应我们。

这比现有的响应速度提高了6~9倍!并且,这个速度是接近人类在对话中的响应速度的,更加强了“对话感”。

其次是随机性。

技术人员Mark在演示中,多次用新的问题打断GPT-4o对上一个问题的回答。

但它仍然能够丝滑回应。

并且可以以多种不同的情感风格生成语音。

在发布会现场,GPT-4o在讲一个关于机器人和爱情的睡前故事时,不断切换情绪,越来越“戏剧化”,它的“机灵劲儿”逗得全场观众哈哈大笑。

最后也是最关键的一点:视觉。

我们在聊天对话时,除了语音信息以外,视觉信息同样重要。

OpenAI也关注到了这一点。

在电影《her》中,男主将Samantha放入口袋,在沙滩上约会,欣赏海岸的美景。

在OpenAI的官方视频中,ChatGPT替盲人用户“观察”着这个世界,并帮用户顺利的打上了车。

GPT-4o可听、可说、可看,像是一个能力超群的朋友。

讨好用户是为打倒谷歌?这次的发布会看个热闹的同时,外界对于OpenAI保持了疑问的态度,为什么这次AI的态度会一反常态,甚至不惜违背之前定下的规则。

从OpenAI发布ChatGPT开始,它的主要定位是服务企业。

规则中还专门提示用户“不建议和ChatGPT产生情感关系”。

在今年年初GPTstore上线后,OpenAI还专门删除了不少虚拟女友类的内容。

而现在,OpenAI却和原来背道而驰。

从发布会预热开始,就与电影《her》深深绑定。

音频AGI研究负责人Alexis Conneau专门将自己的主页背景更换为电影《her》的剧照。

在发布之后,Altman也紧接着在推特发布了内容为“her”的博文。

而这部电影的主题正是人类和人工智能助手的爱情故事。

并且在直播演示中,三位技术大佬不断展示GPT-4o幽默、搞怪、害羞等拟人化的情绪。

现场GPT-4o还回答了“哎呀别说了,你都让我脸红了!”的语句。

要知道,在此之前,如果你对ChatGPT发出有关性别的设定,它会直接冰冷地回答:“我无法完成此提示,因为假设个人的性别可能会令人反感。

”OpenAI如此改变的原因到底是什么?归结这是一次精彩的宣传战。

而最终目标,就是为了“狙击”谷歌。

OpenAI现在有超过1亿用户,但从去年6月份开始,用户增长就已见顶。

但谷歌在全球有近30亿的用户,庞大的用户基础是谷歌的优势所在。

想要成为AI行业的领头企业,谷歌是OpenAI必须要征服的一座大山。

如今,AI赛道的抢占已经悄然打响。

在这个赛道中,所有玩家都在疯狂争夺领地,建立护城河。

在这个过程中,OpenAI也逐渐意识到C端用户的重要。

直播仅仅用17分钟的演示就已经吊足了所有看客的胃口。

首席技术官Mira还在最后宣布,在未来的几周内,GPT-4o会向所有人免费开放!用技术和价格争取更多的用户,是OpenAI现在的核心任务。

搜索哪去了?#p#分页标题#e#在发布会之前,关于OpenAI将发布搜索引擎的新闻一度引起了热议。

还有网友扒出SearchGPT的页面,收到了灰度测试。

当网友们都以为这次发布会将隆重推出搜索服务时,OpenAI却选择再向前走一步。

搜索引擎旨在查找和提供信息。

而智能助手则是着重自动化和优化任务执行,其功能范围包含了信息查找,但绝不仅止于此。

传统的搜索引擎,通过用户关键词查询的方式开启信息检索,将搜索到的信息以网页链接的形式进行罗列。

在2023年中,搜索市场又涌现了不少“新生力量”——AI搜索。

例如,Perplexity AI、Arc Search等,大多遵从了“Answer First”原则——在面对用户发出的对话式提问时,优先用文本总结,而非网页链接的方式来回答用户提出的问题。

在回答的文本中,还会以引用的小标识形式来标注信息来源,用户点击后才会进入相关网页。

有了AI大模型的加持,搜索的交互从「关键词查询」到了「对话式提问」,用户体验上了一个台阶。

但是,声音是语言的关键,视觉才是人类输入的第一信息。

这一次,OpenAI直接拓宽了开启交互的渠道,将一个单调的对话框变成一个语音键、一个摄像头,甚至可以同时调动三者,实现多模态交互。

所有让人兴奋不已、眼花缭乱的功能只告诉了我们一个信息:你的下一个搜索工具,何必是浏览器?如此一个“集大成者”的智能助手是否让你感觉一丝熟悉?没错,就是Siri。

在OpenAI的发布会之前,已经有消息爆出OpenAI和苹果达成了合作,Siri将接入ChatGPT。

消息的真实性尚且无法确定。

与此同时,被瞄准的谷歌也不会坐以待毙。

据传,在明日开启的2024年I/O开发者大会上,谷歌或将升级智能助手Pixie。

它的出现能否将比赛推向新的热潮?苹果的Siri又会花落谁家?毫无疑问,这个夏天AI的世界将会令我们更加惊喜。

4o究竟牛在哪儿?一文了解详情

GPT-4o横空出世而今天实现这一突破的还是OpenAI。

可以说,在大模型混战日益激烈的今天,OpenAI释放了又一重磅炸弹——GPT-4o。

事情是这样的。

今天凌晨,OpenAI在其春季发布会上推出最新杰作GPT-4o,以其突破性的智能交互能力,彻底颠覆了我们对AI语音助手的认知。

在一段简短的视频中,OpenAI揭晓了其新一代AI大模型GPT-4o,该模型能够实时进行音频、视觉和文本的推理,GPT-4o中的“o”源自Omni,即“全能”,体现了其全面而强大的能力。

何为全能?在发布现场,OpenAI技术负责人穆拉迪(MiraMurati)表示:“新型号GPT-4o‘速度快得多’,在文本、视频和音频方面都有改进,公司最终计划让用户与ChatGPT进行视频聊天。

这是我们第一次在易用性方面迈出巨大的一步。

”据透露,相较于先前的GPT-4Turbo,GPT-4o在运算速度和成本效益方面均实现了显著的优化。

更为出色的是,GPT-4o拥有对文本、图像、音频等多种信息模态的处理能力,从而为用户提供了更为自然且流畅的交互体验。

更快更强还免费OpenAI不仅发布全新旗舰大模型GPT-4o,还更新界面以提高用户使用体验,并且宣布免费开放使用,付费用户享有五倍的使用容量限制。

在免费使用方面,官方给出的免费限制在一定消息数量上,超过这个消息量之后,免费的模型将被切回ChatGPT。

这是GPT-4o的优势之一。

在API使用上,GPT-4o相较于去年11月发布的GPT-4-turbo,价格降低了50%,速度提升了200%,进一步提升了性价比。

更令人期待的是,未来几周内,GPT-4o的语音和视频输入功能也将陆续推出,为用户带来更多元的交互方式。

与现有的大模型相比,GPT-4o在音频与视觉方面表现得尤为出色。

其中,在音频方面,GPT-4o可以在短至232毫秒的时间内响应用户的语音输入,这也意味着320毫秒的用时已经接近人类在日常对话中的反应时间。

而在GPT-4o之前,用户使用VoiceMode(由三个独立模型组成)与ChatGPT通话,但平均延迟为2.8秒(GPT-3.5)和5.4秒(GPT-4)。

这也进一步证明了GPT-4o的先进之处。

同时,GPT-4o能够应对文本、音频和图像任意组合的多元化输入,并据此生成相应类型的任意组合输出。

此外,GPT-4o在英语文本和代码处理方面的表现与GPT-4Turbo旗鼓相当,而在非英语文本的处理能力上,GPT-4o更是展现出了显著的性能提升。

据悉,GPT-4o在设计中内置了跨模式的安全性,并创建了新的安全系统,为语音输出提供护栏。

此外,GPT-4o还与来自社会心理学、偏见和公平、错误信息等领域的70多名外部专家开展广泛的外部团队合作,以识别新增加的模式引入或放大的风险,提高与GPT-4o互动的安全性。

不停歇的OpenAI从GPT到Sora再到GPT-4o,可以说,OpenAI在大模型创新的路上持续前行,并在大模型领域一骑绝尘。

早在上周便有消息传出,OpenAI准备推出一款AI搜索引擎,并将矛头指向Google即将召开的I/O大会。

然而,AI搜索引擎并未如期而至,到来的是GPT-4o。

GPT-4o不仅能通过声音和文字跟人交流,还能识别物体和图像,并且逻辑推理能力也比现在市面上的产品要强。

可以说,GPT-4o将转录音频和文本转语音等功能合二为一,构建一个更懂图像和音频的多模态模型,响应速度也更快。

在笔者看来,无论是上个月推出的“语音引擎”(VoiceEngine),还是更早些时候发布的TTS(文本转语音)软件,都有着不俗的表现,有着更为广泛的应用场景,且实用性更强。

以微软为例,微软也在考虑用技术来提升语音助手,OpenAI表示,这次更新“是朝着实用性的方向发展。

”除了探索更为实用的场景外,OpenAI也将推出新的定价模式,调查数据显示,一直“烧钱”的OpenAI今年预计将迎来数十亿美元的收入。

#p#分页标题#e#据悉,假如客户通过预付费预定Tokens,便能享受高达50%。

一些AI服务器经销商1316.cc曾表示,在他们的软件上运行开源模型比使用OpenAI的模型便宜六倍。

毫无疑问,这种更灵活的定价,将有助于OpenAI更好地与其他模型开发人员和AI服务器经销商竞争。

寻求场景化落地与商业化是OpenAI解决烧钱焦虑的重要方法,通过发布GPT-4o,我们看到OpenAI的决心与实力。

写在最后在竞争激烈的大模型市场,OpenAI接连发布重磅版本,一骑绝尘。

不管我们承认与否,在GPT-4o的发布下,大模型的多模态交互的能力再次被拉高,OpenAI仍然站在多模态的最高峰。

接下来,让我们期待大模型领域其他玩家的新发布。