喜马拉雅山的雪人是外星人吗?

【菜科解读】

在生活中人们所看到的雪人,一般都只是用雪堆成的,但是人们可能并没有见过半人半猿的生物,在全国各地都曾经有些人的事件。

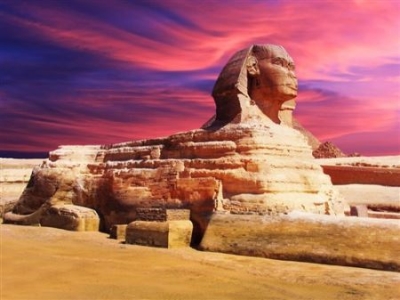

比如最让大家奇怪的就是喜马拉雅山的雪人,关于喜马拉雅山的雪人会拥有着很多的谜团,有不少人都曾经说过亲眼目睹过,只是有许多人认为这根本就是外星人。

虽然在经过大家描绘之后,就拥有着高大威武的形象,是一种传奇的生物,而关于雪人的传说其实就可以直接追溯到公元326年。

当时人们就说在雪山上出现明显的雪人,全身上下都是黄色的毛发,但是不少人都会认为这可能是外星人,因为这么高大的形象很显然并非是寻常的动物。

在看到众人的猜测之后,探险队开始有了兴趣,所以在1953年的时候来到印度,准备寻找庞然大物。

可是当大家在来到这里时,经过多年的调查都没有找到确切的雪人标本,这就是一种非常神秘的动物,而人们讨论最多的分支就是喜马拉雅山的雪人。

从公元前326年开始,世间就会拥有着和雪人相关的谜题,在人们的印象中,雪人有时温柔,有时凶猛,据说,在1957年时,曾经有一位来自于尼泊尔的姑娘和往常一样上山砍柴,却不想居然跳出一个红发白毛的动物,在经过一番搏斗之后才终于跑回了家中。

所以人们才会推测,这根本就不是动物,很有可能是外星人。

珠穆朗玛峰雪人传说:这种被当地人称为“夜帝”

在巍峨的珠穆朗玛峰与喜马拉雅山脉的冰封峡谷间,流传着一个跨越千年的神秘传说——雪人(Yeti)。这种被当地人称为“夜帝”(藏语意为“岩石上的居民”)的生物,被描绘为身高1.5至4.6米、覆盖灰黄色或白色长毛、能直立行走的类人猿类。

从公元前326年的古老记载到现代登山者的目击报告,雪人的身影始终笼罩在迷雾中,既未被科学证实存在,也未被彻底否定。

千年传说的起源与演变雪人的传说最早可追溯至18世纪的中国古画与尼泊尔古籍。

1832年,英国公使B·H.霍德森在《阿尔泰·喜马拉雅》中首次用文字描述了一种“遍体黑毛、无尾、直立行走”的生物。

1887年,英国军医瓦德尔少校在锡金5000米雪地上发现巨大脚印,当地挑夫称其为“雪人”足迹,这一名称由此广为流传。

1921年,英国登山队在珠峰北坡发现神秘脚印,引发全球关注。

1925年,希腊摄影师尼卡尔斯·托玛齐在海拔4500米处目击一个“黑发、直立行走”的人形生物;

1938年,维多利亚纪念馆馆长奥维古上尉在暴风雪中被近3米高的“雪人”掩护救命;

1951年,英国登山家希普顿拍摄的31.3厘米长、18.8厘米宽的脚印照片,成为雪人存在的标志性证据。

这些事件将雪人传说推向高潮,甚至催生了“雪人热”——1953年,埃德蒙·希拉里率领的探险队专程赴尼泊尔搜寻雪人,虽未成功,却进一步推动了传说传播。

目击者的惊魂记忆雪人的传说因无数目击者的描述而愈发鲜活。

1975年,尼泊尔夏尔巴族姑娘在砍柴时遭雪豹袭击,一个“红发白毛、肌肉发达”的生物冲出与雪豹搏斗,救下姑娘后消失;

1957年,美国石油工人托马斯·斯利克在尼泊尔被“雪人”追踪,当地人声称4年内已有5人遭袭;

1959年,中国境内尼泊尔边民报告牦牛被“雪人”咬断喉咙吸干血液,现场发现156厘米长的棕色毛发。

最离奇的当属1953年探险队的故事。

老登山向导桑杰回忆,1953年他带领国际登山队挑战珠峰时,日本科学家野村博士携带科学仪器执意寻找雪人。

某夜暴风雪中,桑杰与野村发现巨大脚印和山洞内的生活痕迹——草垫、火塘、兽骨,甚至一块带银白色毛发的皮肤样本。

野村留下“跟随他们而去,寻找真相”的字条后失踪,仅留下一瓶覆盖细毛的皮肤样本。

这一事件被当地人视为雪人传说的现代注脚,但官方最终将毛发鉴定为喜马拉雅棕熊所有。

科学探索的争议与突破尽管传说引人入胜,科学界对雪人的存在始终持谨慎态度。

20世纪50年代,中科院等机构曾派出专业队伍调查,发现所谓“雪人头皮”实为羚羊皮伪造;

1960年,希拉里带回的“雪人”皮毛经鉴定属于棕熊和黑熊;

2014年,牛津大学遗传学家布莱恩·赛克斯声称发现与古代北极熊相关的“雪人”DNA,但2017年纽约州立大学布法罗分校的夏洛特·林德奎斯特团队通过更全面的基因分析,证实所有“雪人”样本均来自已知熊类或狗,彻底否定了赛克斯的结论。

现代科学认为,雪人传说可能是多种现象的混合产物:极端环境下,探险者因缺氧、低温产生的幻觉;

已知动物(如棕熊、雪豹)的误认;

以及文化传统对未知生物的想象性构建。

例如,喜马拉雅棕熊在雪地行走时,直立姿态和庞大体型易被误认为雪人;

融雪后变形的动物脚印也可能被解读为神秘生物的足迹。

传说背后的文化密码雪人不仅是自然之谜,更是喜马拉雅文化的象征。

藏传佛教典籍中记载的“雪山隐士”、夏尔巴人传说中的“山神使者”,均赋予雪人神圣意义。

当地人相信,雪人是“冈德瓦”生灵——介于人与神之间的存在,既非人类也非动物,而是自然灵性的化身。

这种信仰与探险者的科学探索形成微妙张力:前者以敬畏之心守护传统,后者以理性精神追求真相。

谜团未解,探索不止时至今日,雪人传说仍是喜马拉雅山脉最持久的谜题。

尽管科学证据尚未支持其存在,但无数目击报告、历史记载与文化传承,让这一传说超越了生物学范畴,成为人类探索未知、敬畏自然的永恒隐喻。

正如老登山向导桑杰所言:“雪山有雪山的规矩,有些秘密本就不该被完全揭开。

”或许,雪人的真正价值,不在于它是否真实存在,而在于它提醒我们:在浩瀚自然面前,人类永远是谦卑的求知者。

英伟达力荐,小团队两个月开源一款「光速级」智能体推理引擎

机器之心编辑部 智能体时代的核心是算力。尤其是在 Coding Agent 爆发之后,算力问题变得前所未有地尖锐。

Claude Code、Codex、Cursor 等产品正在把 AI 从「问答工具」变成「持续运行的软件协作者」,单次会话轻松突破 50K tokens,系统负载转向了更极端、更复杂的智能体负载。

最近有关算力的大新闻层出不穷。

今天的最新消息:马斯克的 SpaceX 与 Anthropic 宣布达成了重磅协议,超过 22 万块英伟达 GPU 将为 Anthropic 所用。

而 Anthropic 对与 SpaceX 合作开发未来的太空算力体系「表示有兴趣」。

在如此庞大的算力需求下,除了开源还有节流。

也是今天的最新消息:OpenAI 发布了多路径可靠连接 (MRC),可帮助大型 AI 训练集群更快、更可靠地运行,并减少 GPU 时间的浪费。

我们知道,即便只是单 GPU 吞吐率上的微小提升,一旦应用到生产级集群中,也能够在服务持续增长需求的同时,节约相当可观的算力。

来自 LightSeek Foundation 的一个小团队,在两个月时间内打造了一个全新的,号称「光速」的大模型推理引擎 TokenSpeed。

这一引擎拥有 TensorRT LLM 级别的性能,vLLM 级别的易用性。

并且拥有 NVIDIA Blackwell 上最快的 MLA 注意力内核。

一经发布,TokenSpeed 就受到了英伟达发推文力荐。

目前,该引擎已经开源。

让我们参阅其技术博客,来深入了解「光速」引擎的技术细节。

博客标题:TokenSpeed: A Speed-of-Light LLM Inference Engine for Agentic Workloads 博客链接:https://lightseek.org/blog/lightseek-tokenspeed.html Github 链接:https://github.com/lightseekorg/tokenspeed TokenSpeed 技术简介 TokenSpeed 从第一性原理出发,专门为智能体推理场景设计。

它为智能体负载提供接近「光速级」的推理能力,核心包括:基于编译器的并行建模机制、高性能调度器、安全的 KV 资源复用约束、支持异构加速器的可插拔分层 kernel 系统,以及用于低开销 CPU 侧请求入口的 SMG 集成。

建模层采用本地 SPMD(Single Program, Multiple Data,单程序多数据)设计,在性能与易用性之间取得平衡。

TokenSpeed 允许开发者在模块边界指定 I/O placement 注解。

随后,一个轻量级静态编译器会在模型构建过程中自动生成所需的 collective operation,从而无需手动实现通信逻辑。

TokenSpeed 调度器将控制平面(control plane)与执行平面(execution plane)解耦。

控制平面使用 C++ 实现,并被构建为一个有限状态机(FSM),结合类型系统,在编译期而非运行期强制执行安全资源管理,包括 KV cache 状态转移与使用。

请求生命周期、KV cache 资源以及重叠执行时序,都通过显式 FSM 状态迁移与所有权语义进行表示,因此系统正确性并非依赖约定,而是由一个可验证的控制系统来保证。

执行平面则使用 Python 实现,以保持开发效率,使研究人员与工程师能够更快进行功能迭代,并降低整体认知负载。

TokenSpeed 的 kernel 层将 kernel 从核心引擎中解耦,并将其视为一级模块化子系统。

它提供了可移植的公共 API、集中的注册与选择机制、组织良好的实现结构、面向异构加速器的可扩展插件机制、经过整理的依赖体系,以及统一的快速迭代基础设施。

与此同时,团队还针对 NVIDIA Blackwell 架构进行了大量性能优化。

例如,他们构建了当前智能体负载场景下速度最快的 MLA(Multi-head Latent Attention,多头潜在注意力)kernel 之一。

在 decode kernel 中,由于部分场景下「num_heads」较小,团队通过对「q_seqlen」与「num_heads」进行分组,以更充分利用 Tensor Core 的计算能力。

而 binary prefill kernel 则包含了经过精细调优的 softmax 实现。

目前,TokenSpeed MLA 已被 vLLM 采用。

TokenSpeed 性能预览 Coding Agents(编码智能体)带来了异常严苛的推理工作负载,上下文通常会超过 50K tokens,对话也经常跨越数十轮。

大多数公开基准测试并不能充分捕捉这种行为。

研发团队与 EvalScope 团队一起,基于 SWE-smith 轨迹对 TokenSpeed 进行评估,这些轨迹密切反映了生产环境中 Coding Agents 的流量情况。

由于生成速度对 Agent 的用户体验至关重要,因此,团队的目标是在维持单用户 TPS(每秒 token 数)下限的同时,最大化单 GPU 的 TPM(每分钟 token 数)—— 通常是 70 TPS,有时是 200 TPS 或更高。

此外,研发团队针对 TensorRT-LLM(目前 NVIDIA Blackwell 平台上的最高水平)对这一设计进行了基准测试,并在认为针对 Agentic workloads 存在更好权衡的地方,采取了与之不同的设计方案。

下图展示了在不同部署配置下(无 PD 解耦),TokenSpeed 与 TensorRT-LLM 的 Kimi K2.5 性能帕累托曲线(Pareto curves)。

每条曲线都以 TPS/User(横轴)作为延迟指标,以 TPM/GPU(纵轴)作为吞吐指标,并通过扫描并发数绘制而成。

对于 Coding Agents(高于 70 TPS/User),最佳配置是 Attention TP4 + MoE TP4。

在这一配置下,TokenSpeed 在整个帕累托前沿上均优于 TensorRT-LLM:在最低延迟场景下(batch size 1)大约快 9%,在 100 TPS/User 附近吞吐量大约高 11%。

团队表示,他们的核心优化之一是 TokenSpeed MLA。

下图对比了 TokenSpeed MLA 与 TensorRT-LLM 的 MLA,后者是目前 NVIDIA Blackwell 上的 SoTA。

可以看出来,优化后的二进制版本预填充内核(prefill kernel),使用 NVIDIA 内部旋钮来微调 softmax 实现,在 Coding Agents 的五种典型预填充工作负载(带长前缀 KV cache 的 prefill)中,都超过了 TensorRT-LLM 的 MLA。

解码内核则将查询序列轴折叠进头轴,以更好地填充 BMM1 的 M tile,从而提升 Tensor Core 利用率。

结合其他优化,在带有 speculative decoding 的典型解码工作负载中(batch size 为 4、8、16,且带长前缀 KV cache),这使得相对于 TensorRT-LLM 来说,延迟几乎降低了一半。

最后,研发团队也表示,该项目于 2026 年 3 月中旬启动开发,虽然目前展示了惊人的性能,但仍有大量底层代码(如 PD 分离、KV 存储等)正在合并和完善中,接下来将继续推进。

从上述性能表现来看,不难看出,TokenSpeed 的出现旨在通过更现代化的架构设计,打破传统推理框架在易用性与极致性能之间的平衡点,为大规模 Agent 部署提供了一个高性能、开源的底座。

而英伟达的力荐,也说明推理引擎正在成为 Agent 时代基础设施竞争的一个新焦点。

更多信息,请参阅原博客! 参考链接: https://x.com/lightseekorg/status/2052048105412141376 https://x.com/NVIDIAAI/status/2052061195381911806

猜你喜欢

-

广州一“青旅”80平方米房子塞进20多个床位 热点 2026-05-07

广州一“青旅”80平方米房子塞进20多个床位 热点 2026-05-07 -

四川发布新版地震应急预案 明确“Y”字形断裂带风险 热点 2026-05-07

四川发布新版地震应急预案 明确“Y”字形断裂带风险 热点 2026-05-07 -

大连“全李酒店”更名华宇酒店 热点 2026-05-07

大连“全李酒店”更名华宇酒店 热点 2026-05-07 -

两个首富,一起迎来“至暗时刻” 热点 2026-05-07

两个首富,一起迎来“至暗时刻” 热点 2026-05-07 -

河边男子步态诡异,几名学生直接报警! 热点 2026-05-07

河边男子步态诡异,几名学生直接报警! 热点 2026-05-07 -

3d星球动画之木星乱发技能 热点 2026-05-07

3d星球动画之木星乱发技能 热点 2026-05-07 -

3d动画之木星欺负月球 热点 2026-05-07

3d动画之木星欺负月球 热点 2026-05-07 -

广东佛山一丽枫酒店房间内现大量红褐色虫子 专业人士判断系床虱 热点 2026-05-07

广东佛山一丽枫酒店房间内现大量红褐色虫子 专业人士判断系床虱 热点 2026-05-07 -

北斗导航卫星成功发射,竟然引来不明飞行物是真的吗? UFO 2026-05-10

北斗导航卫星成功发射,竟然引来不明飞行物是真的吗? UFO 2026-05-10 -

无人岛上发现的坠毁UFO 到底来自哪里 有解释了吗 UFO 2026-05-10

-

不明飞行物外星生物机密文件谜团?新西兰军方第一次大公开! UFO 2026-05-08

不明飞行物外星生物机密文件谜团?新西兰军方第一次大公开! UFO 2026-05-08 -

数个村庄集体神秘消失?外星人在作祟 UFO 2026-05-08

数个村庄集体神秘消失?外星人在作祟 UFO 2026-05-08