双层旅游火车卧铺国内这辆双层海景火车

【菜科解读】

大理和丽江作为云南的两大王牌旅游城市,每年都吸引了无数游客的到访。

但可能很多人不知道,连接这两座城市之间,有着这样一趟躺在火车上就能看洱海的列车。

可以说是打开了一种史无前例的旅行体验。

这趟大理往返丽江的火车便是:K9621/K9622次列车。

K9621/K9622次列车虽然是“K”字头的绿皮车,但却创造了国内多项“唯一”:

国内唯一一个拥有一人软包的列车;

国内唯一一个拥有酒吧、KTV的列车;

国铁普速列车中最豪华的列车。

尤其是最特别的一人软包,很多人就是冲着它而来的。

一人软包包厢内配备有一个一米五的大床,带一个标准软卧的小床,还有一个可以看到外面的大大的窗户,沿途的苍山、洱海等绝美风景,躺着、趴着都可以让你尽收眼底。

就这样一个独立包厢的票价为328.5元,但购买一张票可以免费再带两个人一起乘坐,等于人均只需100出头就可以,进站时记得要人工通道就行了。

如果只有一个人,觉得一人软包不划算的话也没关系,因为其他类型车票最低只需34元,同样也能收获到惊艳美景。

走上列车后,你可以直接到1号车厢,这里有国内特有的酒吧车厢,整个车厢都弥漫着民族特色和复古感觉。

在这里,你可以喝酒、唱K、甚至是弹钢琴。

总而言之,喜欢安静可以考虑一人软包,喜欢热闹氛围的买张坐票正合适。

因为不管是选择哪种座位,这趟风花雪月的列车沿途的景色都是一样的。

毕竟不管是大理,还是途径的鹤庆,还是丽江,都是大写的诗意。

第一站:大理

大理地处云贵高原与横断山脉的结合部位,层峦叠嶂的苍山、浩淼清碧的洱海,共同组成一幅湖光山色的壮美画卷。

01.景点概况

大理景点以洱海为中心,沿洱海之滨呈环状分布。

以洱海南端的下关镇为起点,顺时针游览,依次可到达苍山、大理古城、崇圣寺三塔、喜洲、蝴蝶泉、双廊、南诏风情岛、小普陀、金梭岛等打卡地。

洱海周边还有不少景美人少的好去处,西部的诺邓古镇、北部的沙溪古镇、东部的鸡足山以及南部的巍山古城都值得前往。

02.最佳旅行时间

大理四季如春,春秋两季,即3-5月、9-11月是大理的最佳旅游时间。

3-5月:温度宜人,白族的很多节日和盛会也集中在此时间段;

9-11月:夏末秋初时,秋色醉人,是摄影爱好者出行的好时机。

03.大理美食

大理主要的特色美食有:白族饵块、云南木瓜水、邓川乳扇、毫糯索、喜洲破酥粑粑、巍山粑肉饵丝、白族三道茶、大理生皮、腌螺蛳、砂锅鱼、弥渡卷蹄、凉鸡米线、大理酸辣鱼等。

04.大理的美食聚集地

大理古城内餐厅、酒吧众多,主要集中在复兴路、护国路等地,都是极具人气的觅食地。

此外,玉洱路、博爱路、人民路也隐藏着众多当地特色美食。

第二站:鹤庆

鹤庆县是云南省大理下属的一个县,是大理州的北大门。

鹤庆山川秀美,被誉为“泉潭之乡”、“鱼米之乡”。

境内旅游资源丰富,有新华村、鹤庆草海、黄龙潭、石宝山、银都水乡。

其中,最著名的当属银都水乡——新华村。

新华村是一个集田园风光、民居、民俗和民族手工艺品生产加工为一体的典型白族聚居村寨。

鹤庆草海是名副其实的高原水乡,由于坝子东西山脚众多潭泉和漾弓江流域水系源源不断,川流不息的来水,在鹤庆坝子形成了水域宽阔的天然草海湿地。

黄龙潭只是一个街心公园,但却美轮美奂,是摄影天堂。

一条水泥板路歪歪斜斜蜿蜿蜒蜒伸向水中,两旁是名副其实的水柳,形态各异。

石宝山为丹霞地貌,球状风化石形成的奇峰异石错落有致。

每年农历七月二十七日至二十九日是石宝山会举行歌会,非常热闹。

银都水乡是依原生态自然村落建成的,处于大理至香格里拉黄金旅游线上,交通便利。

此外,鹤庆的螺峰公园、天华洞、龙华十八寺、云鹤楼、文庙等都是值得一游的景点。

第三站:丽江

丽江,曾是是丝绸之路和茶马古道的中转站,历史非常悠久,因为独特人文和自然景观,成为近国内人气非常高的旅行胜地。

01.景点概况

初次到丽江,很多人都是为了有着小桥流水般秀丽景色的丽江古城而来。

但除了古城,这里还有很多值得游览的地方:神秘的“东方女儿国”泸沽湖,安静闲适的束河古镇,巍峨雄伟的玉龙雪山和山清水秀的拉市海等地。

此外,丽江的蓝月谷、木府、黑龙潭公园、白沙古镇、虎跳峡等都是人气颇高的景点。

02.最佳旅行时间

丽江一年四季皆适宜游览。

不同时间来到丽江都会有不同的收获。

2月可以到拉市海附近的农田看油菜花、到长江第一湾、玉龙雪山游览;

4月是丽江古城和玉龙雪山最美的时候;

5月的丽江,山野间看百花开放,落英缤纷;

9-10月,可以到丽江的田野间看丰收胜景。

03.丽江美食

丽江美食口味偏辣,以纳西菜为主,同时也有云南菜、川菜,食材多以野生山珍、家禽为主。

腊排骨、黑山羊火锅和三文鱼是丽江最出名的美食。

除此之外,还有鸡豆凉粉、纳西烤鱼、粑粑、东巴烤肉、腊排骨、汽锅鸡、水性杨花等美食小吃。

04.丽江的美食聚集地

丽江古城内的四方街、忠义市场、七一街、樱花美食广场和大石桥附近都是小吃集中地。

新城的美食主要聚集在七星街的华都商贸城里,以及新城的象山市场、花马街、金凯广场、黑山羊一条街这几个地方。

除此之外,束河的四方街人气也非常高。

下次旅行如果不知道去哪,

不如就乘坐K9621/K9622次列车,收获一路的风花雪月。

本期就分享到这里,喜欢旅行的小伙伴,欢迎关注!

这群年轻人投身沪剧20年,茅善玉钱思剑等名家为他们助阵

近日,“申声不息——上海沪剧院06级‘崇艺’20年”演出在上海天蟾逸夫舞台圆满举办。本次演出分为5月5日折子戏专场、5月6日主题演出两场,恰逢2026年沪剧入选国家级非物质文化遗产名录20周年,亦是上海沪剧院06级演员从艺20载的重要节点,以一场跨越代际的沪剧传承盛会,为沪上观众献上了兼具情怀与实力的戏曲盛宴。

2006年,沪剧入选首批国家级非物质文化遗产名录,同年上海沪剧院面向全国广觅生源,28位学子通过层层考核汇聚上海戏剧学院附属戏曲学校,与沪剧非遗传承同频开启艺术征程。

20年间,这批演员从开蒙学唱《三国开篇》《西厢开篇》的青涩学子,成长为沪剧舞台的中坚力量,在《回望》《江姐》《罗汉钱》《家·瑞珏》等数十部经典与原创剧目中磨砺蜕变,成为沪剧艺术薪火相传的核心生力军。

本次演出阵容堪称沪剧传承的重磅集结,不仅有06级沪剧班全员登台,更汇聚了韩玉敏、陈瑜、汪华忠、张杏生、王明道、王珊妹、王明达、茅善玉、钱思剑等多位艺术家,他们学生时期的老师们、师哥师姐们、13级优秀青年演员、25级沪剧班新生代学员同台献艺。

非遗传承不是陈列,而是活态的生命,在舞台上呼吸,在生活中生长。

5日的折子戏专场演出中,06级演员们以经典重温从艺初心,演绎了《庵堂相会·看龙舟》《日出·重逢》《画女情·离别》《雷雨·撕支票》《白鹭·碧绿枝叶鲜红花》《女看灯》《家·鸣凤之殇》《露香女·愿君展翅去扬帆》等诸多骨子老戏与经典名段,以沪剧独有的“人间真情”,照见“时代的纹理”。

而6日的代际同台、以戏会友的演绎形式,不仅完成了沪剧艺术薪火相传的接力,更向前辈名家致敬。

从《阿必大回娘家》《大雷雨》等看家戏,到《红灯记》《芦荡火种》等红色经典,再到《敦煌女儿》等新时代原创剧目,经典唱段串联起20年成长之路,师徒同台的动人演绎、集体拜师的温情回溯,更将沪剧口传心授的传承内核展现得淋漓尽致。

20载薪火相传,作为与沪剧国家级非遗传承同起点成长的一届演员,06级沪剧班的成长历程,正是上海沪剧院数十年来坚守人才培养、筑牢非遗传承根基的生动实践。

多年来,上海沪剧院始终坚持“守正创新、以戏育人”的培养理念,构建起“名家传艺、以演代练、梯队接续”的完整人才培养体系。

以经典剧目复排、原创大戏创排、常态化惠民演出为抓手,为青年演员搭建起全方位的成长历练平台,让青年演员在舞台实践中打磨演唱功底、沉淀角色底蕴。

演出现场熟悉的沪韵乡音引得观众数次掌声雷动,有相伴多年的老戏迷动情表示,“看着这批孩子成长至今,20年坚守不易,更让我们看到了沪剧的未来”。

英伟达力荐,小团队两个月开源一款「光速级」智能体推理引擎

机器之心编辑部 智能体时代的核心是算力。尤其是在 Coding Agent 爆发之后,算力问题变得前所未有地尖锐。

Claude Code、Codex、Cursor 等产品正在把 AI 从「问答工具」变成「持续运行的软件协作者」,单次会话轻松突破 50K tokens,系统负载转向了更极端、更复杂的智能体负载。

最近有关算力的大新闻层出不穷。

今天的最新消息:马斯克的 SpaceX 与 Anthropic 宣布达成了重磅协议,超过 22 万块英伟达 GPU 将为 Anthropic 所用。

而 Anthropic 对与 SpaceX 合作开发未来的太空算力体系「表示有兴趣」。

在如此庞大的算力需求下,除了开源还有节流。

也是今天的最新消息:OpenAI 发布了多路径可靠连接 (MRC),可帮助大型 AI 训练集群更快、更可靠地运行,并减少 GPU 时间的浪费。

我们知道,即便只是单 GPU 吞吐率上的微小提升,一旦应用到生产级集群中,也能够在服务持续增长需求的同时,节约相当可观的算力。

来自 LightSeek Foundation 的一个小团队,在两个月时间内打造了一个全新的,号称「光速」的大模型推理引擎 TokenSpeed。

这一引擎拥有 TensorRT LLM 级别的性能,vLLM 级别的易用性。

并且拥有 NVIDIA Blackwell 上最快的 MLA 注意力内核。

一经发布,TokenSpeed 就受到了英伟达发推文力荐。

目前,该引擎已经开源。

让我们参阅其技术博客,来深入了解「光速」引擎的技术细节。

博客标题:TokenSpeed: A Speed-of-Light LLM Inference Engine for Agentic Workloads 博客链接:https://lightseek.org/blog/lightseek-tokenspeed.html Github 链接:https://github.com/lightseekorg/tokenspeed TokenSpeed 技术简介 TokenSpeed 从第一性原理出发,专门为智能体推理场景设计。

它为智能体负载提供接近「光速级」的推理能力,核心包括:基于编译器的并行建模机制、高性能调度器、安全的 KV 资源复用约束、支持异构加速器的可插拔分层 kernel 系统,以及用于低开销 CPU 侧请求入口的 SMG 集成。

建模层采用本地 SPMD(Single Program, Multiple Data,单程序多数据)设计,在性能与易用性之间取得平衡。

TokenSpeed 允许开发者在模块边界指定 I/O placement 注解。

随后,一个轻量级静态编译器会在模型构建过程中自动生成所需的 collective operation,从而无需手动实现通信逻辑。

TokenSpeed 调度器将控制平面(control plane)与执行平面(execution plane)解耦。

控制平面使用 C++ 实现,并被构建为一个有限状态机(FSM),结合类型系统,在编译期而非运行期强制执行安全资源管理,包括 KV cache 状态转移与使用。

请求生命周期、KV cache 资源以及重叠执行时序,都通过显式 FSM 状态迁移与所有权语义进行表示,因此系统正确性并非依赖约定,而是由一个可验证的控制系统来保证。

执行平面则使用 Python 实现,以保持开发效率,使研究人员与工程师能够更快进行功能迭代,并降低整体认知负载。

TokenSpeed 的 kernel 层将 kernel 从核心引擎中解耦,并将其视为一级模块化子系统。

它提供了可移植的公共 API、集中的注册与选择机制、组织良好的实现结构、面向异构加速器的可扩展插件机制、经过整理的依赖体系,以及统一的快速迭代基础设施。

与此同时,团队还针对 NVIDIA Blackwell 架构进行了大量性能优化。

例如,他们构建了当前智能体负载场景下速度最快的 MLA(Multi-head Latent Attention,多头潜在注意力)kernel 之一。

在 decode kernel 中,由于部分场景下「num_heads」较小,团队通过对「q_seqlen」与「num_heads」进行分组,以更充分利用 Tensor Core 的计算能力。

而 binary prefill kernel 则包含了经过精细调优的 softmax 实现。

目前,TokenSpeed MLA 已被 vLLM 采用。

TokenSpeed 性能预览 Coding Agents(编码智能体)带来了异常严苛的推理工作负载,上下文通常会超过 50K tokens,对话也经常跨越数十轮。

大多数公开基准测试并不能充分捕捉这种行为。

研发团队与 EvalScope 团队一起,基于 SWE-smith 轨迹对 TokenSpeed 进行评估,这些轨迹密切反映了生产环境中 Coding Agents 的流量情况。

由于生成速度对 Agent 的用户体验至关重要,因此,团队的目标是在维持单用户 TPS(每秒 token 数)下限的同时,最大化单 GPU 的 TPM(每分钟 token 数)—— 通常是 70 TPS,有时是 200 TPS 或更高。

此外,研发团队针对 TensorRT-LLM(目前 NVIDIA Blackwell 平台上的最高水平)对这一设计进行了基准测试,并在认为针对 Agentic workloads 存在更好权衡的地方,采取了与之不同的设计方案。

下图展示了在不同部署配置下(无 PD 解耦),TokenSpeed 与 TensorRT-LLM 的 Kimi K2.5 性能帕累托曲线(Pareto curves)。

每条曲线都以 TPS/User(横轴)作为延迟指标,以 TPM/GPU(纵轴)作为吞吐指标,并通过扫描并发数绘制而成。

对于 Coding Agents(高于 70 TPS/User),最佳配置是 Attention TP4 + MoE TP4。

在这一配置下,TokenSpeed 在整个帕累托前沿上均优于 TensorRT-LLM:在最低延迟场景下(batch size 1)大约快 9%,在 100 TPS/User 附近吞吐量大约高 11%。

团队表示,他们的核心优化之一是 TokenSpeed MLA。

下图对比了 TokenSpeed MLA 与 TensorRT-LLM 的 MLA,后者是目前 NVIDIA Blackwell 上的 SoTA。

可以看出来,优化后的二进制版本预填充内核(prefill kernel),使用 NVIDIA 内部旋钮来微调 softmax 实现,在 Coding Agents 的五种典型预填充工作负载(带长前缀 KV cache 的 prefill)中,都超过了 TensorRT-LLM 的 MLA。

解码内核则将查询序列轴折叠进头轴,以更好地填充 BMM1 的 M tile,从而提升 Tensor Core 利用率。

结合其他优化,在带有 speculative decoding 的典型解码工作负载中(batch size 为 4、8、16,且带长前缀 KV cache),这使得相对于 TensorRT-LLM 来说,延迟几乎降低了一半。

最后,研发团队也表示,该项目于 2026 年 3 月中旬启动开发,虽然目前展示了惊人的性能,但仍有大量底层代码(如 PD 分离、KV 存储等)正在合并和完善中,接下来将继续推进。

从上述性能表现来看,不难看出,TokenSpeed 的出现旨在通过更现代化的架构设计,打破传统推理框架在易用性与极致性能之间的平衡点,为大规模 Agent 部署提供了一个高性能、开源的底座。

而英伟达的力荐,也说明推理引擎正在成为 Agent 时代基础设施竞争的一个新焦点。

更多信息,请参阅原博客! 参考链接: https://x.com/lightseekorg/status/2052048105412141376 https://x.com/NVIDIAAI/status/2052061195381911806

猜你喜欢

-

“4只皮皮虾1035元”最新进展:当事人称已接到最新回复“市监局说价格没问题” 热点 2026-05-07

“4只皮皮虾1035元”最新进展:当事人称已接到最新回复“市监局说价格没问题” 热点 2026-05-07 -

广州一“青旅”80平方米房子塞进20多个床位 热点 2026-05-07

广州一“青旅”80平方米房子塞进20多个床位 热点 2026-05-07 -

四川发布新版地震应急预案 明确“Y”字形断裂带风险 热点 2026-05-07

四川发布新版地震应急预案 明确“Y”字形断裂带风险 热点 2026-05-07 -

大连“全李酒店”更名华宇酒店 热点 2026-05-07

大连“全李酒店”更名华宇酒店 热点 2026-05-07 -

两个首富,一起迎来“至暗时刻” 热点 2026-05-07

两个首富,一起迎来“至暗时刻” 热点 2026-05-07 -

河边男子步态诡异,几名学生直接报警! 热点 2026-05-07

河边男子步态诡异,几名学生直接报警! 热点 2026-05-07 -

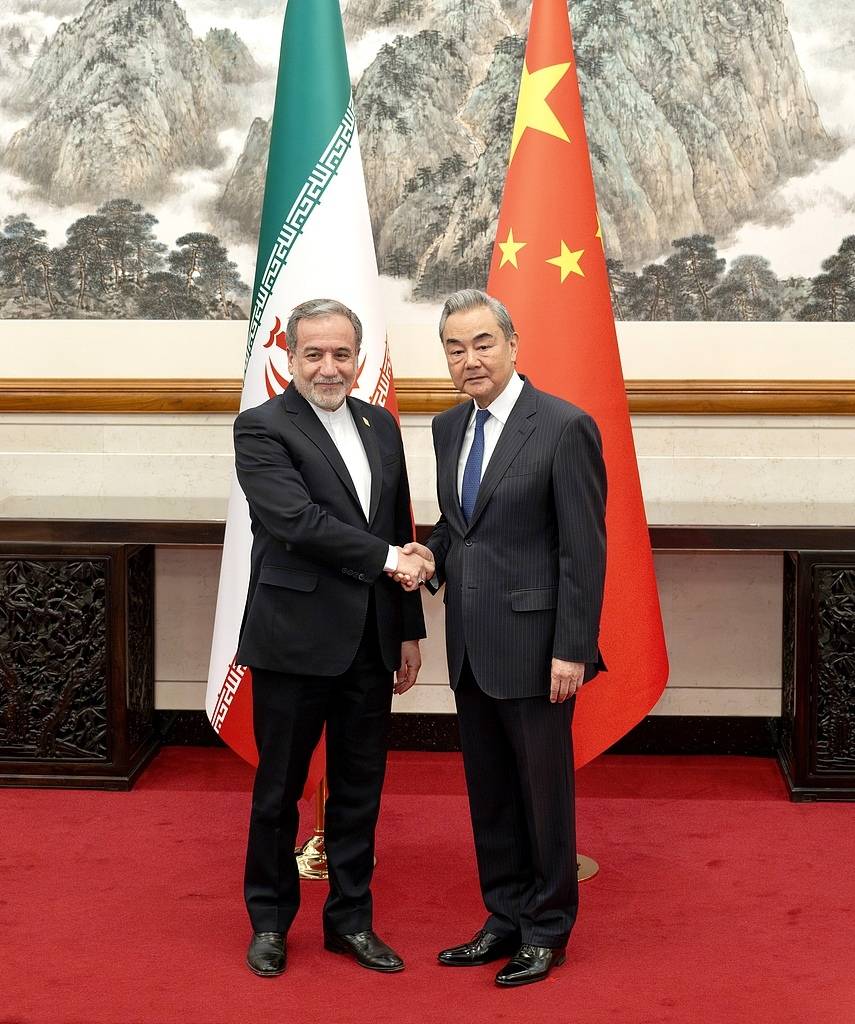

快评|伊朗外长到访中国,伊朗战事有可能很快结束吗? 热点 2026-05-07

快评|伊朗外长到访中国,伊朗战事有可能很快结束吗? 热点 2026-05-07 -

五一假期 金石滩度假区接待游客超50万人 热点 2026-05-07

五一假期 金石滩度假区接待游客超50万人 热点 2026-05-07 -

长沙270路公交车路线 城市中国 2026-05-04

长沙270路公交车路线 城市中国 2026-05-04 -

东莞最美十大夜景排名:虎门大桥上榜,第一是东莞运河 城市中国 2026-04-30

东莞最美十大夜景排名:虎门大桥上榜,第一是东莞运河 城市中国 2026-04-30 -

喀什到塔县的旅游攻略图 城市中国 2026-04-30

喀什到塔县的旅游攻略图 城市中国 2026-04-30 -

西宁65路公交车路线时间表路线图 城市中国 2026-04-30

西宁65路公交车路线时间表路线图 城市中国 2026-04-30