手机发烫关闭三个功能详解:有效降温小技巧

合理管理手机资源,不仅延长设备使用寿命,还提高使用体验,是智能控温的关键步骤。

【菜科解读】

在炎热的夏季或是玩大型游戏等高负荷状态下,智能手机容易出现发烫现象,这不仅会影响用户体验,还可能对设备的寿命造成影响。

为了帮助用户在手机发烫的时候采取有效措施,我们将详细介绍如何通过关闭手机上的三个功能来实现快速降温的方法,并提供一些实用的小技巧。

工具原料:

系统版本:iOS 16,Android 13

品牌型号:iPhone 14,Samsung Galaxy S23,Google Pixel 7

软件版本:对应最新软件更新版本

一、关闭后台应用程序

1、当手机发烫时,首先检查是否有大量后台应用程序在运行。

后台应用程序不仅会耗电,还会占用大量的处理器资源,从而导致设备发热。

对于iOS设备,可以通过双击Home键或上滑与暂停,通过任务管理器关闭不必要的后台程序。

Android用户则可以通过“设置”进入“应用管理”界面来结束不必要的应用进程。

2、实际案例:以iPhone 14为例,当设备温度过高时,先尝试清理后台运行的诸如地图、社交媒体等高耗能应用。

一位用户报告在清理后台应用程序后,设备温度显著下降,并恢复到正常使用状态。

二、关闭蓝牙、GPS与Wi-Fi功能

1、无线连接功能,如蓝牙、GPS和Wi-Fi,会在无意中耗费大量电量并增加处理器负荷。

尤其是在不需要这些功能的时候,保持它们开启状态会加剧手机发热。

因此,适时关闭这些功能可以有效缓解温度上升。

用户可以在快捷设置菜单中快速关闭这些选项。

对于Android用户,可通过下拉菜单的快捷设置关闭;

iOS用户则可以通过“控制中心”进行。

2、实际用例:某Galaxy S23用户在进行长时间的音乐播放和导航后,手机明显发热,通过暂时关闭蓝牙和GPS功能,设备温度迅速恢复正常,大幅度提高了手机性能的稳定性。

三、调节屏幕亮度与刷新率

1、屏幕亮度是影响手机发热的重要因素之一,尤其在高亮度环境下,屏幕越亮,设备发热越严重。

用户可以通过调整屏幕亮度到适中水平来减少发热。

此外,许多现代手机配备了高刷新率屏幕(比如120Hz),虽然这提升了显示效果,但也加剧了能耗和发热。

切换到60Hz或适度降低刷新率也有助于控制设备温度。

2、实际场景:在Google Pixel 7上进行高强度应用时,如果设备发热严重,可以先降低屏幕亮度并调整屏幕刷新率至60Hz,通过该方法,有效避免了设备因过热而引起的性能衰减。

拓展知识:

1、减少充电时的使用。

充电是手机发热的另一主要因素。

在充电时尽量不使用手机,特别是避免运行大型游戏和高负载应用,可以显著减少发热。

某些手机品牌也提供智能充电管理功能,可以在后台自动控制充电速度,以减缓发热。

2、使用原厂充电器。

非原厂或劣质的充电器可能会导致手机过热甚至损坏,因此建议选择原厂充电器以确保安全和效能。

3、检查电池和软件更新。

老化的电池也会导致手机发热问题,定期检查手机电池健康状况,并根据需要进行更换。

同时,保持手机软件版本最新,可以确保系统对功耗及温度的优化。

手机发烫关闭三个功能,专家教你轻松降温,延长电池寿命

在日常使用手机的过程中,很多人都会遇到手机发烫的问题。

手机发烫不仅会影响使用体验,还可能缩短电池寿命。

今天,我们将介绍关闭三个功能的方法,帮助你轻松降温,延长电池寿命。

本文适用于科技爱好者和电脑手机小白用户,旨在提供实用的建议和使用方法指南。

工具原料:系统版本:Android 12、iOS 15品牌型号:Samsung Galaxy S21、iPhone 13软件版本:最新系统更新一、关闭后台应用刷新1、后台应用刷新是指应用在后台运行时,仍然可以获取数据和更新内容。

这一功能虽然方便,但会消耗大量的电量和处理器资源,导致手机发烫。

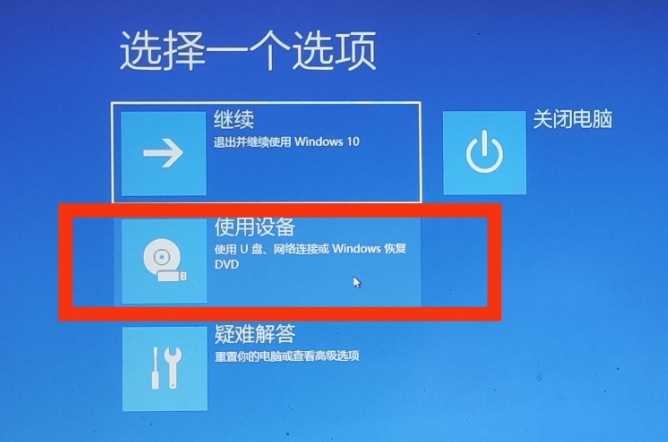

2、在Android设备上,关闭后台应用刷新的方法如下:(1)打开“设置”应用。

(2)选择“应用和通知”。

(3)点击“应用信息”,然后选择需要关闭后台刷新功能的应用。

(4)点击“电池”,然后选择“后台限制”。

3、在iOS设备上,关闭后台应用刷新的方法如下:(1)打开“设置”应用。

(2)选择“通用”。

(3)点击“后台应用刷新”,然后选择“关闭”或仅在Wi-Fi下刷新。

二、关闭高性能模式1、高性能模式是一些手机品牌提供的功能,旨在提升设备的性能表现。

然而,这一模式会增加处理器的工作负荷,导致手机发烫。

2、在Samsung Galaxy S21上,关闭高性能模式的方法如下:(1)打开“设置”应用。

(2)选择“设备维护”。

(3)点击“电池”,然后选择“电池模式”。

(4)选择“优化”或“中等性能”模式。

3、在iPhone 13上,虽然没有明确的高性能模式,但可以通过以下方法降低性能需求:(1)打开“设置”应用。

(2)选择“电池”。

(3)点击“低电量模式”,以减少后台活动和视觉效果。

三、关闭位置服务1、位置服务是指应用通过GPS、Wi-Fi和移动网络获取设备位置。

这一功能在导航和定位应用中非常重要,但会消耗大量电量和处理器资源,导致手机发烫。

2、在Android设备上,关闭位置服务的方法如下:(1)打开“设置”应用。

(2)选择“位置”。

(3)点击“使用位置服务的应用”,然后选择需要关闭位置服务的应用。

(4)关闭“位置访问”开关。

3、在iOS设备上,关闭位置服务的方法如下:(1)打开“设置”应用。

(2)选择“隐私”。

(3)点击“定位服务”,然后选择需要关闭位置服务的应用。

(4)关闭“位置访问”开关。

内容延伸:1、除了关闭上述三个功能外,还有一些其他方法可以帮助手机降温和延长电池寿命。

例如,定期清理手机缓存、避免长时间玩大型游戏、使用原装充电器等。

2、了解手机发烫的原因也很重要。

手机发烫通常是由于处理器过载、电池老化或环境温度过高等原因引起的。

通过了解这些原因,可以更好地采取相应的措施。

3、科技发展历史上,手机电池技术经历了多次革新。

从早期的镍镉电池到现在的锂离子电池,电池技术的进步极大地提升了手机的续航能力。

然而,电池寿命仍然是一个需要关注的问题。

通过合理使用手机,可以延长电池的使用寿命。

4、在未来,随着科技的不断进步,可能会出现更加高效的电池技术和散热解决方案。

例如,石墨烯电池和液冷散热技术等。

这些新技术有望进一步提升手机的性能和用户体验。

始皇陵藏惊天秘密,陵顶石榴树竟能看出地下水银总量

西安骊山北麓,秦始皇陵矗立两千余年,《史记》记载地宫以水银为江河大海,是史实还是夸张?答案,藏在封土堆顶的石榴树里。这些树长得矮小、果实畸形、含剧毒汞,恰恰印证地下藏着海量水银。

今天就扒一扒:始皇陵到底浇灌了多少水银?石榴树又藏着哪些秘密?史书记载:水银为百川江河大海司马迁在《史记・秦始皇本纪》明确写道:“以水银为百川江河大海,机相灌输,上具天文,下具地理。

”意思是,地宫用水银模拟天下江河,机械驱动循环流动,顶部绘星空、底部仿地貌,复刻整个大秦疆域。

两千年来,这段文字常被质疑是文学夸张 —— 要形成 “江河大海”,得多少水银?秦朝生产力能办到吗?科学实锤:12000㎡强汞异常区真相,在 1981 年揭开。

中国地质调查局用汞量测量技术探测封土堆,结果震惊学界:封土堆存在约 12000 平方米强汞异常区,汞含量远超正常土壤几十倍;

分布呈东南强、西北弱,完美对应秦代渤海、黄海方位,与《史记》描述完全吻合;

2002 年复测确认:汞来自地宫挥发,非土壤天然富集。

这直接证明:地宫水银真实存在,且规模巨大。

山顶石榴树:水银量的 “活标尺”最直观的证据,是封土堆上的石榴树。

反常生长:矮小、畸形、不结果普通石榴树高 3-7 米、枝干粗壮、果实饱满;

但始皇陵顶的石榴树仅 1-2 米高、枝叶稀疏、叶片发黄、果实瘦小畸形。

化验惊人:汞含量超标百倍专家采样检测发现:树根、叶片汞含量平均 205ppb,最高 1440ppb(比正常值高数十倍);

果实汞含量严重超标百倍,是名副其实的 “毒石榴”,绝对不能吃。

原理:汞蒸气渗透,植物 “中毒”地宫水银持续挥发,汞蒸气沿土壤裂隙向上渗透,被石榴树根系吸收,干扰生长、积累毒素。

简单说:石榴树的 “病态”,就是地下水银海量且持续挥发的铁证。

重磅数据:地宫到底有多少水银?结合汞异常区面积、土壤汞浓度、地宫空间,专家推算:保守估算:100 吨(水银层仅 1 厘米厚,就需约 100 吨);

合理区间:100-150 吨(符合秦朝生产力,需约 115 吨丹砂提炼);

排除 “千吨” 夸张说法:地宫面积仅约 4000㎡,根本容纳不下千吨液体。

100 吨水银是什么概念?相当于20 万瓶 500ml 水银;

能覆盖整个地宫(约 4000㎡)2.5 厘米深;

两千多年持续挥发,仍能让山顶植物 “中毒”,可见储量之恐怖。

秦始皇为何灌海量水银?防盗:汞蒸气剧毒,能毒死盗墓者,两千年来护陵墓周全;

防腐:水银杀菌防腐,保护地宫与陪葬品不朽;

象征:以水银复刻江河大海,彰显皇权至高无上,死后仍掌天下;

长生:古人认为水银与长生相关,助其灵魂不朽。

结语始皇陵地宫100 吨 + 水银,不是传说,是被史书、科学探测、山顶石榴树三重印证的史实。

那些矮小畸形、含剧毒的石榴树,默默守护两千余年,用自身 “病态”,揭开了秦始皇陵最神秘的面纱。

猜你喜欢