怎么安装deepseek到手机?

如何安

【菜科解读】

如何安装deepseek到手机_电子琴架怎么按装呢?最近引发大家的关注,相信大家都想知道这件事会有怎么样的发展?下面就让小编为大家介绍一下,一起来看看吧。

如何安装deepseek到手机

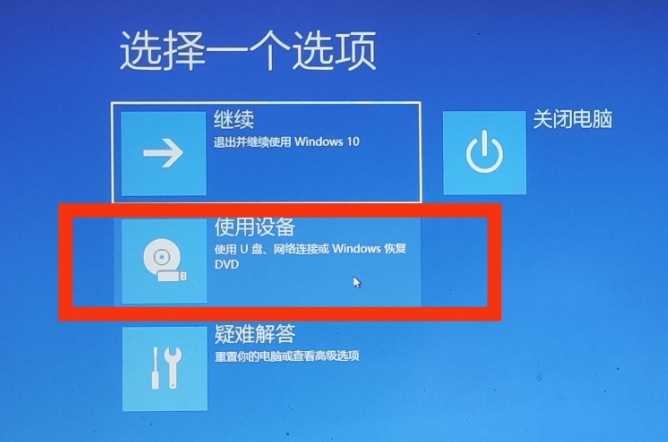

要在手机上安装DeepSeek,您可以按照以下步骤操作:

### 安卓系统

1. **通过应用商店安装**:

- 打开您的安卓应用商店(如华为应用商店、小米应用商店等)。

- 在搜索框中输入“DeepSeek”。

- 找到DeepSeek应用后,点击“下载”按钮。

- 按照应用商店的提示,完成安装过程。

2. **从官方网站下载安装包**:

- 访问DeepSeek的官方网站,下载适合您手机系统的安装包。

- 安装下载好的APK文件,按照提示完成安装。

### iOS系统

1. **通过App Store安装**:

- 打开App Store。

- 在搜索框中输入“DeepSeek”。

- 找到DeepSeek应用后,点击“获取”或“下载”按钮。

- 按照App Store的提示,完成安装过程。

### 命令行方式安装(适用于有一定技术基础的用户)

如果您希望通过命令行方式安装DeepSeek,可以按照以下步骤操作:

1. **准备环境**:

- 安卓用户请在应用商店搜索并下载Termux,iOS用户则在App Store下载iSH Shell。

2. **下载和准备模型**:

- 从DeepSeek的官方网站下载适合手机运行的轻量版DeepSeek模型。

- 将下载好的DeepSeek模型传到手机,并放到一个文件夹里。

3. **安装依赖库**:

- 打开Termux/iSH Shell,输入命令安装Python和相关依赖库。

例如:

```bash

pkg install python

pip install -r requirements.txt

```

4. **运行模型**:

- 切换到模型所在的目录,并运行模型。

例如:

```bash

cd /path/to/deepseek

python run.py

```

5. **访问AI功能**:

- 打开手机浏览器,输入`localhost:5000`(端口号根据模型设置调整),即可访问DeepSeek的AI功能。

### 注意事项

- 在安装前,请确保您下载的是与手机系统兼容的DeepSeek版本。

- 在安装过程中,可能需要授予DeepSeek某些权限(如访问存储、使用摄像头等)。

请按照提示进行授权,以确保DeepSeek的正常运行。

- 为了获得最佳的使用体验,请定期检查并更新DeepSeek应用,并保持手机系统的更新以确保应用的兼容性

DeepSeek加入多模态功能,小鲸鱼终于能看到东西了

4月29日,DeepSeek的核心多模态技术负责人陈小康在X上发了一张图片,右边是DeepSeek的图标,左边是鲸鱼的眼睛上被戴了一个眼罩。并配文,“现在我们看见你了。

” 并且他还在随后回复说,已经有些网页端和APP端用户能使用多模态功能了。

随后有网友分享链接,他在和DeepSeek的对话中插入图片,DeepSeek可以精准地识别图中的元素,包括人物、背景、动作、颜色。

虽然不能从链接中查看图片,但是能看到文件的类型是PNG图片。

截至目前,DeepSeek尚未在官网、Hugging Face或GitHub发布新的多模态模型权重、技术报告或正式公告。

值得注意的是,陈小康昨日曾发布同一张图片,配文为"马上我们就能看到你",该帖今日已被删除。

刚刚,直线猛拉!DeepSeek V4正式发布

【导读】它来了! 中国基金报记者 泰勒 千呼万唤始出来,就在刚刚,DeepSeek正式发布并开源全新系列模型DeepSeek-V4,分为Pro和Flash两个版本。在一年前震动硅谷之后,这次带来了其迄今为止最大的一次升级。

DeepSeek发布V4版本 4月24日,DeepSeek全新系列模型DeepSeek-V4的预览版本正式上线并同步开源。

据介绍,DeepSeek-V4拥有百万字超长上下文,在Agent能力、世界知识和推理性能上均实现国内与开源领域的领先。

模型按大小分为两个版本。

即日起登录官网或官方App,即可与DeepSeek-V4对话,API服务也已同步更新。

以下是新版本的重点内容: 1.DeepSeek-V4-Pro:性能比肩顶级闭源模型 相比前代模型,DeepSeek-V4-Pro的Agent能力显著增强。

在Agentic Coding评测中,V4-Pro已达到当前开源模型最佳水平,并在其他Agent相关评测中同样表现优异。

目前DeepSeek-V4已成为公司内部员工使用的Agentic Coding模型,据评测反馈使用体验优于Sonnet 4.5,交付质量接近Opus 4.6非思考模式,但仍与Opus 4.6思考模式存在一定差距。

DeepSeek-V4-Pro在世界知识测评中,大幅领先其他开源模型,仅稍逊于顶尖闭源模型Gemini-Pro-3.1。

在数学、STEM、竞赛型代码的测评中,DeepSeek-V4-Pro超越当前所有已公开评测的开源模型,取得了比肩世界顶级闭源模型的优异成绩。

2.大幅降低了对计算和显存的需求 DeepSeek-V4开创了一种全新的注意力机制,在token维度进行压缩,结合DSA稀疏注意力(DeepSeek Sparse Attention),实现了全球领先的长上下文能力,并且相比于传统方法大幅降低了对计算和显存的需求。

从现在开始,1M(一百万)上下文将是DeepSeek所有官方服务的标配。

3.Agent 能力专项优化 DeepSeek-V4针对Claude Code、OpenClaw、OpenCode、CodeBuddy 等主流的Agent产品进行了适配和优化,在代码任务、文档生成任务等方面表现均有提升。

DeepSeek融资进行中 据多家媒体报道, DeepSeek近日 启动首轮融资, 正与少数战略投资者接触,可能把估值推高至200亿美元以上。

知情人士称,DeepSeek的自由现金流确实不如一些体量更大的竞争对手充裕,但公司眼下并没有迫切的大额外部融资需求。

因此,这轮融资的核心其实是稳定研究团队。

过去一年,一些竞争对手估值快速上升,DeepSeek已有部分研究人员离职投向对方。

在AI行业,股票期权通常是研究人员薪酬的重要组成部分,很多时候甚至占到大头。

目前谈判仍存在较大不确定性,最终是否达成交易以及具体估值仍未可知。

2025年1月,DeepSeek发布了一款具有突破性的模型,其性能可与美国竞争对手相媲美,震动了整个AI行业。

市场反应 DeepSeek消息出来之后,市场反应较为剧烈。

国产芯片直线猛拉,寒武纪直线大涨。

消息面上,寒武纪已基于vLLM推理框架完成对DeepSeek全新版本的Day 0适配,适配代码已开源到GitHub社区。

这一成果得益于寒武纪长期积累的自研NeuWare软件生态与芯片设计技术,也是寒武纪对芯片与算法联合创新持续投入的延续。

而DeepSeek的竞争对手——智谱、Minimax在V4发布后跌势扩大,分别跌6.8%和3.9%。

编辑:张玲 校对:乔伊 制作:嘉颖 审核:许闻

猜你喜欢

-

DeepSeek-V4上线:使用华为芯片训练,性能比Gemini差3-6个月,价格优势明显 热点 2026-04-24

DeepSeek-V4上线:使用华为芯片训练,性能比Gemini差3-6个月,价格优势明显 热点 2026-04-24 -

DeepSeek V4正式发布,API启用Lite版,性能对标Opus 4.5 热点 2026-04-22

DeepSeek V4正式发布,API启用Lite版,性能对标Opus 4.5 热点 2026-04-22 -

DeepSeek V4发布在即?张一帆社交动态引爆业界预测 热点 2026-04-20

DeepSeek V4发布在即?张一帆社交动态引爆业界预测 热点 2026-04-20 -

DeepSeek V4临近发布:Mega MoE架构加持,参数或达1.6万亿 热点 2026-04-19

DeepSeek V4临近发布:Mega MoE架构加持,参数或达1.6万亿 热点 2026-04-19 -

DeepSeek V4临近发布?DeepGEMM升级暗藏万亿参数与Mega MoE技术突破 热点 2026-04-19

DeepSeek V4临近发布?DeepGEMM升级暗藏万亿参数与Mega MoE技术突破 热点 2026-04-19 -

谷歌新论文把内存股价干崩了!KV cache压缩6倍,“谷歌的DeepSeek时刻” 热点 2026-03-26

谷歌新论文把内存股价干崩了!KV cache压缩6倍,“谷歌的DeepSeek时刻” 热点 2026-03-26 -

DeepSeekr1版本和v3版本有什么分别?DeepSeekr1版本和v3版本的重要分别介绍 手机软件 2026-04-15

DeepSeekr1版本和v3版本有什么分别?DeepSeekr1版本和v3版本的重要分别介绍 手机软件 2026-04-15 -

DeepSeek怎么批改作文?DeepSeek批改作业最简单三个步骤 手机软件 2026-04-15

DeepSeek怎么批改作文?DeepSeek批改作业最简单三个步骤 手机软件 2026-04-15 -

杜蕾斯air和超薄套区别杜蕾斯air空气套和超薄套哪个好 AI 2026-04-25

杜蕾斯air和超薄套区别杜蕾斯air空气套和超薄套哪个好 AI 2026-04-25 -

Deepswap在线?AI?换脸,轻松生成换脸视频、照片! AI 2026-04-11

Deepswap在线?AI?换脸,轻松生成换脸视频、照片! AI 2026-04-11 -

怎么使用deepseek写材料 AI 2026-04-11

怎么使用deepseek写材料 AI 2026-04-11 -

玩转Deepseek必备的100个话术指令 AI 2026-04-11

玩转Deepseek必备的100个话术指令 AI 2026-04-11