因为一只苍蝇引发的血案?杀人狂魔疯狂屠戮56人!

1982年4月26日,禹范坤的同居女友,

【菜科解读】

怒杀了56个人,起因只为一只苍蝇?听起来实在匪夷所思,这名韩国人名叫禹范坤,是名韩国警察,也是韩国史上最可怕的疯狂杀手。1982年4月26日,禹范坤的同居女友,因为拍打了停在他胸口的苍蝇,而把他吵醒,禹范坤醒来后,跟女友大吵一架,回到他工作的警局。

3个小时后,禹范坤返家,在暴打女友一顿之后,再次返回警局,到武器室拿了2支卡宾枪、180发实弹和7枚手榴弹。

图为禹范坤当时所使用的凶器。

之后禹范坤杀了3名邮局的接线生、切断电话线,让讯息传不出去。

又挟持了一名18岁的青年去杂货店,开始大开杀戒,一口气杀害18人后,他又走到下一个村庄。

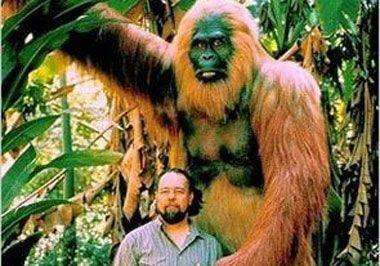

图为禹范坤从警局武器室拿了大量武器。

村里有人见他拿着那么多武器,就开玩笑说他的武器看起来不像真的。

他于是在这个村庄总共杀了24人。

图为装被害者的箱子。

最后在警力包围后,禹范坤引爆两个手榴弹,跟被他挟持的3名人质同归于尽。

图为悲惨的杀戮现场。

8小时内共被杀害了55人,再加上禹范坤天自己的死,还有36人轻伤、6人重伤,其中一名重伤孩童,在一周后身亡,总共有56人因他而死 。

图为被害者举行丧事。

而这一切的引爆点,竟然只是因为一只苍蝇?实在是太匪夷所思了,希望这样的事件永远不要再发生!图为当年的媒体报道。

木星顶端大气层高温之谜 可能因为大红斑

野生袋獾濒临灭绝 身形跟一只小狗差不多

十多年来,野生袋獾由于受到一种名为面部肿瘤的疾病困扰,数量锐减70%至90%。动物学界迄今未掌握这种疾病的病理和治疗方法。

关于面部肿瘤的最早记录始于1996年,这种疾病传染性较强,感染对象仅限于袋獾。

他说,袋獾好打斗的生活习性,以及近亲交配导致的遗传多样性不足等因素,均加剧疫情扩散,给野生种群造成致命威胁。

一些专家预计,如果疫情得不到控制,野生袋獾在今后15年到20年内可能灭绝。

为此,塔朗加动物园计划繁殖1500头袋獾,并防止驯养袋獾近亲交配。

目前,澳大利亚塔斯马尼亚大学和墨尔本大学等机构的科研人员正加紧研究针对袋獾面部肿瘤的有效疗法,努力使袋獾种群免遭灭顶之灾。

袋獾是袋獾属中唯一未灭绝的成员,身形与一只小狗差不多,但肌肉发达,十分壮硕。

其特征包括:黑色的皮毛、遭遇攻击时发出的臭味、刺耳的叫声,以及进食时的神态。

除狩猎外,袋獾也进食腐肉。

它们通常单独行动,但有时也与其他袋獾一起进食。

猜你喜欢