人类唯一目睹的宇宙事件是怎么回事?1994彗木相撞?威力超20亿颗原子弹?

这颗彗星被美国天文学家尤金和卡罗琳 苏梅克夫妇发现,并被命名为SL9。

然而,由于这颗彗星与木星距离过近

【菜科解读】

1994年,一个彗星与木星相撞的事件引起了人们的广泛关注。

这颗彗星被美国天文学家尤金和卡罗琳 苏梅克夫妇发现,并被命名为SL9。

然而,由于这颗彗星与木星距离过近,很快就被木星的引力撕裂成了21块碎片,并且这些碎片不久后将坠入木星,这颗太阳系中质量和体积最大的行星。

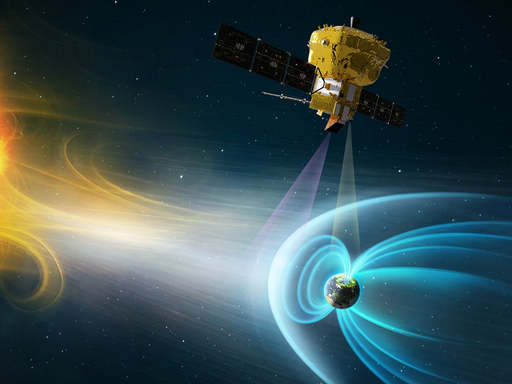

由于这是人类第一次亲眼目睹天体撞击事件,NASA等各国天文机构都组织了大规模的观测活动。

除了地面天文台外,近地轨道上的哈勃望远镜和正在前往木星的伽利略号探测器也参与了观测工作。

甚至连旅行者1号,距离木星60亿公里的航天器,也收到了地面控制中心的指令,利用自身携带的行星射电观测装置分析并记录撞击时的电磁情况。

一、彗木相撞

从1994年7月17日的凌晨4点15分到22日的早上8点12分,SL9的21块碎片相继撞击了木星。

其中,编号为G的碎片的威力达到了6万亿吨TNT当量,相当于人类核武库总当量的600倍。

与之相比,人类制造的最大威力氢弹 前苏联的沙皇氢弹,当量仅为5500万吨。

可见,即使是SL9中最小的碎片,其威力也超过了人类制造的任何核武器。

假设这些彗星碎片是小行星,而不是撞击了木星,那么如果人类的热核武器在太空中击中这些小行星,核弹的能量将以光和热的形式释放,直接蒸发这些来自宇宙深处的不速之客。

但是,如果在彗星进入地球之后才发射核武器来进行防御,情况就会完全不同了。

因为核弹在大气层内爆炸会产生剧烈的冲击波,被击碎的彗星碎片反而会造成更大的危害。

即使是在6500万年前,当一颗直径为10公里的小行星撞击地球时,地球上的生命也没有完全绝种。

如今,地球上已经出现了人类文明,无论是已经消失在木星云层中的SL1,还是未来可能出现的其他 威胁天体 ,都不足为惧。

科技一直在进步,人类也拥有更多的手段来应对撞击事件。

二、可能的撞击后果和对策

1.爆炸和冲击波:一颗大体积彗星的撞击将释放出巨大的能量,产生强力的冲击波。

这可能导致地震、火山喷发和大规模的洪水等自然灾害。

为减轻这种影响,可以采取措施增强地质结构的稳定性,加强建筑物和基础设施的抗震能力。

2.火灾和气候变化:彗星撞击会引发大规模的火灾,释放出大量的烟尘和气体,导致气候变化。

这可能造成全球性的寒冷和干旱,对农作物和生态系统造成严重影响。

为了应对这种情况,可以加强防火措施,并采取措施减少火灾产生的烟尘和气体。

3.海啸和洪水:彗星撞击地球的海洋将引发巨大的海啸,对沿海地区造成严重破坏。

此外,撞击还可能导致河流溢出和洪水。

为了减轻这些影响,可以建造防洪堤和海岸保护设施,并制定有效的紧急撤离计划。

4.生物多样性的丧失:彗星撞击可能导致生物多样性的丧失,包括陆地和海洋生态系统的破坏,物种灭绝和生态平衡的破坏。

为保护生物多样性,可以加强野生动植物保护措施,保护关键物种和栖息地。

5.灾后恢复和重建:一旦发生彗星撞击,灾后恢复和重建工作将是一项艰巨的任务。

需要组织国际合作,提供人道援助和资源支持,重建基础设施,恢复社会秩序,并帮助受灾地区重新建立起可持续的生活和经济系统。

虽然彗星撞击地球可能会带来巨大的破坏和灾难,但人类已经积累了丰富的科学知识和技术手段,可以预测和应对这样的事件。

国际组织和科学界正在致力于监测和研究潜在的威胁天体,并开发相应的应对策略。

通过合作和努力,我们可以增加地球的安全性,并减轻任何未来撞击事件可能带来的损失。

宇宙真实年龄是多少岁

按目前主流观测和标准宇宙模型(ΛCDM),宇宙的真实年龄大约是:137.97 0.02 亿年,约等于 138 亿年。主要数据来源普朗克卫星(2013–2021)测宇宙微波背景辐射(CMB),给出:137.97 亿年(138.2 亿年)。

近年(2025)CMB 高精度测量(ACT 等)精度提高到约 0.1%,结果仍确认:138 亿年。

交叉检验最老恒星年龄:126–130 亿年(比宇宙年轻,符合逻辑)。

放射性元素衰变、高红移星系年龄(如 MoM-z14 形成于宇宙约 2.8 亿岁时)均与 138 亿年一致。

简单说教科书 / 标准答案:138 亿年更精确值:137.97 亿年所有数据都建立在大爆炸 +ΛCDM 标准模型上;

如果未来有全新模型(比如有人提出宇宙可能更老,如 300 多亿年),那还需要更多证据才能取代现在的结论。

吞噬一切的宇宙深渊,黑洞引力藏着光速禁区

在浩瀚无垠的宇宙当中,黑洞是最神秘也最令人敬畏的天体。它拥有世间顶尖的引力束缚力,独特的视界边界划分出截然不同的时空领域,只要踏入视界范围之内,就连每秒三十万公里的光速,都没办法挣脱引力拉扯向外逃离。

今天就用闲聊述说的口吻,聊聊黑洞引力的奇特特性,讲讲视界的划分意义,理清为何光速都无法从黑洞内部脱身,一同揭开这片宇宙禁区的神秘面纱。

宇宙天体的引力强弱,一直和自身质量、密度牢牢挂钩。

普通恒星、行星的引力,只能束缚周边卫星与星际物质,物体只要达到对应速度,就能摆脱引力飞向深空。

而黑洞诞生于大质量天体的末期演化,巨型恒星燃料耗尽后,再也无法支撑自身庞大躯体,核心在自身重压下急剧向内坍缩,体积被无限压缩,密度飙升到难以想象的地步。

极致致密的结构,催生出碾压所有常规天体的超强引力,这也让黑洞拥有了独一无二的宇宙统治力。

从黑洞形成的那一刻开始,它就注定成为宇宙里特殊的存在,和我们熟知的星体运转规律彻底区分开来。

围绕黑洞存在一层无形的边界,这便是人们常说的事件视界。

它没有实体外壳,肉眼无法直接看见,却是一道无法逾越的分界线。

视界之外的宇宙空间,依旧遵循常规物理规则,光线、星体、宇宙尘埃都能自由穿梭,天体也可以依靠运动速度远离黑洞影响范围。

一旦物质、光线跨越这条无形界线,彻底进入视界内部,一切都会发生颠覆性改变。

黑洞恐怖的引力会牢牢锁定内部所有存在,再也没有力量能够带着物质脱离这片区域。

衡量天体引力束缚能力,有一个关键参照标准就是逃逸速度,也就是物体摆脱天体引力束缚,飞向宇宙远方需要具备的最低速度。

地球有着自身对应的逃逸速度,火箭突破临界数值便能冲出大气层奔向太空,太阳系里的各大行星、恒星,都有着各自固定的逃逸速度门槛。

黑洞打破了常规天体的速度极限,视界内部的逃逸速度直接超越光速。

光速是目前人类认知里宇宙最快运动速度,连光线本身都没办法积攒足够速度冲破引力牢笼,其他星体、星际物质自然更没有脱身的可能。

光线坠入黑洞视界后,无法向外反射、传播,我们没办法捕捉到黑洞自身散发的光亮,这也是黑洞漆黑一片、难以直接观测的根本原因。

任何闯入视界之内的物质,不管是庞大的恒星残骸,还是细碎的气体尘埃,都会被强大引力不断拉扯撕扯,最终向着黑洞中心奇点不断坠落,彻底消融在这片深渊之中。

超强引力不止禁锢视界内部的一切,也会剧烈扭曲周边时空。

靠近黑洞的星体运行轨迹会被强行弯折,光线途经周边空间也会发生明显偏转。

不少遥远天体发出的光芒,在奔赴地球的途中靠近黑洞区域,都会被引力改变行进路线,这也给天文观测带来了奇妙的视觉效果。

科研人员依靠光线弯折、天体异常运动等间接痕迹,一步步推算黑洞位置,测算它的质量与引力强度。

时至今日,人类依旧没办法近距离抵达黑洞视界实地探查,视界内部的时空结构、物质形态,还留存着大量未解谜题。

光速无法逃逸的特性,让黑洞成为宇宙天然的隔绝领域,里面的一切变化都无法向外传递信息。

黑洞凭借极致强大的引力,划定出超越光速束缚的视界禁区,成为宇宙中最神秘的深渊天体。

这份打破常规物理认知的特质,不断吸引着人类探索研究,随着天文观测技术持续进步,未来我们也会慢慢解锁更多黑洞隐藏的宇宙奥秘。

猜你喜欢