谷歌地球手机版-随时随地探索世界,掌上畅游天下

【菜科解读】

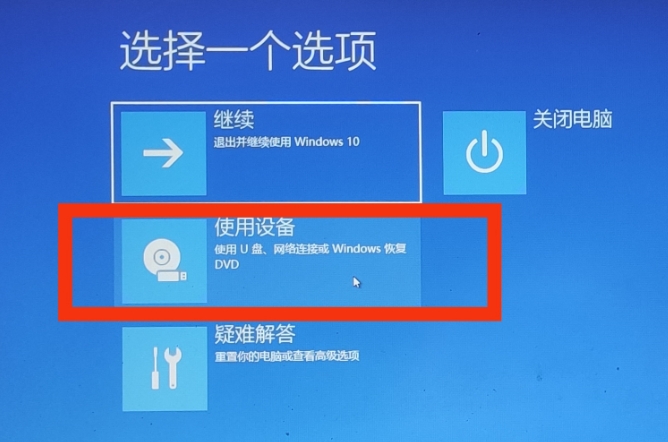

专业的在线重装系统软件 全新设计 / 全新代码编写 / 全新支持所有机型 全新支持Window 11 安装简介:

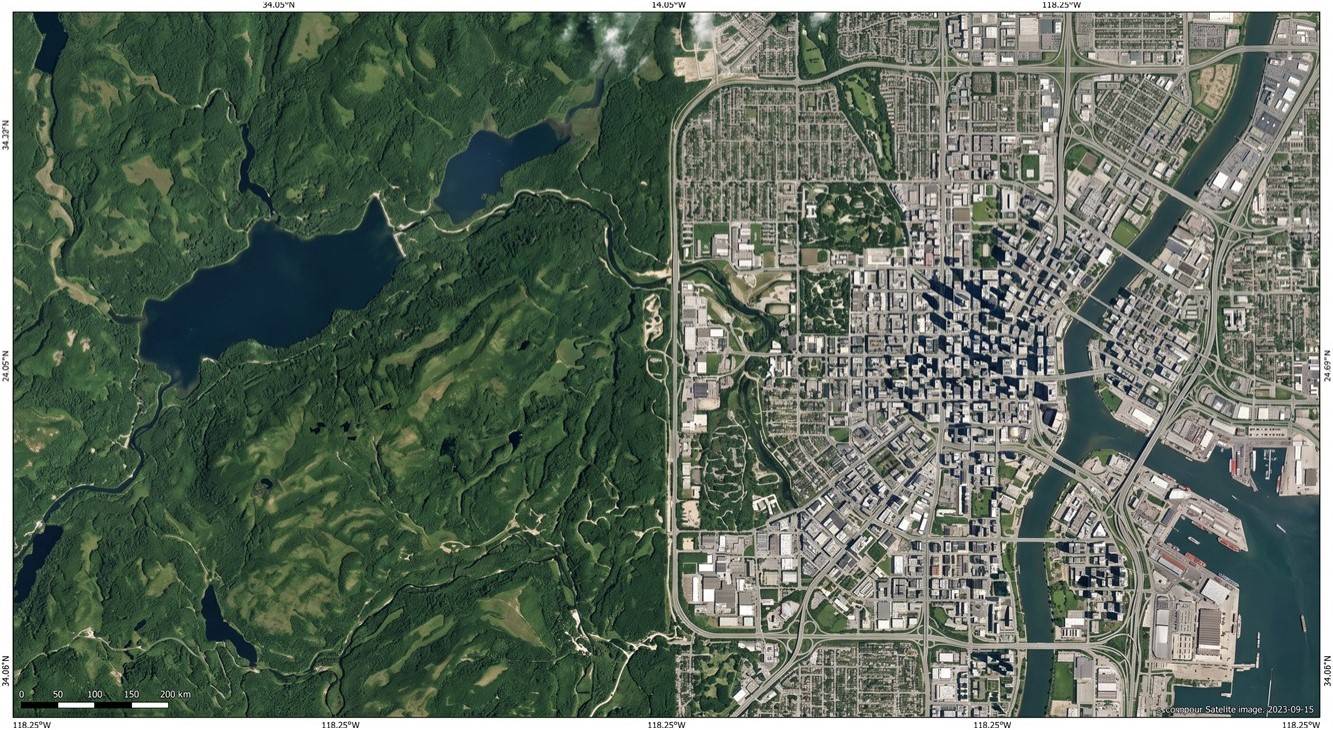

谷歌地球是一款功能强大的虚拟地球软件,它可以让用户在电脑或手机上自由探索全球的街景、卫星图像和地形。

现在,谷歌地球手机版的推出,让我们可以随时随地探索世界,掌上畅游天下。

工具原料:

系统版本:Android 12 / iOS 15

品牌型号:小米12 Pro / iPhone 13 Pro Max

软件版本:谷歌地球 9.164.0.1 (Android) / 9.164.0.2 (iOS)

一、随时随地探索世界谷歌地球手机版最大的优势就是便携性,无论你身在何处,只要打开手机,就可以开始探索世界。

无需登录账号,即可访问谷歌地球的所有功能,包括卫星图像、街景、地形等。

你可以搜索任何感兴趣的地点,或者直接在地球上滑动、缩放,寻找心仪的目的地。

例如,你可以在手机上"游览"埃及的金字塔、中国的长城、美国的大峡谷等著名景点,欣赏它们的壮丽景象。

你还可以查看自己家乡的街景,重温儿时的回忆。

谷歌地球手机版让世界触手可及,满足你的好奇心和探索欲。

二、丰富的功能和内容谷歌地球手机版不仅仅是一个虚拟地球,它还提供了许多实用的功能和丰富的内容。

例如,你可以在软件中测量两点之间的距离、面积,查看某个地点的海拔高度,了解当地的天气状况等。

谷歌地球还内置了大量的知识卡片和景点介绍,让你在探索世界的同时,也能学到许多地理、历史、文化方面的知识。

此外,谷歌地球手机版还支持离线浏览,你可以提前下载感兴趣的地区的数据,即使在没有网络的情况下,也能继续探索。

软件还提供了多种语言的支持,无论你来自哪个国家,都能轻松使用。

三、个性化体验和创作谷歌地球手机版不仅是一个浏览工具,还是一个创作平台。

你可以在软件中添加自己的标记、照片、视频等内容,记录下自己的旅行足迹和美好回忆。

你还可以与其他用户分享自己的创作,或者浏览他们的作品,获得更多灵感和乐趣。

谷歌地球还支持与其他谷歌服务的连接,例如你可以将谷歌地图中保存的地点同步到谷歌地球中,方便查看和管理。

你还可以将谷歌地球中的图像分享到社交媒体上,与好友一起探索世界。

内容延伸:除了谷歌地球手机版,谷歌还提供了谷歌地球的网页版和桌面版,它们各有特色和优势。

网页版无需安装,直接在浏览器中就能使用;

桌面版功能更加强大,支持更高清的图像和更流畅的浏览体验。

此外,谷歌地球还有专门的教育版和VR版,分别面向教育工作者和虚拟现实爱好者。

如果你对地理、旅游、摄影等领域感兴趣,不妨多关注谷歌地球的官方博客和社区,那里有许多用户分享的精彩内容和使用技巧。

你还可以参加谷歌地球的志愿者计划,为完善全球地图贡献自己的力量。

总结:

谷歌地球手机版是一款功能强大、内容丰富的虚拟地球软件,它让我们可以随时随地探索世界,掌上畅游天下。

无论你是出于好奇、学习还是创作的目的,谷歌地球手机版都能满足你的需求,带给你身临其境的探索体验和乐趣。

快来下载谷歌地球手机版,开启你的全球之旅吧!

全球3/4人口缺水?地球步入“水资源破产”时代

联合国一份最新报告指出,由于过度消耗与全球变暖,地球已进入“水资源破产”时代,全球有3/4的人口生活在缺水、水污染或气候干旱的国家和地区。伊拉克南部的哈维宰沼泽原本因长期干旱而逐渐干涸。

(新华社/发) 报告发现,全球70%的主要含水层正在萎缩,且很多变化不可逆转。

据调查,世界上很多地区不仅超额支取雨水和融雪带来的年度“收入”,还在不断透支那些需要数千年才能回补的地下水“储蓄”。

这主要由农业发展以及城市向干旱地区扩张导致,而气候变化让这些本就缺水的地方愈发干旱。

在土耳其,过度抽取地下水已导致近700处出现塌陷坑。

该报告作者,联合国大学水、环境与健康研究所的卡维赫·马达尼说:“如今,作为人类水资源‘活期账户’的地表水已经见底。

我们从祖先那里继承的‘储蓄账户’——地下水、冰川等,也几乎被挥霍一空。

世界各地都已出现‘水资源破产’的迹象。

” 据统计,目前全球大约有40亿人每年至少遭遇一个月的缺水危机,而这进一步加剧了移民潮、地区冲突和社会动荡。

去年,伊朗经历了50年来最干旱的秋季。

大量用于农业的大坝和水井,几乎吸干了曾是中东地区最大湖泊的乌鲁米耶湖,也让伊朗全国的地下水储备濒临枯竭。

为此,伊朗政府甚至提出要疏散首都德黑兰的居民,并尝试通过人工降雨来增加降水量。

科罗拉多河的流量20年间锐减了20%。

在美国,科罗拉多河的流量过去20年间锐减了约20%,主要原因是降水减少与蒸发加剧。

这条河除了被洛杉矶等城市作为饮用水来源,其河水还被大量引入农田用于种植家畜饲料。

与越来越多的河流一样,现在的它已无力奔赴大海。

研究表明,提高农业用水效率的技术,比如滴灌、喷灌,反而可能增加总耗水量。

原因在于精准灌溉能让作物充分吸收水分,而传统的大水漫灌后,多余的水还能流回河道。

因此,有专家提出必须削减农业的总用水量,因为它占到全球水资源消耗量的70%。

然而,全球有一半粮食产自水资源储量持续下降的地区。

缩减农业用水规模,将倒逼各国推进经济多元化转型。

目前,全球超10亿人依靠农业维持生计,其中大多数人生活在低收入国家。

即使在多雨地区,水资源也正面临新的威胁:数据中心在大量消耗水资源,工业废水、生活污水、化肥和粪便则在持续污染水体。

过去几十年,因被改作农田而消失的湿地面积与欧盟相当,这让全球在防洪、粮食生产和碳储存等生态系统服务方面,付出了约5.1万亿美元的沉重代价。

在大多数情况下,枯竭的河流、湖泊、湿地和含水层,再也难以恢复原有水文状态。

而冰川持续消融与消失,将导致数亿人的供水短缺。

马达尼认为,人类必须更好管理水资源,在此之前,大多数国家需要先摸清家底,核算其水资源储量与用水总量。

科学家使用特殊方法首次探测“超级地球”表面,结果很离谱

科学家首次对系外行星的表面进行直接分析。科学家称,韦布太空望远镜的观测结果显示,一颗所谓的“超级地球”其表面看起来实际上可能与水星更为相似。

NASA / Johns Hopkins University Applied Physics Laboratory / Carnegie Institution of Washington LHS 3844 b是一颗比地球大30%的系外行星,也是一颗所谓的“超级地球”。

近日天文学家动用韦布望远镜,对这个距离我们约50光年的行星进行了首次表面热特征分析。

与以往进行的大气研究不同,这是人类首次对系外行星的表面进行直接分析。

分析结果出人意料,这个“超级地球”几乎毫无地球特色。

LHS 3844 b是一个拥有深色表面的荒芜世界,没有大气。

在某种程度上和太阳系的水星倒有些相似。

发现于2019年的LHS 3844 b环绕一颗低温红矮星运行,其一年只相当于11个地球日,且已被潮汐锁定——它的一个半球将永远朝向它的恒星,就像月球永远只用它的一个半球朝向地球一样。

因此,它的永昼面温度理论上可达725℃。

来自马克斯・普朗克研究所的Laura Kreidberg等科学家2023年和2024年在LHS 3844 b运行到恒星后方时对其进行了3次观测,他们使用韦布望远镜的中红外探测仪,对恒星炽热昼面产生的红外线进行了测量,并据此对它的表面特征进行了分析。

相关论文发表在今年5月4日的《自然:天文学》上。

通过与地球、月球和火星的已知矿物进行光谱比对,研究人员发现这颗行星的表面与富含硅和花岗岩的地球不同。

在地球上,地壳的形成通常与水推动的地质进程和板块运动有关,这会导致岩石发生循环,并使浅色的矿物上升到地表;

而LHS 3844 b的表面主要由玄武岩构成——玄武岩是一种深色火山岩,富含铁和镁,在月球和水星表面十分常见。

研究人员表示,在这颗行星表面,水十分稀少。

导致这一结果的原因尚不可知。

一种可能的情形是,LHS 3844 b的表面相对年轻,它可能被新近的火山活动重塑过,且还未被微陨石的撞击破坏。

但是此类过程会释放出二氧化碳或二氧化硫,而韦布并未探测到这些气体。

另一种可能是,这颗行星表面覆盖着一层厚厚的深色颗粒物。

这些颗粒物是在辐射和陨石撞击下,并且经历了漫长的岁月之后形成的——与月球或水星表面的情况相似。

如果没有大气层保护,行星表面会特别容易受到这种影响。

这一过程被称为“空间风化(space weathering)”,它会导致岩石分解,并使其颜色变得越来越深。

而这种情形需要行星表面在较长时间内保持地质稳定。

研究人员计划未来使用韦布进一步判断LHS 3844 b的表面特性,比如其表面岩石的状态是否相对完整,还是已经松散和风化。

参考 Astronomers Explore the Surface Composition of a Nearby Super-Earth https://www.cfa.harvard.edu/news/astronomers-explore-surface-composition-nearby-super-earth The dark and featureless surface of rocky exoplanet LHS 3844 b from JWST mid-infrared spectroscopy

猜你喜欢

-

地表CT扫描:AI如何给地球做“皮肤全息体检”? 热点 2026-05-07

地表CT扫描:AI如何给地球做“皮肤全息体检”? 热点 2026-05-07 -

识质存在地球仪互动暗藏日本喜剧梗,引发本土玩家热议 热点 2026-04-22

识质存在地球仪互动暗藏日本喜剧梗,引发本土玩家热议 热点 2026-04-22 -

好诡异的景象!科学家:土卫六上存在“慢速推进的巨浪” 热点 2026-04-22

好诡异的景象!科学家:土卫六上存在“慢速推进的巨浪” 热点 2026-04-22 -

谷歌新论文把内存股价干崩了!KV cache压缩6倍,“谷歌的DeepSeek时刻” 热点 2026-03-26

谷歌新论文把内存股价干崩了!KV cache压缩6倍,“谷歌的DeepSeek时刻” 热点 2026-03-26 -

小行星撞击地球威力有多大 热点 2026-03-25

小行星撞击地球威力有多大 热点 2026-03-25 -

月球背叛了地球 热点 2026-03-24

月球背叛了地球 热点 2026-03-24 -

巨变正在发生:地球已进入有史以来最严重的能量失衡状态 热点 2026-03-24

巨变正在发生:地球已进入有史以来最严重的能量失衡状态 热点 2026-03-24 -

“地球裂缝”之上,625米云端起笔!世界第一高桥开启桥旅融合崭新篇章 热点 2026-03-24

“地球裂缝”之上,625米云端起笔!世界第一高桥开启桥旅融合崭新篇章 热点 2026-03-24 -

地球的表面存在着可以直达地心世界的通道 地球 2026-05-08

地球的表面存在着可以直达地心世界的通道 地球 2026-05-08 -

地球、太阳是庞然大物还是渺小如尘埃 地球 2026-05-08

地球、太阳是庞然大物还是渺小如尘埃 地球 2026-05-08 -

地球十大未解之谜,大自然中的每一个鬼斧神工的作品 地球 2026-05-08

地球十大未解之谜,大自然中的每一个鬼斧神工的作品 地球 2026-05-08 -

宇宙世界之谜思维导图?第一章宇宙中的地球思维导图 地球 2026-05-08

宇宙世界之谜思维导图?第一章宇宙中的地球思维导图 地球 2026-05-08