诺基亚手机壁纸:精美壁纸尽在你的掌握

精心设计的壁纸,为手机屏幕增添美感,让用户享受视觉盛宴。

无论是自然风光、抽象艺术还是动漫卡通,都能在诺基亚手机壁纸中找到心仪之作。

立即下载,让你的手机焕发新生!

【菜科解读】

诺基亚手机壁纸:精美壁纸尽在你的掌握诺基亚手机一直以来都以其出色的品质和稳定的性能而闻名。

然而,除了这些优点之外,诺基亚手机还提供了丰富多样的壁纸选择,让用户可以个性化自己的手机界面。

本文将介绍如何利用诺基亚手机的壁纸功能,让你的手机界面更加精美。

品牌型号:诺基亚手机

操作系统版本:最新版本

软件版本:壁纸应用程序最新版本

一、壁纸分类

1、自然风景壁纸

诺基亚手机提供了各种各样的自然风景壁纸,如山水、森林、海洋等。

你可以根据自己的喜好选择不同的风景壁纸,让手机界面充满自然的美感。

2、动物壁纸

如果你喜欢动物,诺基亚手机也有许多精美的动物壁纸供你选择。

无论是可爱的小猫小狗,还是威武的狮子老虎,都可以让你的手机界面更加生动有趣。

二、壁纸定制

1、个性化壁纸

诺基亚手机的壁纸应用程序还提供了个性化壁纸的功能。

你可以选择自己的照片或者下载喜欢的图片作为壁纸,让手机界面展现你的个性。

2、壁纸编辑

除了选择现有的壁纸,诺基亚手机还提供了壁纸编辑的功能。

你可以调整壁纸的亮度、对比度、饱和度等参数,让壁纸更加符合你的审美需求。

三、壁纸推荐

1、热门壁纸

壁纸应用程序会根据用户的喜好和热度推荐一些热门壁纸。

你可以浏览这些壁纸,选择自己喜欢的进行下载和使用。

2、精选壁纸

除了热门壁纸,壁纸应用程序还会定期更新一些精选壁纸。

这些壁纸通常是一些设计精美、色彩鲜艳的作品,可以让你的手机界面更加出众。

精美全屏诺基亚手机壁纸,让你的手机焕发新生!

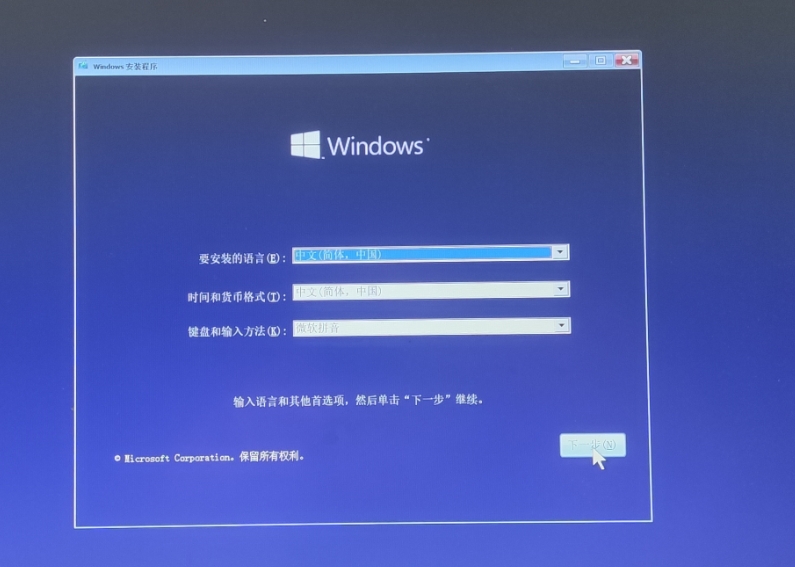

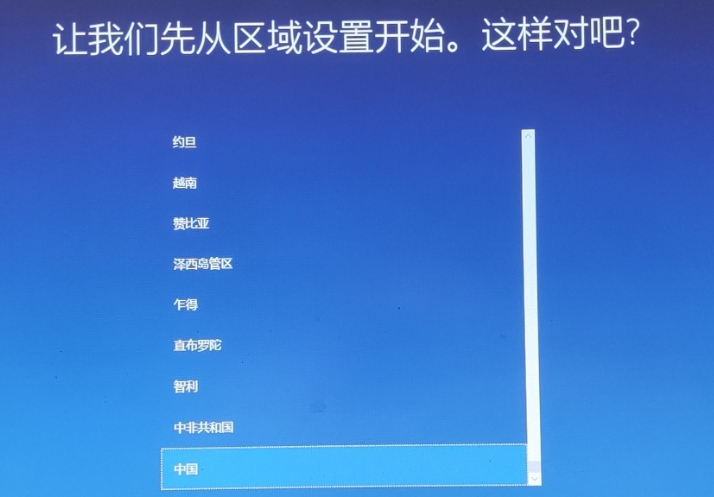

你是否厌倦了手机上单调的壁纸?想要让你的手机焕发新生吗?那么,精美全屏诺基亚手机壁纸就是你的不二选择!通过这篇文章,我将为你介绍如何使用这些壁纸,让你的手机变得更加个性化和吸引人。工具原料:品牌型号:诺基亚手机操作系统版本:最新版本软件版本:最新版本一、打造个性化手机壁纸1、选择合适的壁纸首先,你需要选择一款适合自己的壁纸。

你可以从诺基亚官方网站或其他壁纸网站上下载高清的全屏壁纸。

确保壁纸的主题与你的个人喜好相符。

2、调整壁纸尺寸诺基亚手机的屏幕尺寸各不相同,因此在设置壁纸之前,你需要根据自己手机的屏幕尺寸进行调整。

你可以使用图片编辑软件或者壁纸设置工具来完成这一步骤。

3、设置壁纸一切准备就绪后,你可以将壁纸设置为手机的背景图像。

在诺基亚手机上,你可以通过进入设置菜单,选择“外观”或“壁纸”选项,然后选择你想要设置的壁纸。

二、让手机焕发新生1、个性化壁纸通过使用精美全屏诺基亚手机壁纸,你可以让你的手机焕发新生。

选择一款与你个人喜好相符的壁纸,可以让你的手机更加个性化,展现出你的独特品味。

2、提升视觉体验精美全屏诺基亚手机壁纸的高清质量和细腻的图案,可以提升你的手机视觉体验。

每次打开手机,你都会被壁纸的美丽所吸引,让你的手机使用更加愉悦。

3、吸引他人的目光当你使用精美全屏诺基亚手机壁纸时,无论是在朋友聚会还是在公共场合,你的手机都会成为众人瞩目的焦点。

别人会被你手机上的壁纸所吸引,从而增加你的个人魅力。

在我们能看到的宇宙之外,可能还有无数个平行宇宙

在我们能看到的宇宙之外,可能还有无数个 “别的宇宙”,它们要么离得极远、要么维度不同、要么物理常数都不一样。这些宇宙里,可能有 “另一个你”,做出过不同选择,过着不一样的人生。

它不是瞎编,来自两大理论量子力学:多世界诠释(最有名)1957 年,休・埃弗雷特提出:量子每次 “二选一”,宇宙就会分裂成两条平行现实。

比如薛定谔的猫:不是 “又死又活”,而是一个宇宙猫死了,另一个宇宙猫活着,两个世界都真实,只是互相看不见。

好处:数学最简单,不用额外加 “波函数坍缩” 规则,很多物理学家(如肖恩・卡罗尔)认为这是对量子力学最优雅的解释。

宇宙学:永恒暴胀+泡泡宇宙大爆炸之后,宇宙极快膨胀(暴胀)。

安德烈・林德等人发现:暴胀不会同时停,有的区域停下成 “泡泡宇宙”,外面还在无限膨胀。

我们的宇宙只是其中一个泡泡;

别的泡泡可能光速、引力强度、甚至物理定律都不同。

这个模型能自然解释宇宙为什么这么均匀、这么平,和微波背景辐射数据吻合得很好。

主要的几类平行宇宙(通俗版)遥远复制区(第一类)宇宙无限大,物质均匀分布,极远处会有和地球一模一样的复制区,也有另一个你,历史几乎一样,只是某次选择不同。

泡泡宇宙(第二类)每个泡泡是独立宇宙,物理常数 / 定律可能不同,有的能形成恒星行星,有的不能。

量子多世界(第三类)每次量子选择,世界分裂,所有可能性都在不同分支里实现,分支之间不互通、不可见。

数学宇宙(第四类,偏哲学)所有数学上自洽的结构都对应真实宇宙,我们的宇宙只是其中一种数学结构。

有证据吗?—— 目前只有 “间接线索”宇宙微波背景冷斑:大爆炸余晖里有个异常低温区,有人猜是早期和另一个泡泡宇宙碰撞的痕迹,但没定论。

量子纠缠与干涉:量子计算机的并行计算能力,被戴维・多伊奇等物理学家认为是多世界存在的间接证据—— 计算是在多个平行世界里同时完成的。

暗能量与宇宙常数:我们宇宙的暗能量数值 “刚好适合生命”,用多重宇宙+人择原理能自然解释:无数泡泡里,只有数值刚好的才能演化出我们来观察它。

争议在哪?—— 最大问题:“看不见、摸不着”无法验证 / 证伪:平行宇宙和我们没有光信号联系,原则上很难直接观测;

有人认为这已经接近玄学,不算科学。

奥卡姆剃刀:批评者说,为了解释我们看到的世界,引入无限个不可观测宇宙,太 “奢侈”,不如找更简单的解释。

概率与测量问题:多世界里 “所有结果都发生”,很难定义 “概率”,数学上还有没解决的难题。

总结(人话版)科幻感很强,但出身很科学:来自量子力学和宇宙学的核心方程,不是瞎编。

存在可能性不小:多世界诠释和泡泡宇宙,都是很多顶尖物理学家认真支持的主流模型。

但别当事实:至今没有任何一个实验能直接证明平行宇宙存在,它仍是假说。

另一个你?:在多世界和无限宇宙模型里,理论上一定存在;

但你们永远无法见面、无法互相影响。

猜你喜欢