代理AI应用引爆CPU需求,AMD数据中心CPU份额升至41%

过去数年来,图形处理器(GPU)一直是推动AI发展的核心。

然而

【菜科解读】

随着人工智能(AI)技术的快速演进,全球科技产业正迎来一场前所未有的基础设施变革。

过去数年来,图形处理器(GPU)一直是推动AI发展的核心。

然而,随着代理AI(Agentic AI)的强势崛起,最新的市场与分析报告指出,云端供应商的算力瓶颈已正式从GPU转移至中央处理器(CPU)。

这股因AI而起、对CPU需求呈指数级成长的狂潮,不仅导致亚马逊(Amazon)与微软(Microsoft)等云端巨头面临严峻的“缺芯”危机,更直接带动了芯片大厂AMD在数据中心CPU业务上的惊人成长。

凭借着强势的x86构架优势与新款芯片布局,AMD服务器CPU的市占率与营收双双狂飚,华尔街分析师更进一步上调了其目标价位,预示着AI硬件市场即将迎来全新的洗牌与格局。

代理AI改变算力需求结构,CPU成为新瓶颈

根据市场研究机构Semianalysis的最新报告,AI运算的资源限制已经发生了根本性的转移。

在过去,执行AI任务的GPU主要负责相对单纯的推理(Inferencing)工作,但随着AI模型的不断推陈出新与进化,这项生态已经被彻底颠覆。

现在,伴随着模型数量的激增以及需求以指数级别的速度成长,代理型AI被广泛应用,AI系统需要大规模、持续运行,且能自主完成复杂任务的规划与执行,这意味着对于数据中心的协调与调度的算力需求将会指数级增长。

过去在云端服务器中,AI运算资源的配置多半以GPU为主导,例如一个机架上的单颗CPU可能需要搭配运行8颗GPU。

然而,现在这种极端的比例差距正在快速缩小,如今服务器中GPU与CPU的配置比例已经越来越接近。

过去100 MW的GPU算力只需不到10MW的CPU来支撑。

但现在无论是在强化学习训练还是代理型推理模型上,两者的耗能与配置比例已大幅拉近,这也导致了科技大厂的CPU资源陷入枯竭。

云端供应商算力告急,微软与亚马逊面临史无前例CPU荒

这波突如其来的CPU庞大需求,已经对全球知名的云端服务与基础设施造成了实质的冲击。

以知名的代码代管平台GitHub为例,近期便遭遇了严重的数据库不稳定问题,许多使用者回报系统出现宕机,且经常无法成功提交代码。

而探究其背后原因,竟然是因为微软已将其所有闲置的CPU资源全数出售或调配给了其他AI公司,尤其是那些与OpenAI和Anthropic签署协议的外部企业。

除了,微软的CPU储备已经见底,同样的窘境也发生在其他巨头身上。

据市场消息指出,尽管亚马逊已经将其CPU服务器的数量按年增加了两倍,但依然耗尽了所有的CPU供应,并且已无法满足未来的需求成长。

此外,为了因应早期的短缺情况,OpenAI曾经将其代码库从传统的x86构架移植到当时亚马逊资源较充裕的Arm构架CPU上。

分析指出,这将引发一场巨大且迫在眉睫的CPU全面短缺危机,不仅限于Arm CPU芯片,x86构架芯片也将面临相同的命运。

在产能排挤效应下,未来CPU资源将高度集中于AI领域,这意味着消费端与企业端市场的CPU生产线将受到不利影响,进而导致供应短缺、价格飙涨,市场将演变成“价高者得”的残酷竞争。

x86构架重获青睐,AMD服务器CPU市占率飚升破四成

在这场因AI驱动的CPU短缺危机中,AMD成为了最大的受益者之一。

机构分析指出,受惠于代理型AI的强劲推动,AMD的市场价值定位获得了进一步的强化。

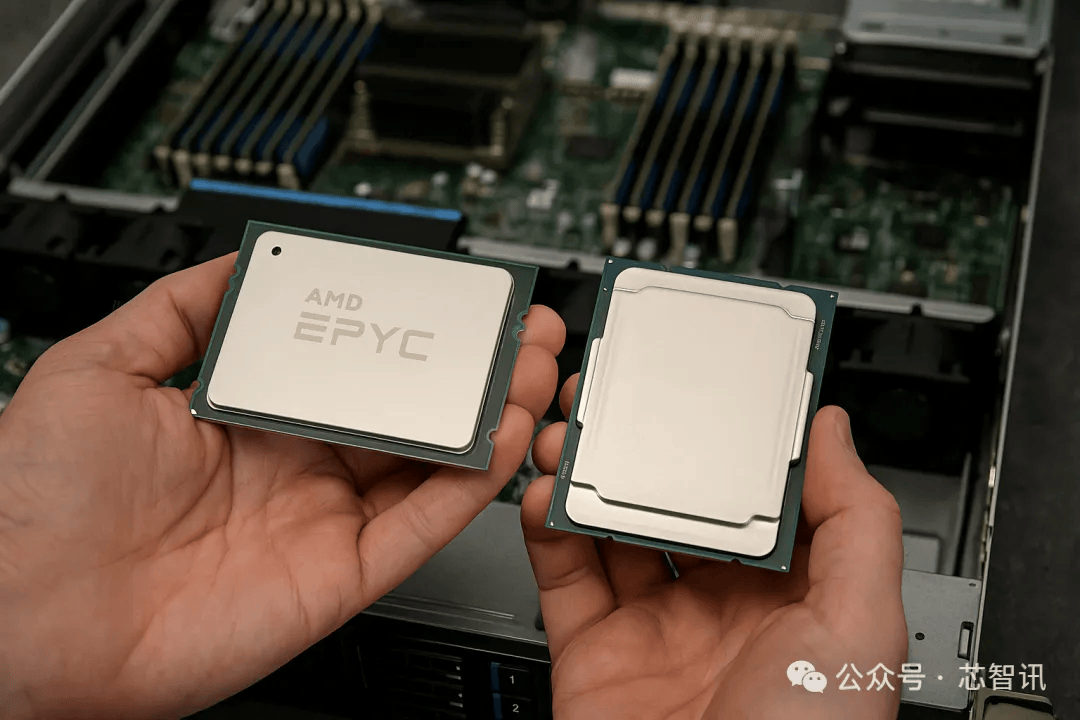

尽管Arm构架CPU在云端服务供应商(CSP)的自研芯片领域中取得了一定进展,但在搭配GPU进行AI运算时,x86构架依然是业界的优先解决方案。

这主要是因为x86在编排调用上具备更优异的性能表现。

尤其是AMD的CPU能够提供更低的延迟、更佳的软件兼容性,以及高达约1.6 TB/s的内存带宽(如Venice构架CPU)。

根据Mercury Research的数据显示,AMD在服务器CPU市场的价值份额于2025年第四季已大幅跃升至41%,出货量份额也达到了29%。

在台积电N3制程晶圆产能提升、平均销售单价(ASP)上涨的带动下,加上基于N2制程的新一代Venice CPU的推出,市场预期AMD在2026年的全年CPU出货量将实现28%的同比增长,营收更将大幅飙升46%。

而面对强大的市场需求,作为x86芯片主要供应商的AMD与Intel正全力向云端供应商供货,而NVIDIA也在积极提升其结合多颗芯片与大量DRAM的Vera CPU机架产能以应对这波商机。

MI455芯片供不应求,推动AMD目标价上调与营收看涨

除了CPU业务的强劲爆发,AMD在AI加速芯片领域的表现同样备受瞩目。

尽管市场先前因进展速度较预期缓慢而一度下调对AMD MI455芯片的预期,但最新的积极信号显示,搭载该芯片的Helios 72机架需求出现了显著的上调,预计到2026年底出货量将从原先预估的3,000台翻倍至6,000到7,000台。

这主要受惠于OpenAI与Meta两大关键客户坚定的需求,数据显示,2026年下半年这两大客户对MI455的需求量约为60万颗,但同期的供给量却仅有40至45万颗,呈现严重的供不应求状态。

此外,预期技术规格更复杂的MI550将为AMD带来另一波阶跃式的提升。

基于CPU市占率的快速扩张与MI455的大幅改善,市场分析师对AMD释出极为乐观的业绩展望。

预测其2026年第一季营收将达102亿美元,并在数据中心CPU的强势支撑下,毛利率将回升至55.5%至56%的区间。

更长远来看,分析预测AMD的数据中心营收将在2026年、2027年及2028年分别达到300亿美元、520亿美元以及惊人的810亿美元。

而考察到前瞻业绩表现与数据中心CPU攀升的平均售价,分析机构将AMD 2026年EPS预估微调降2%、2027年EPS上调5%,并基于2026与2027年预估本益比的33倍,将AMD的目标价从303美元正式调升至311美元。

综合来看,代理型AI的发展已将全球科技产业带入一个全新的算力格局。

对CPU的高强度需求打破了过去由GPU独霸的局面,引爆了全球性的CPU供应链变局。

而在这场变革中,AMD凭借着其在x86服务器CPU的技术优势与市占率扩张,搭配持续更新的AI加速芯片,成功构筑了强大的成长动能,在未来的AI基础设施争霸战中占据了极为有利的战略位置。

编辑:芯智讯-林子 来源:Technews

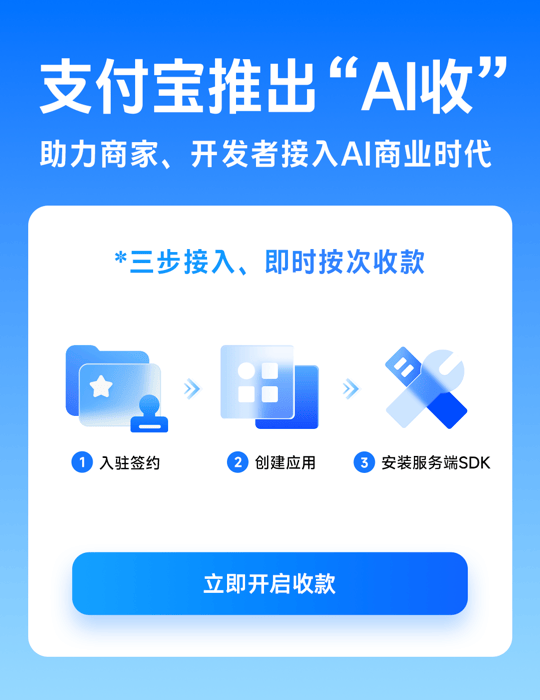

支付宝推“AI收”

4月28日,支付宝正式上线“支付宝AI收”,帮助商家和个人开发者通过OpenClaw(俗称“龙虾”)这类AI Agent提供商业化服务,实现按调用即时收款。这是继推出“AI付”之后,支付宝在智能体支付领域的进一步布局。

由此,支付宝“AI收”和“AI付”一起,形成了“一付一收”的AI支付产品体系。

在2025年9月的外滩大会上,支付宝推出了国内首个“AI付”服务,率先在瑞幸咖啡的AI点单助手“Lucky AI”上线。

阿里千问App启动“春节30亿免单活动”后,“AI付”普及加速。

截至目前,“AI付”已在千问App与智能眼镜、瑞幸、Rokid智能眼镜等AI多端多场景上线,是全球首个支付笔数与用户数双双破亿的AI原生支付产品。

如今,不止是消费者,来自开发者和商户的智能体开发和应用需求也在上升。

当龙虾类自主执行智能体大范围流行,从“聊天对话”延伸至购物付款等“办事时代”,新的商业生态正在形成。

各类Skill被龙虾调用,背后的商家和开发者面对的客户变成了智能体,如何实现“调用即收款”,是一个新问题。

基于此,支付宝推出面向商家和开发者的AI原生产品“AI收”,从而将支付从“人与人”之间,向“人与智能体”、甚至“智能体与智能体”之间进行延伸。

例如,当用户安装某Skill后,对“龙虾”说,“帮我整理最新AI行业的分析报告”,“龙虾”向服务端发起资源请求、询价,并为用户反馈“需支付0.02元才能获取结果”,用户下载安装“支付宝AI付”Skill后授权并完成支付,即可获取资源服务。

据介绍,该产品已在支付宝官网A2A交易专区上架(https://aipay.alipay.com/),接入流程也压缩至三步:入驻签约、创建应用、安装SDK,即可实现每次被AI Agent调用时触发询价、结算。

截至12月31日,个人开发者使用还可享受0费率。

此外,已使用支付宝收单的商家可直接将其服务Skill接入“龙虾”等AI Agent,在用户发出指令、下单购买后自动完成收款,无需重新搭建收单工具。

与此同时,支付宝“AI付”也有新进展。

在北京车展期间,支付宝与斑马智能联合发布了集成支付宝“AI付”车载版的全新AI座舱解决方案。

目前,该解决方案首期已覆盖影音娱乐与出行生活两大高频场景,车主仅需语音指令,即可完成买门票、订酒店、点餐等AI消费服务。

这套全新智能座舱解决方案已完成与多家主流主机厂的技术联调,相关服务计划于2026年下半年伴随新车型陆续上市。

在标准和协议建设方面,今年1月,支付宝联合千问App、淘宝闪购、Rokid、大麦、阿里云百炼等伙伴,正式发布ACT协议(Agentic Commerce Trust Protocol,智能体商业信任协议),为 AI 与电商、外卖等服务平台的协同打造一套 “通用语言”。

4月15日,支付宝联合魔搭社区率先在国内推出“支付MCP Server”服务,让AI智能体一键接入支付能力,打通从AI服务到AI商业化的“最后一公里”。

据测试,AI开发者可以使用自然语言接入支付宝支付服务,快速实现AI智能体内的支付。

目前该产品在魔搭社区MCP广场、支付宝百宝箱、支付宝开放平台等平台首发上线。

面对AI Agent催生的新经济时代,支付宝加速适配AI时代的支付新基建。

从“AI付”到“AI收”,支付宝正构建起覆盖AI消费与AI经营的全新支付体系。

作者:温婷

支付宝推出“AI收”

广告 支付宝推出“AI收” 11:51 广告 广告 广告 了解详情 > 会员跳广告 首月9.9元 秒后跳过广告 开通搜狐视频黄金会员,尊享更高品质体验! 1080P及以上画质仅为黄金会员专享> 开通/续费会员 抱歉,您观看的视频加载失败 请检查网络连接后重试,有话要说?请点击 我要反馈>> 正在切换清晰度... 播放 按esc可退出全屏模式 00:00 00:00 00:17 广告 只看TA 高清 倍速 剧集 字幕 下拉浏览更多 5X进行中 炫彩HDRVIP尊享HDR视觉盛宴 超清 720P 高清 540P 2.0x 1.5x 1.25x 1.0x 0.8x 50 哎呀,什么都没识别到 反馈 循环播放 跳过片头片尾 画面色彩调整 AI明星识别 视频截取 跳过片头片尾 是 | 否 色彩调整 亮度 标准 饱和度 100 对比度 100 恢复默认设置 关闭 复制全部log猜你喜欢

-

支付宝推“AI低价帮抢”功能,代购秒杀有了新玩法 热点 2026-05-13

支付宝推“AI低价帮抢”功能,代购秒杀有了新玩法 热点 2026-05-13 -

原创 阿联酋打不了伊朗,就拿巴基斯坦开刀,驱逐数千劳工,不谴责伊朗就撤资? 热点 2026-05-13

原创 阿联酋打不了伊朗,就拿巴基斯坦开刀,驱逐数千劳工,不谴责伊朗就撤资? 热点 2026-05-13 -

“动动嘴皮子”就能缴停车费 捷停车与支付宝停车助手做到了! 热点 2026-05-13

“动动嘴皮子”就能缴停车费 捷停车与支付宝停车助手做到了! 热点 2026-05-13 -

湖北两男子钓到100多斤大鱼,敲晕都没拽上岸,大鱼“反杀”带着网跑了 热点 2026-05-13

湖北两男子钓到100多斤大鱼,敲晕都没拽上岸,大鱼“反杀”带着网跑了 热点 2026-05-13 -

美国务院:中美都同意,霍尔木兹海峡不收通行费 热点 2026-05-13

美国务院:中美都同意,霍尔木兹海峡不收通行费 热点 2026-05-13 -

文班27+17华子20分 马刺大胜森林狼总分3-2 热点 2026-05-13

文班27+17华子20分 马刺大胜森林狼总分3-2 热点 2026-05-13 -

投了那么多AI公司,美团会变成什么? 热点 2026-05-13

投了那么多AI公司,美团会变成什么? 热点 2026-05-13 -

拼多多宣布:成立“新拼姆”! 热点 2026-05-13

拼多多宣布:成立“新拼姆”! 热点 2026-05-13 -

特朗普称可能有条件同伊朗谈判,伊朗外长:不会再对话 热点 2026-05-10

特朗普称可能有条件同伊朗谈判,伊朗外长:不会再对话 热点 2026-05-10 -

凯文-杜兰特:巴姆-阿德巴约83分“将被永远谈论” 热点 2026-05-10

凯文-杜兰特:巴姆-阿德巴约83分“将被永远谈论” 热点 2026-05-10 -

难以想象,中国还有9亿人没有坐过飞机 热点 2026-05-10

难以想象,中国还有9亿人没有坐过飞机 热点 2026-05-10 -

中国中等收入群体:从 4 亿迈向 8 亿,超大规模市场加速成型 热点 2026-05-05

中国中等收入群体:从 4 亿迈向 8 亿,超大规模市场加速成型 热点 2026-05-05