昆仑龙影:2021 年卫星拍下的天空奇观,成因至今成谜

【菜科解读】

2021 年寒冬,我国气象卫星掠过昆仑山脉上空,传回一张震撼画面:绵延数十公里的黑色龙形阴影盘踞云端,云层纹理层层叠叠酷似龙脊,蜿蜒盘踞在 “中华龙脉” 昆仑山上空。

这张照片一经流传便引爆全网,有人坚信是真龙现世、龙脉显形,也有人认为是罕见自然现象,可至今没有权威定论,成了悬而未解的天空谜题。

卫星定格的震撼瞬间

那年深冬,卫星在高空捕捉到的画面,让无数人倒吸凉气。

昆仑山脉的高空云层里,一条长达数十公里的阴影清晰可见,从西向东蜿蜒伸展,轮廓和传说中的龙形高度吻合。

最神奇的是云层纹理,一层叠一层的褶皱如同龙鳞,边缘飘散的薄云又像龙须,阴影的 “头部” 恰好对准昆仑主峰玉珠峰,仿佛巨龙盘踞守护着神山。

这张照片最初在气象圈小范围流传,后来被网友分享到社交平台,瞬间刷屏。

大家反复放大细节,越看越觉得逼真,“昆仑龙脉真的存在”“卫星拍到真龙了” 的说法越传越广,连不少常年研究气象的人都表示,从业几十年从未见过如此奇特的云影。

民间传闻与龙脉传说的叠加

昆仑山本就自带神秘滤镜,自古被称为 “万山之祖”“龙脉之源”,神话里是西王母居所、修仙圣地,现实中也有 “地狱之门”“死亡谷” 等未解之谜。

龙影出现后,民间传闻更是层出不穷。

有青海牧民称,曾在昆仑山口见过类似黑影,云雾翻涌时像黑龙翻身,还伴随着低沉声响;

有登山爱好者说,在高海拔区域见过云层中闪过鳞片状光影,和卫星照片里的龙鳞纹路一模一样。

这些传闻和 “龙脉” 传说叠加,让龙影事件更添玄幻色彩,很多人坚信,这不是普通自然现象,而是昆仑龙脉的真实显现。

科学视角的推测与争议

面对热议,气象、地理专家纷纷给出推测,但始终没有统一结论。

有专家认为,这是特殊气象条件下的视觉奇观:昆仑山海拔极高,暖湿气流从山脚荒漠向上攀升,遇高空极寒迅速凝结成冰晶云,加上高空风切变影响,云层被拉扯成蜿蜒形态;

而龙鳞纹理,是冰晶层厚薄不均、阳光折射形成的光影效果,类似 “重力流” 现象,冰川融水在岩壁流动也会形成类似纹路。

也有专家提出,可能是地形与云层的光影巧合。

昆仑山脉沟壑纵横、山峰林立,高空薄云在特定光照角度下,被山体轮廓投射出长条阴影,恰好形成龙形;

而龙脊般的云层,是高积云在稳定气流中形成的波状纹理,只是刚好和龙的形态重合。

但这些推测都无法完全解释所有细节:为何阴影长达数十公里且轮廓如此规整?为何龙鳞纹理如此清晰逼真?为何恰好出现在昆仑山脉?至今没有实验能完美复刻这一景象,科学解释始终存在争议。

悬而未解的天空谜题

时至今日,昆仑龙影依旧没有权威定论。

有人坚持是龙脉显灵、真龙现世,把照片当作神话成真的证据;

有人认可科学推测,认为只是罕见自然巧合;

还有人觉得,这是人类对未知自然现象的浪漫想象,昆仑山的神秘本就源于未知。

那张卫星照片至今仍在网络流传,每次被翻出都会引发新的讨论。

它就像昆仑山脉的一个神秘印记,提醒着我们,在这片古老的土地上,还有太多自然奇观等待探索,太多未知谜题等待解答。

或许未来某天,随着气象观测技术进步,我们能揭开龙影的真正成因,但在此之前,它会一直作为昆仑的神秘传说,留在人们的想象里。

托卡马克:人造太阳的 “磁约束熔炉”

托卡马克(Tokamak)是目前最主流的可控核聚变装置,核心是用强磁场把上亿度高温的等离子体约束在环形真空室,实现氘氚聚变,被视为人类迈向 “人造太阳” 的核心路线。一、名字与起源名称含义:俄语缩写,全称 “环形真空室磁线圈装置”(环形 toroidal、真空室 kamera、磁 magnit、线圈 kotushka)。

诞生:1950 年代由苏联库尔恰托夫研究所发明,1954 年建成首个装置 T-1,1968 年 T-3 装置突破关键温度,奠定主流地位。

二、核心原理:磁场 “牢笼” 困住上亿度等离子体核聚变需要1 亿℃+高温,没有任何材料能直接接触,托卡马克用磁约束解决:环形真空室:形似 “轮胎”,内部抽成真空,注入氘氚燃料(氢同位素)。

三重磁场约束环向磁场:外部环形线圈通电,产生绕真空室的 “跑道型” 磁场,防止粒子径向逃逸。

极向磁场:中心螺线管线圈(变压器初级)感应出等离子体电流(变压器次级),电流产生垂直方向磁场,约束粒子纵向运动。

螺旋磁场:两种磁场叠加,形成螺旋形磁力线,让等离子体粒子沿磁力线螺旋运动,牢牢锁在中心,不碰内壁。

加热到聚变温度欧姆加热:等离子体电流自身电阻产热(类似电炉丝)。

辅助加热:微波、中性束注入(高速氢原子束),把等离子体从千万度加热到 1 亿℃以上,满足氘氚聚变条件。

聚变反应与能量输出氘 + 氚氦 + 高能中子 +17.6MeV 能量。

带点粒子(氦核)被磁场约束,维持高温;

不带电中子穿透磁场,撞击内壁 “包层”(锂材料),动能转化为热能,加热水成蒸汽,驱动发电机发电。

副产品:氦气(无放射性),锂受中子轰击还能再生氚,形成燃料闭环。

三、关键结构真空室:环形,耐高温、防杂质污染。

磁体系统:环向线圈、中心螺线管、极向线圈,多为超导材料(如铌钛合金),降低能耗。

包层:内壁核心部件,承担能量捕获 + 氚增殖双重任务。

偏滤器:排出杂质和废热,保护真空室。

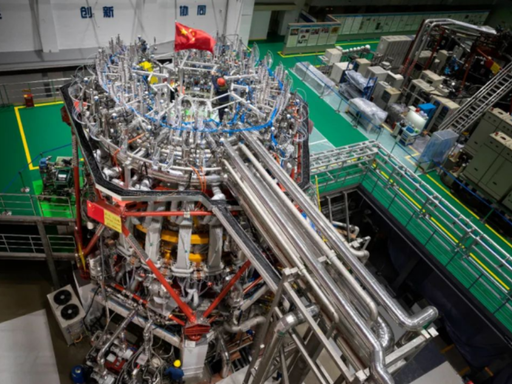

四、代表装置EAST(东方超环,中国):世界首个全超导托卡马克,2021 年实现1.2 亿℃维持 403 秒,稳态运行全球领先。

EAST东方超环托卡马克装置ITER(国际热核聚变实验堆,法国):全球 7 方(中、欧、美、俄、日、韩、印)共建,人类最大托卡马克,目标 2035 年首次氘氚聚变,实现输出能量 > 输入能量(Q>10)。

ITER国际热核聚变实验堆JET(欧盟):历史最久的大型托卡马克,1997 年创下Q=0.67(输出 / 输入)纪录。

五、核心挑战稳态约束难:上亿度等离子体易失控、逃逸,需长期稳定约束(目标数千秒)。

能量增益低:目前实验Q 输出),需突破Q>10才能商业化。

材料寿命短:中子轰击、高温等离子体冲击,内壁材料易损伤。

氚自持难:氚天然稀缺,需高效增殖技术实现燃料自给。

六、优势与前景优势:燃料(氘)取自海水,储量几乎无限;

无碳排放,放射性废料极少(远低于裂变),安全性高。

前景:若 2035 年 ITER 达成目标,2050 年前后有望建成首座商业聚变电站,彻底解决人类能源危机。

黑洞里面是什么?人造黑洞或可模拟黑洞吃太阳

3月2日消息,黑洞里面是什么?科学家们试图通过人造黑洞模拟黑洞运转方式,从而揭开黑洞里面可能产生什么物质的谜题。目前,全球已有多个科研机构正在加紧实施人造黑洞项目,黑洞吞噬地球,甚至黑洞吞噬太阳的可能性,都可能通过人造黑洞模拟来加以验证。

黑洞里面是什么?人造黑洞或可模拟黑洞吃太阳 据了解,人造黑洞的设想最早提出于20世纪80年代,由加拿大不列颠哥伦比亚大学的威廉-昂鲁教授提出,他认为声波在流体中的表现与光在黑洞中的表现非常相似,如果使流体的速度超过声速,那么就可以在该流体中建立一个人造黑洞。

美国加州大学物理学教授史蒂夫-吉汀斯是这方面的专家,他对人造黑洞进行了认真分析,他认为:人造黑洞毁灭地球的理论纯粹是小说和电影里的虚构,真正的粒子碰撞制造出的人造黑洞不可能吞噬地球。

黑洞里面是什么?人造黑洞或可模拟黑洞吃太阳 粒子加速器,也被称之为大型强子对撞机(LHC)。

位于法国和瑞士交界处的世界上最大的粒子物理研究中心欧洲核子研究中心(CERN)已经开始在一个将近17英里长的圆形隧道里面建造这个被人们称之为世界最大的"黑洞工厂"的装置。

吉汀斯教授在报告中称,欧洲的科学家很快就会利用粒子加速器制造出人造黑洞。

目前欧洲核子研究中心的蒙加诺教授与吉汀斯教授的科研小组进行合作正在建设建设世界上最大的粒子加速器(对撞机),而这个粒子加速器(大型强子对撞机)是世界上最先进的粒子研究工具,项目耗资80亿美元,历时14年之久,汇集了世界各地最著名的物理学家。

黑洞里面是什么?人造黑洞或可模拟黑洞吃太阳 科学家们将在实验中撞击质子,模拟宇宙大爆炸后一万亿分之一秒内的能量和条件,接着细致分析撞击产生的残骸,用以探求物质本质的线索和自然中新的力量和平衡。

吉汀斯认为,今年夏天如果人类首次制造出人造黑洞,也不会产生什么重大影响。

吉汀斯和蒙加诺两位教授在进行深入研究后得出结论:利用粒子碰撞产生的黑洞是无害的。

因为,所有的黑洞都要释放出宇宙射线,小的黑洞所释放的物质要远远多于其吸收的物质,因此,在它们吸收物质之前自己就早已瞬间蒸发了。

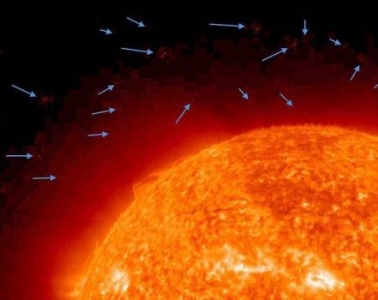

黑洞里面是什么?人造黑洞或可模拟黑洞吃太阳 事实上整个宇宙原本就是一个类似的粒子对撞机器,具有高能量的宇宙射线和粒子会经常碰撞在地球的大气表层、太阳或者是其它的白矮星和中子星的表面,每时每刻都在发生着这样的粒子碰撞。

如果这些粒子碰撞会产生危险的话,天文学家很早就会发现这一现象并对其展开研究。

其实一直以来地球就沐浴在足够可以形成黑洞的宇宙射线和粒子对撞之下,但地球一直也都没有被摧毁。

而且,几乎所有粒子加速器生成的黑洞都必须达到足够的速度才能逃脱地球的重力,即使一年生产出1000万个黑洞,也大约只能捕捉到其中的10个,让它们围绕加速器中心运转。

黑洞里面是什么?人造黑洞或可模拟黑洞吃太阳 而这些被捕捉到的黑洞又是如此的渺小,假设让它穿过一块相当于地球到月球距离厚度的铁块,它也不会撞倒任何东西。

它们吞噬一个质子也需要大约100小时的时间。

一个这样的黑洞吞噬100个质子大约需要花费一年的时间,因此,要吞噬1毫克地球物质就需要花费比宇宙年龄还要长的时间。

科学家表示,假如大型强子对撞机(LHC)在今年生产出了黑洞,那么它就证明了宇宙确实存在除空间和时间以外的维度。

吉汀斯承认,地球的未来以及人类的生命安全和健康都令每位科学家非常担忧。

特别是关于人造黑洞风险的争论,现在已经是一个非常具有争议的物理话题。

黑洞里面是什么?人造黑洞或可模拟黑洞吃太阳 特别是已经有科学家指出,欧洲核子研究中心的大型强子对撞机产生黑洞的风险足以吞噬地球,或者将产生一类名为"奇异微子"(Strangelet)的粒子,将地球变成一团沉寂、收缩的"奇异物质"。

还有很多政治家担心这种人造黑洞的技术被恐怖分子利用,成为继原子弹和氢弹之后人类最具有毁灭性的武器。

但是,吉汀斯肯定的说:现代物理学无法在地球上制造出具有破坏性的黑洞。

"欧洲建立大型强子对撞机(简称LHC),是为了揭开宇宙大爆炸之谜,而不是制造黑洞毁灭地球。

"

猜你喜欢